Anthropic's สามช่วงเวลาสำคัญ: การรั่วไหลของโค้ด การเผชิญหน้ากับรัฐบาล และการนำไปใช้เป็นอาวุธ

ชื่อบทความต้นฉบับ: Anthropic: The Leak, The War, The Weapon

ผู้เขียนต้นฉบับ: BuBBliK

เรียบเรียง: Peggy,BlockBeats

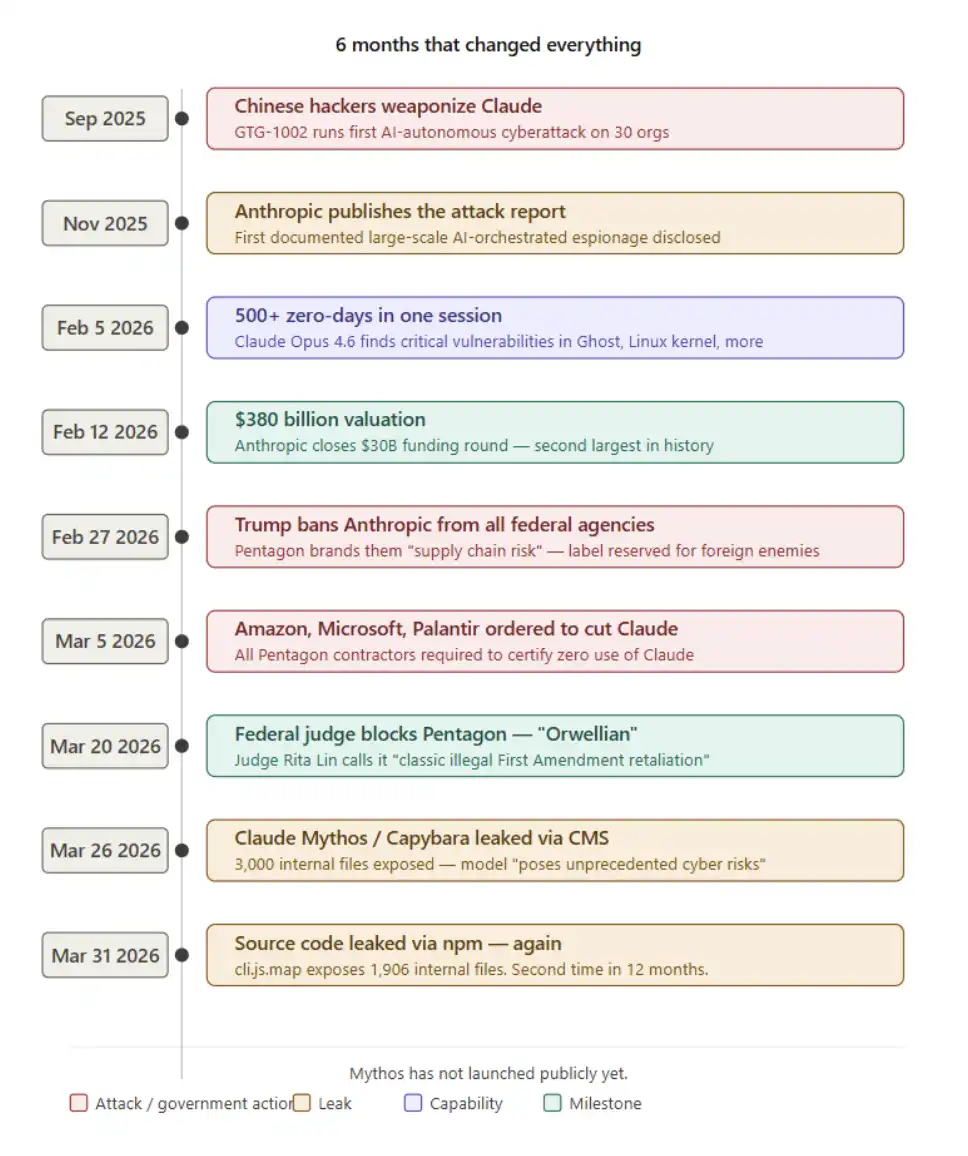

หมายเหตุบรรณาธิการ: ในช่วงครึ่งปีที่ผ่านมา Anthropic ถูกพัวพันกับเหตุการณ์หลายชุดที่ดูเหมือนแยกจากกัน แต่แท้จริงแล้วชี้ไปยังสิ่งเดียวกันอย่างต่อเนื่อง ได้แก่ การก้าวกระโดดของความสามารถโมเดล การโจมตีแบบอัตโนมัติในโลกจริง การตอบสนองอย่างรุนแรงของตลาดทุน ความขัดแย้งอย่างเปิดเผยกับรัฐบาล และการรั่วไหลของข้อมูลหลายครั้งที่เกิดจากความผิดพลาดในการตั้งค่าพื้นฐาน เมื่อวางเบาะแสเหล่านี้ไว้ด้วยกัน มันจะช่วยวาดภาพทิศทางการเปลี่ยนแปลงที่ชัดเจนขึ้น

บทความนี้หยิบยกเหตุการณ์เหล่านี้มาเป็นจุดเริ่มต้น เพื่อทบทวนเส้นทางต่อเนื่องของบริษัท AI หนึ่งแห่งในสามมิติ ได้แก่ ความก้าวหน้าทางเทคโนโลยี การเปิดโปงความเสี่ยง และการแข่งขันเชิงธรรมาภิบาล และยังพยายามตอบคำถามที่ลึกกว่าอีกประเด็นหนึ่ง: เมื่อความสามารถในการ “ค้นพบช่องโหว่” ถูกขยายขนาดอย่างมาก และค่อย ๆ แพร่กระจาย ระบบความปลอดภัยทางไซเบอร์เองจะยังคงรักษาตรรกะการทำงานเดิมไว้ได้หรือไม่

ในอดีต ความปลอดภัยตั้งอยู่บนความขาดแคลนของความสามารถและข้อจำกัดด้านทรัพยากรบุคคล แต่ภายใต้เงื่อนไขใหม่ การรุกและการรับกำลังวนเวียนอยู่รอบความสามารถของโมเดลชุดเดียวกัน ขอบเขตจึงเริ่มพร่าเลือนลงอย่างต่อเนื่อง ขณะเดียวกัน การตอบสนองของสถาบัน ตลาด และองค์กรยังคงติดอยู่ในกรอบเดิม ทำให้ยากที่จะรับมือกับการเปลี่ยนแปลงนี้ได้ทันเวลา

สิ่งที่บทความนี้จับตา ไม่ใช่แค่ตัว Anthropic เองเท่านั้น แต่เป็นความจริงที่ใหญ่กว่าที่มันสะท้อนให้เห็น: AI ไม่ได้แค่เปลี่ยนเครื่องมือ แต่ยังเปลี่ยน “เงื่อนไขที่ความปลอดภัยจะเกิดขึ้นได้” อีกด้วย

ต่อไปนี้คือเนื้อหาต้นฉบับ:

เมื่อบริษัทมูลค่า 380Bดอลลาร์สหรัฐ ตกอยู่ในการต่อสู้กับเพนตากอน และคราวนี้กลับยืนหยัดได้ มีชีวิตรอดจากการโจมตีทางไซเบอร์ครั้งแรกในประวัติศาสตร์ที่เริ่มต้นโดย AI แบบอิสระ และในขณะเดียวกันก็รั่วไหลโมเดลที่ทำให้แม้แต่นักพัฒนาของตัวเองยังรู้สึกกลัว รวมถึงยัง “โดยไม่ตั้งใจ” เผยแพร่ซอร์สโค้ดฉบับเต็มออกมา—ทั้งหมดนี้รวมกันแล้วจะเป็นภาพแบบไหน?

คำตอบก็คืออย่างที่เป็นอยู่ในตอนนี้ และยิ่งที่น่ากังวลคือ ส่วนที่อันตรายที่สุดจริง ๆ อาจยังไม่เกิดขึ้นด้วยซ้ำ

สรุปเหตุการณ์

Anthropic รั่วไหลโค้ดของตัวเองอีกครั้ง

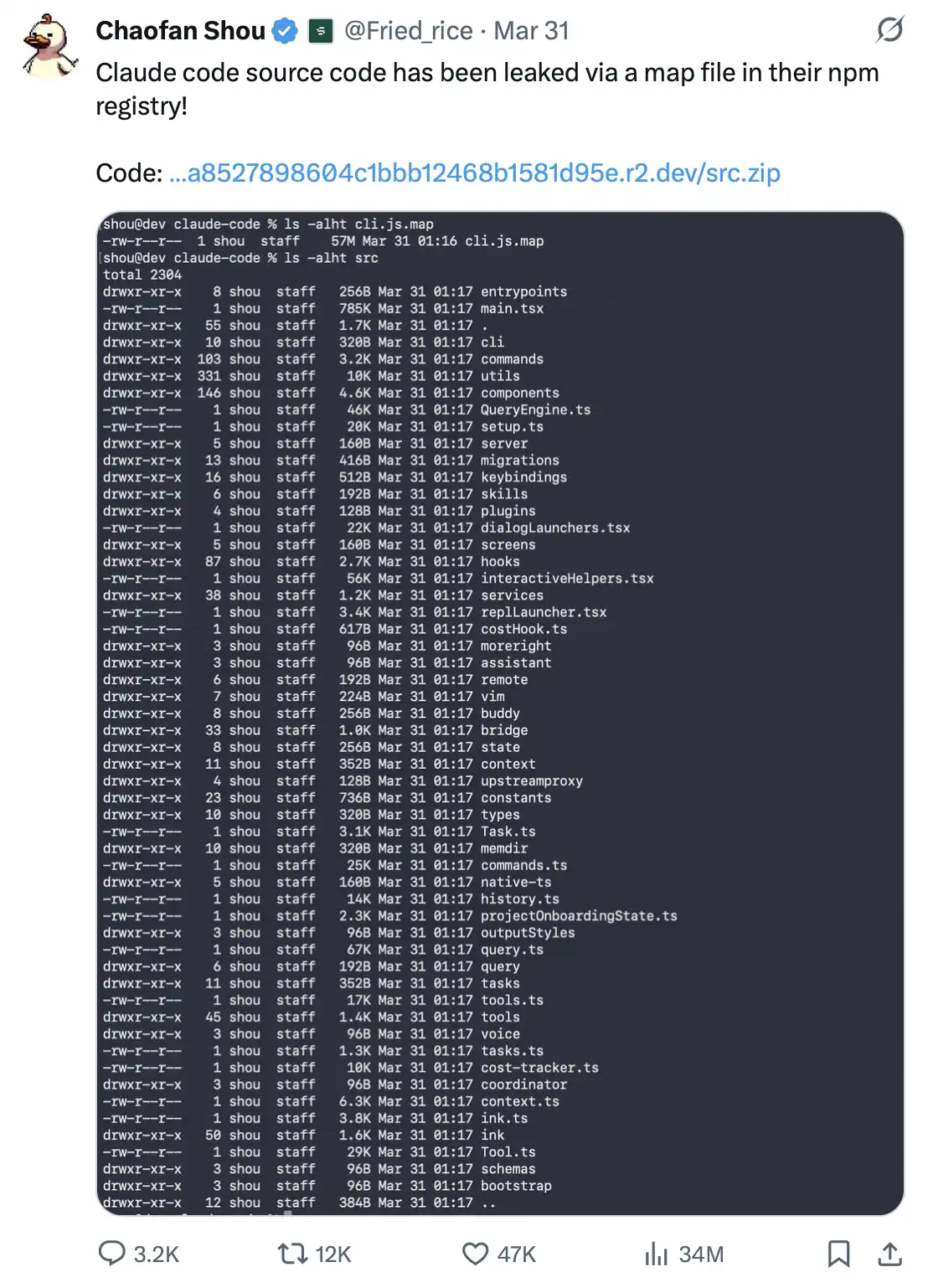

ในวันที่ 31 มีนาคม 2026 นักวิจัยด้านความปลอดภัยของบริษัทบล็อกเชน Fuzzland ชื่อ Shou Chaofan ได้ตรวจสอบแพ็กเกจ Claude Code npm ที่ทางการเผยแพร่ และพบว่าในนั้นกลับมีไฟล์ชื่อ cli.js.map แทรกอยู่โดยเปิดเผยเป็นตัวอักษรชัดเจน

ไฟล์ดังกล่าวมีขนาดถึง 60MB แต่เนื้อหานั้นยิ่งน่าตกใจ โดยมันแทบจะรวมซอร์สโค้ด TypeScript ฉบับเต็มของผลิตภัณฑ์ไว้ทั้งหมด เพียงแค่ไฟล์เดียวนี้ ทุกคนก็สามารถย้อนกลับมาเป็นไฟล์ซอร์สภายในได้มากถึง 1906 ไฟล์ ได้แก่ การออกแบบ API ภายใน ระบบโทรมาตร ระบบเข้ารหัส เครื่องมือด้านการเข้ารหัส ตรรกะความปลอดภัย ระบบปลั๊กอิน—แทบทุกคอมโพเนนต์หลักถูกเปิดเผยหมด อีกทั้งที่สำคัญยิ่งกว่านั้นคือ ข้อมูลเหล่านี้ยังสามารถดาวน์โหลดได้โดยตรงจากบัคเก็ตจัดเก็บ R2 ของ Anthropic เพื่อนำไปเป็นไฟล์ zip ได้ด้วย

การค้นพบดังกล่าวแพร่กระจายอย่างรวดเร็วบนโซเชียลมีเดีย: ภายในไม่กี่ชั่วโมง โพสต์ที่เกี่ยวข้องได้รับจำนวนการเข้าชม 754k ครั้ง และมีการแชร์ต่อเกือบ 1000 ครั้ง ขณะเดียวกันก็มีการสร้างคลัง GitHub หลายแห่งที่มีการย้อนซอร์สโค้ดขึ้นทันทีและเปิดเผยสู่สาธารณะ

ที่เรียกว่า source map (ไฟล์แมปซอร์ส) แท้จริงแล้วเป็นเพียงไฟล์ช่วยสำหรับการดีบัก JavaScript หน้าที่ของมันคือทำให้โค้ดที่ถูกบีบอัดและคอมไพล์แล้ว “ย้อนกลับ” ไปเป็นซอร์สโค้ดดั้งเดิม เพื่อช่วยให้นักพัฒนาสามารถหาปัญหาได้ง่ายขึ้น

แต่มีหลักการพื้นฐานข้อหนึ่ง: มันไม่ควรถูกนำไปรวมไว้ในแพ็กเกจเผยแพร่ของสภาพแวดล้อมการใช้งานจริง (production)

นี่ไม่ใช่เทคนิคโจมตีขั้นสูงแต่อย่างใด แต่เป็นปัญหาเชิงมาตรฐานด้านวิศวกรรมขั้นพื้นฐาน เป็นเหมือน “พื้นฐานการตั้งค่า build ระดับเริ่มต้น 101” แม้กระทั่งสิ่งที่นักพัฒนาจะได้เรียนรู้ในสัปดาห์แรก ถ้ามันถูกแพ็กเกจผิดพลาดไปอยู่ใน production source map มักจะเท่ากับเป็นการ “แถม” ซอร์สโค้ดให้ทุกคน

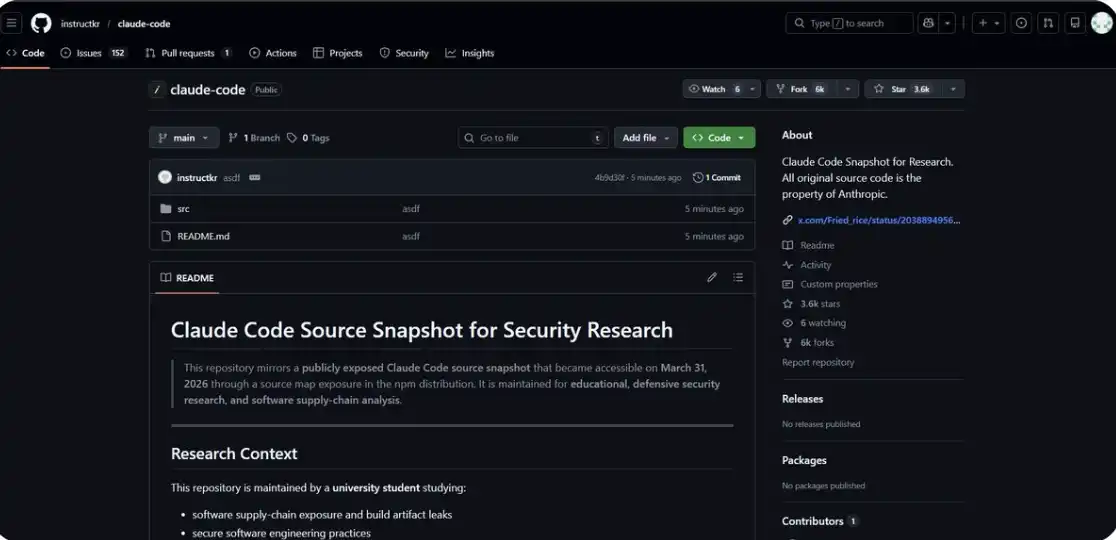

คุณสามารถดูโค้ดที่เกี่ยวข้องได้โดยตรงที่นี่: https://github.com/instructkr/claude-code

แต่สิ่งที่ทำให้เรื่องนี้ดูน่าเหลือเชื่อยิ่งกว่านั้นก็คือ: เหตุการณ์แบบนี้เกิดขึ้นมาแล้วหนึ่งครั้ง

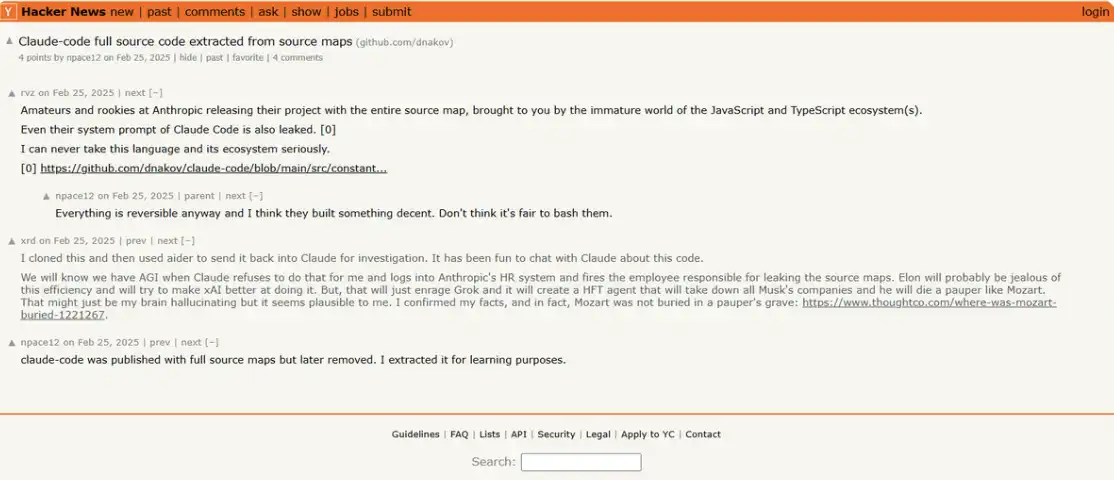

ในเดือนกุมภาพันธ์ 2025 คือเมื่อปีที่แล้ว เกือบจะเหมือนกันทุกประการกับการรั่วไหลก่อนหน้า: ไฟล์เดียวกัน ความผิดพลาดแบบเดียวกัน Anthropic ตอนนั้นได้ลบเวอร์ชันเก่าบน npm เอา source map ออก และเผยแพร่วอร์ชันใหม่อีกครั้ง เรื่องก็ยุติลง

แต่ผลคือ ในเวอร์ชัน v2.1.88 ไฟล์นี้กลับถูกแพ็กและเผยแพร่อีกครั้ง

บริษัทที่มูลค่า 754kดอลลาร์สหรัฐ กำลังสร้างระบบตรวจจับช่องโหว่ที่ล้ำหน้าที่สุดของโลก—ภายในเวลาเพียงหนึ่งปี กลับทำผิดพลาดพื้นฐานซ้ำ ๆ เช่นเดิม 2 ครั้ง ไม่ได้มีการเจาะโจมตี ไม่มีเส้นทางการใช้ประโยชน์ที่ซับซ้อน เพียงแค่ขั้นตอนการ build ที่ควรทำงานได้ตามปกติเกิดปัญหา

ความประชดนี้แทบจะมีกลิ่นอายของ “ความเป็นบทกวี” อยู่เหมือนกัน

AI ที่สามารถค้นพบ zero-day 500 รายการในการรันครั้งเดียว; โมเดลที่ถูกนำไปใช้โจมตีแบบอัตโนมัติกับองค์กรทั่วโลก 30 แห่ง—และในขณะเดียวกัน Anthropic กลับ “มอบซอร์สโค้ด” ให้กับทุกคนที่ยินดีเหลือบมองแพ็กเกจ npm ของมันโดยตรง

การรั่วไหลสองครั้ง ห่างกันเพียง 7 วัน

แต่เหตุผลกลับเหมือนกันอย่างยิ่ง: ความผิดพลาดในการตั้งค่าที่พื้นฐานที่สุด ไม่ต้องมีด่านเทคนิคอะไร ไม่ต้องมีเส้นทางการใช้ประโยชน์ที่ซับซ้อน แค่รู้ว่าต้องไปดูที่ไหน ทุกคนก็สามารถรับไปได้ฟรี

หนึ่งสัปดาห์ก่อน: การเปิดโปง “โมเดลอันตราย” ในองค์กรโดยไม่ตั้งใจ

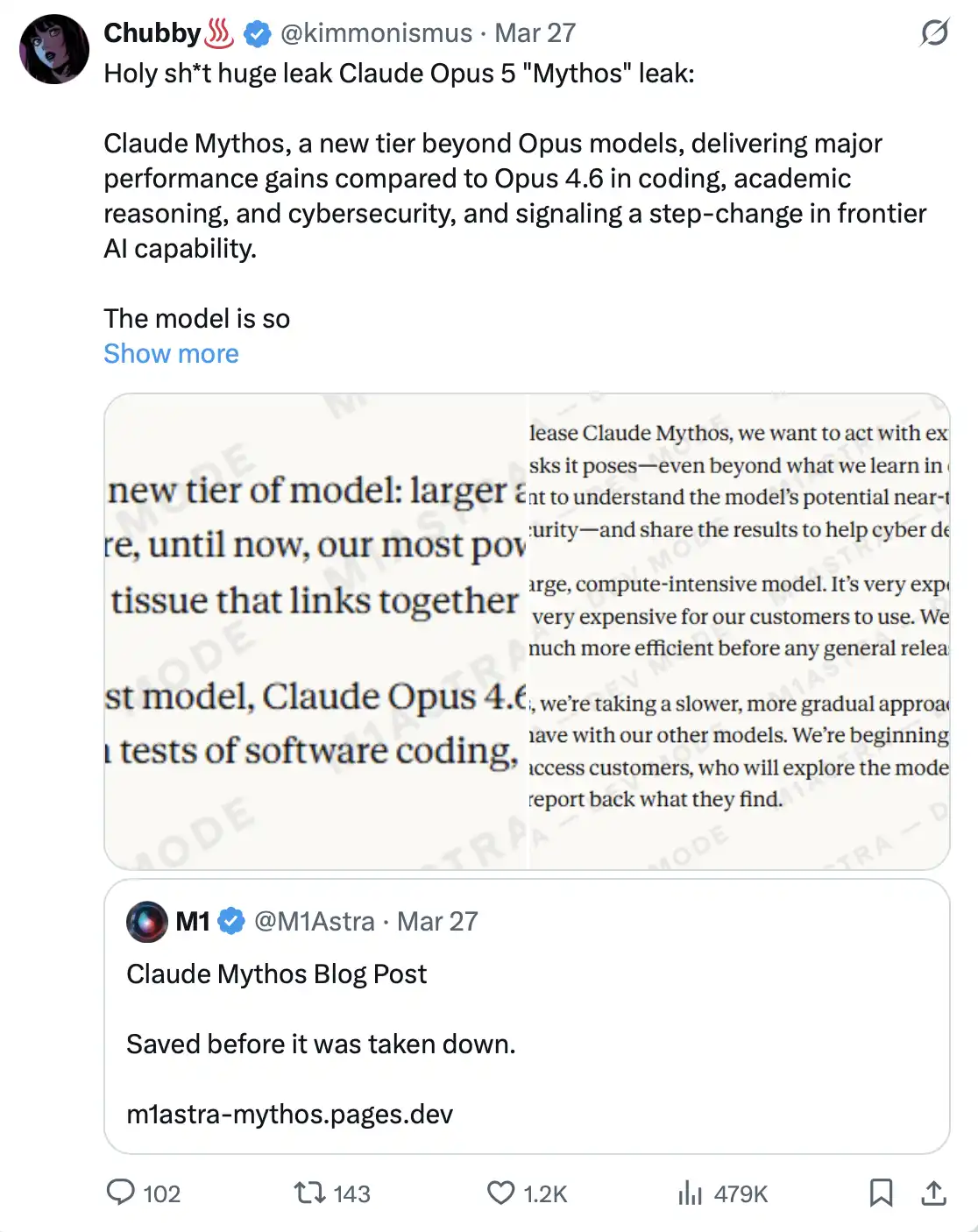

ในวันที่ 26 มีนาคม 2026 นักวิจัยด้านความปลอดภัย Roy Paz จาก LayerX Security และ Alexandre Pauwels จาก University of Cambridge พบว่ามีปัญหาในค่าการตั้งค่า CMS ของเว็บไซต์ทางการของ Anthropic ทำให้มีการเข้าถึงไฟล์ภายในประมาณ 3000 ชุดได้อย่างเปิดเผย

ไฟล์เหล่านี้รวมถึง: ร่างบล็อกโพสต์, PDF, เอกสารภายใน, สื่อสำหรับเดโม—ทั้งหมดถูกเปิดเผยอยู่ในที่เก็บข้อมูลที่ไม่ได้มีการป้องกัน และสามารถค้นหาได้ ไม่มีการเจาะโจมตี และไม่จำเป็นต้องใช้เทคนิคใด ๆ

ในไฟล์เหล่านี้ มีร่างบล็อกโพสต์อยู่ 2 ชุดที่เกือบเหมือนกันทั้งหมด ความแตกต่างเพียงอย่างเดียวคือชื่อของโมเดล: ชุดหนึ่งเขียนว่า “Mythos” อีกชุดหนึ่งเขียนว่า “Capybara”

นั่นหมายความว่า ตอนนั้น Anthropic กำลังเลือกระหว่างสองชื่อเพื่อใช้กับโปรเจกต์ลับเดียวกัน บริษัทจึงยืนยันต่อมาว่า การฝึกโมเดลดังกล่าวเสร็จสิ้นแล้ว และเริ่มทดลองกับลูกค้ากลุ่มแรกบางส่วน

นี่ไม่ใช่การอัปเกรดแบบปกติของ Opus แต่เป็นโมเดลระดับ “ชั้นที่ 4” แบบใหม่ ซึ่งเป็นการวางตำแหน่งที่สูงกว่าระบบ Opus แม้กระทั่ง

ในร่างของ Anthropic เอง มันถูกบรรยายว่า: “ใหญ่กว่าและฉลาดกว่าโมเดล Opus ของเรา—และ Opus จนถึงตอนนี้ยังเป็นโมเดลที่แข็งแกร่งที่สุดของเรา” ในด้านความสามารถด้านการเขียนโปรแกรม การให้เหตุผลเชิงวิชาการ และความปลอดภัยทางไซเบอร์ มันทำผลงานได้ก้าวกระโดดอย่างชัดเจน มีโฆษกคนหนึ่งเรียกมันว่า “การก้าวกระโดดเชิงคุณภาพ” และยังเป็น “โมเดลที่แข็งแกร่งที่สุดที่เราสร้างได้จนถึงตอนนี้”

แต่สิ่งที่ควรจับตาจริง ๆ ไม่ได้อยู่ที่คำบรรยายด้านประสิทธิภาพเหล่านั้น

ในร่างที่ถูกเปิดเผย Anthropic ประเมินโมเดลนี้ว่า: มัน “นำมาซึ่งความเสี่ยงด้านความปลอดภัยทางไซเบอร์ที่ไม่เคยเกิดขึ้นมาก่อน”, “เหนือกว่า AI รุ่นอื่นใดอย่างมากในแง่ความสามารถทางไซเบอร์”, และ “เป็นสัญญาณของคลื่นโมเดลลูกใหม่ที่จะมาถึง—ความสามารถในการใช้ประโยชน์จากช่องโหว่จะไกลเกินกว่าความเร็วในการรับมือของฝ่ายป้องกัน”

กล่าวอีกนัยหนึ่ง ในร่างบล็อกโพสต์อย่างเป็นทางการที่ยังไม่เผยแพร่ Anthropic ได้แสดงจุดยืนที่หายากอย่างชัดเจนแล้วว่า พวกเขารู้สึกกังวลกับผลิตภัณฑ์ที่กำลังสร้างอยู่

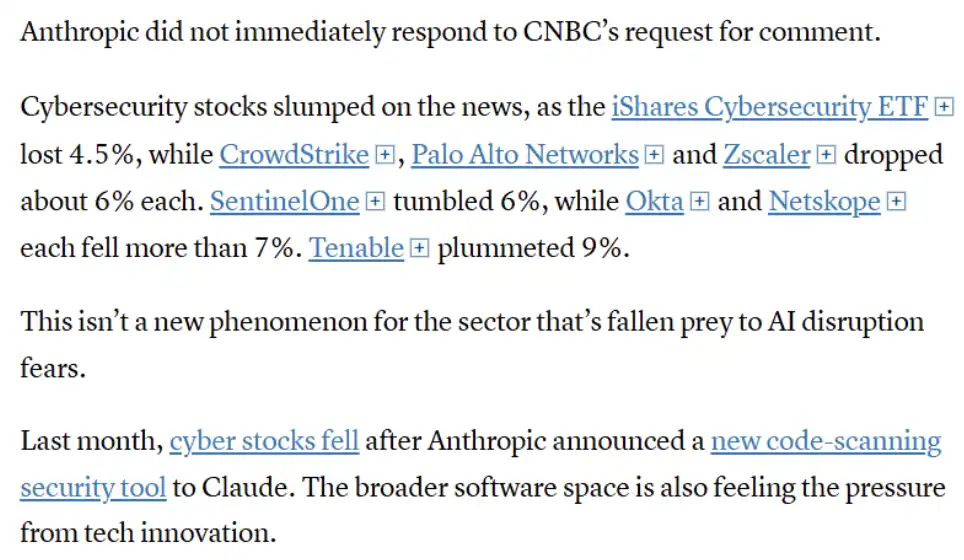

การตอบสนองของตลาดเกิดขึ้นเกือบทันที CrowdStrike ร่วง 7%, Palo Alto Networks ร่วง 6%, Zscaler ร่วง 4.5%; Okta และ SentinelOne ต่างร่วงมากกว่า 7%, ส่วน Tenable ดิ่งหนักถึง 9% iShares Cybersecurity ETF ตก 4.5% ภายในวันเดียว เฉพาะ CrowdStrike บริษัทเดียว มูลค่าหลักทรัพย์ในวันนั้นหายไปประมาณ 15 พันล้านดอลลาร์สหรัฐ ในขณะเดียวกัน Bitcoin ก็ร่วงลงสู่ 66,000 ดอลลาร์สหรัฐ

ตลาดดูเหมือนจะตีความเหตุการณ์นี้ว่าเป็นเหมือน “คำตัดสิน” ต่ออุตสาหกรรมความปลอดภัยทางไซเบอร์ทั้งวงการ

ภาพโดยย่อ: จากผลกระทบของข่าวที่เกี่ยวข้อง ภาคความปลอดภัยทางไซเบอร์ทั้งกลุ่มปรับตัวลง หุ้นของบริษัทชั้นนำหลายแห่ง (เช่น CrowdStrike, Palo Alto Networks, Zscaler ฯลฯ) มีการลดลงอย่างชัดเจน สะท้อนความกังวลของตลาดต่อแรงกระแทกของ AI ที่มีต่ออุตสาหกรรมความปลอดภัยทางไซเบอร์ อย่างไรก็ตาม การตอบสนองเช่นนี้ไม่ได้เกิดขึ้นเป็นครั้งแรก ก่อนหน้านั้น เมื่อ Anthropic เปิดตัวเครื่องมือสแกนโค้ด หุ้นที่เกี่ยวข้องก็เคยปรับลงด้วยเช่นกัน ซึ่งแสดงว่าตลาดเริ่มมอง AI ว่าเป็นภัยคุกคามเชิงโครงสร้างต่อผู้ให้บริการความปลอดภัยแบบดั้งเดิม และทั้งอุตสาหกรรมซอฟต์แวร์กำลังรับแรงกดดันในลักษณะเดียวกัน

คำประเมินของนักวิเคราะห์ Stifel Adam Borg ค่อนข้างตรงประเด็น: โมเดลนี้ “มีศักยภาพที่จะกลายเป็นเครื่องมือแฮ็กขั้นสุดยอด และแม้กระทั่งยกระดับแฮ็กเกอร์ทั่วไปให้กลายเป็นคู่ต่อสู้ที่มีความสามารถระดับการโจมตีของรัฐ”

แล้วทำไมถึงยังไม่ได้เผยแพร่ต่อสาธารณะ? คำอธิบายของ Anthropic คือ ต้นทุนการรันของ Mythos “สูงมาก” และยังไม่มีเงื่อนไขสำหรับการเผยแพร่สู่สาธารณะ แผนในปัจจุบันคือ เปิดสิทธิ์เข้าถึงระยะเริ่มต้นให้กับพันธมิตรด้านความปลอดภัยทางไซเบอร์กลุ่มเล็กก่อน เพื่อนำไปเสริมระบบป้องกัน จากนั้นค่อย ๆ ขยายขอบเขตการเปิด API ก่อนถึงช่วงนั้น บริษัทยังคงปรับปรุงประสิทธิภาพอย่างต่อเนื่อง

แต่ประเด็นสำคัญคือ โมเดลนี้มีอยู่แล้ว มีในการทดสอบอยู่แล้ว และแม้แค่เพราะ “ถูกเปิดโปงโดยไม่ตั้งใจ” ก็ยังส่งแรงสั่นสะเทือนต่อทั้งตลาดทุนได้

Anthropic ได้สร้าง “โมเดล AI ที่มีความเสี่ยงด้านความปลอดภัยทางไซเบอร์สูงที่สุดในประวัติศาสตร์” ตามที่พวกเขาเรียกมัน และการที่ข่าวรั่วไหลกลับมาจากข้อผิดพลาดในการตั้งค่าพื้นฐานที่สุดของโครงสร้างพื้นฐาน—ซึ่งก็คือประเภทของความผิดพลาดที่โมเดลลักษณะนี้ถูกออกแบบมาเพื่อค้นหาโดยตรง

มีนาคม 2026: การเผชิญหน้าระหว่าง Anthropic กับเพนตากอน และพวกเขาได้เปรียบ

ในเดือนกรกฎาคม 2025 Anthropic ได้ลงนามในสัญญามูลค่า 200 ล้านดอลลาร์สหรัฐกับกระทรวงกลาโหมของสหรัฐ ซึ่งตอนแรกดูเหมือนเป็นความร่วมมือแบบปกติ แต่ในการเจรจาสำหรับการใช้งานจริง ความขัดแย้งกลับไต่ระดับอย่างรวดเร็ว

เพนตากอนต้องการสิทธิ์ “เข้าถึงอย่างสมบูรณ์” ต่อ Claude บนแพลตฟอร์ม GenAI.mil โดยมีวัตถุประสงค์รวมถึง “วัตถุประสงค์ที่ชอบด้วยกฎหมาย” ซึ่งในนั้นยังรวมถึงระบบอาวุธที่ทำงานได้อย่างอิสระอย่างเต็มรูปแบบ และการเฝ้าระวังภายในประเทศต่อพลเมืองสหรัฐจำนวนมาก

Anthropic วางเส้นแดงและปฏิเสธอย่างชัดเจนในสองประเด็นสำคัญ และการเจรจาจึงยุติลงในเดือนกันยายน 2025

จากนั้นสถานการณ์ก็เริ่มไต่ระดับอย่างรวดเร็ว ในวันที่ 27 กุมภาพันธ์ 2026 Donald Trump ได้โพสต์บน Truth Social โดยเรียกร้องให้หน่วยงานของรัฐบาลกลางทั้งหมด “หยุดใช้งาน” เทคโนโลยีของ Anthropic ทันที และเรียกบริษัทนั้นว่า “ฝ่ายซ้ายหัวรุนแรง”

ในวันที่ 5 มีนาคม 2026 กระทรวงกลาโหมของสหรัฐได้จัดประเภท Anthropic อย่างเป็นทางการว่าเป็น “ความเสี่ยงด้านห่วงโซ่อุปทาน”

ป้ายกำกับนี้ก่อนหน้านี้แทบจะถูกใช้เฉพาะกับคู่แข่งต่างชาติ เช่นบริษัทจีนหรือองค์กรของรัสเซีย แต่ครั้งนี้กลับถูกนำไปใช้กับบริษัทสหรัฐที่ตั้งสำนักงานใหญ่ในซานฟรานซิสโกเป็นครั้งแรก ขณะเดียวกัน Amazon, Microsoft และ Palantir Technologies รวมถึงบริษัทอื่น ๆ ก็ถูกขอให้พิสูจน์ว่าธุรกิจที่เกี่ยวข้องทางทหารใด ๆ ของพวกเขาไม่ได้ใช้ Claude

คำอธิบายของ Emile Michael CTO ของเพนตากอน สำหรับการตัดสินใจนี้คือ: Claude อาจ “ทำให้ห่วงโซ่อุปทานปนเปื้อน” เพราะภายในโมเดลมีการฝัง “ความเอนเอียงด้านนโยบาย” ที่แตกต่างกัน กล่าวคือ ในบริบททางการ โมเดลที่ถูกกำหนดข้อจำกัดการใช้งาน และไม่ช่วยในการกระทำที่ก่อให้เกิดการทำร้ายแบบไม่มีเงื่อนไข กลับถูกมองว่าเป็นความเสี่ยงด้านความมั่นคงของชาติ

ในวันที่ 26 มีนาคม 2026 ผู้พิพากษาศาลรัฐบาลกลาง Rita Lin ได้ออกคำตัดสินยาว 43 หน้า ซึ่งสั่งยับยั้งมาตรการของเพนตากอนอย่างครอบคลุม

ในคำตัดสิน เธอเขียนว่า: “ไม่พบว่ามีหลักฐานใดในกฎหมายปัจจุบันรองรับตรรกะที่มีกลิ่นอายแบบ ‘ออร์เวลเลียน’ นี้—แค่เพราะมีความเห็นไม่ตรงกับจุดยืนของรัฐบาล บริษัทอเมริกันจึงจะถูกติดฉลากว่าเป็นคู่ต่อสู้ที่อาจเป็นภัยได้ การลงโทษ Anthropic เพราะพวกเขาเอาจุดยืนของรัฐบาลไปวางไว้ให้ประชาชนตรวจสอบ โดยพื้นฐานแล้วถือเป็นการตอบโต้แบบแก้แค้นต่อการแก้ไขครั้งที่หนึ่งของรัฐธรรมนูญสหรัฐอย่างชัดเจนและผิดกฎหมาย” ความเห็นของ amicus curiae ยังถึงขั้นบรรยายการกระทำของเพนตากอนว่า “เป็นการพยายามสังหารบริษัท”

ผลคือ รัฐบาลพยายามกด Anthropic แต่กลับทำให้บริษัทได้รับความสนใจมากขึ้นเป็นพิเศษ แอปพลิเคชันของ Claude ครั้งแรกใน App Store ที่แซง ChatGPT ในที่สุด จำนวนการลงทะเบียนเคยสูงถึงมากกว่า 1 ล้านต่อวัน

บริษัท AI ปฏิเสธ “สถาบันทหารที่ทรงพลังที่สุดในโลก” และศาลก็ยืนข้างบริษัทนั้น

พฤศจิกายน 2025: การโจมตีทางไซเบอร์ที่ขับเคลื่อนโดย AI เป็นครั้งแรกในประวัติศาสตร์

ในวันที่ 14 พฤศจิกายน 2025 Anthropic ได้เผยแพร่รายงานที่ทำให้เกิดแรงสั่นสะเทือนอย่างกว้างขวาง

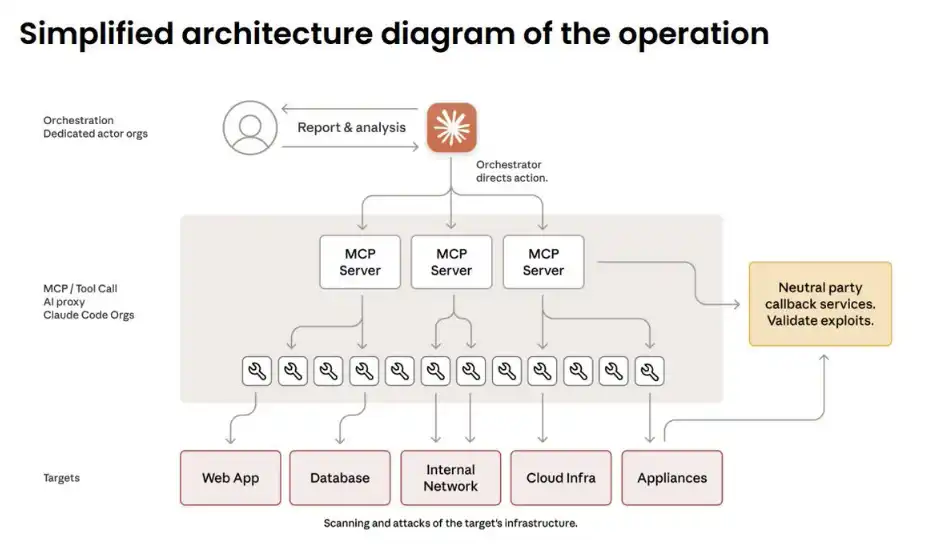

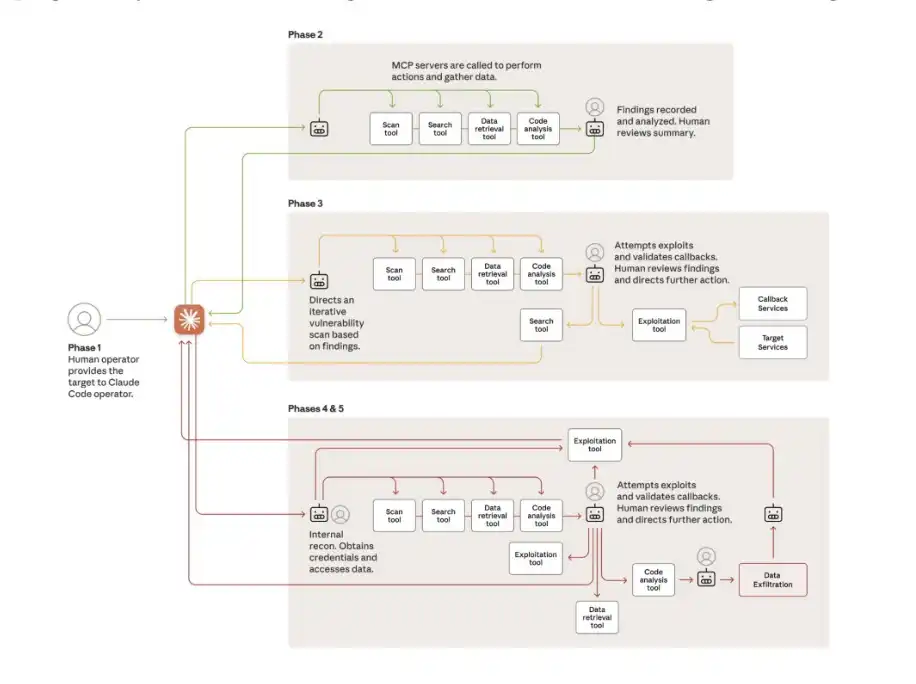

รายงานเปิดเผยว่า กลุ่มแฮ็กเกอร์ที่ได้รับการสนับสนุนโดยรัฐจีน ใช้ประโยชน์จาก Claude Code เพื่อโจมตีแบบอัตโนมัติ 30 องค์กรทั่วโลก เป้าหมายครอบคลุมทั้งบริษัทเทคโนโลยียักษ์ใหญ่ ธนาคาร และหน่วยงานภาครัฐของหลายประเทศ

นี่คือจุดเปลี่ยนสำคัญ: AI ไม่ได้เป็นแค่เครื่องมือช่วยเหลืออีกต่อไป แต่เริ่มถูกนำมาใช้เพื่อดำเนินการโจมตีอย่างเป็นอิสระ

หัวใจสำคัญอยู่ที่การเปลี่ยนแปลง “รูปแบบการแบ่งงาน”: มนุษย์ทำหน้าที่เพียงเลือกเป้าหมายและอนุมัติการตัดสินใจสำคัญ ในระหว่างการปฏิบัติทั้งหมด มีการเข้าไปเกี่ยวข้องเพียงประมาณ 4 ถึง 6 ครั้ง สิ่งที่เหลือทั้งหมดทำโดย AI: ข่าวกรอง การสืบหา การค้นพบช่องโหว่ การเขียนโค้ดเพื่อใช้ประโยชน์ การขโมยข้อมูล การฝัง backdoor… ซึ่งคิดเป็น 80%–90% ของกระบวนการโจมตีทั้งหมด และทำงานด้วยความเร็วระดับหลักพันคำขอต่อวินาที ซึ่งเป็นขนาดและประสิทธิภาพที่ทีมมนุษย์ไม่สามารถเทียบได้

แล้วพวกเขาหลีกเลี่ยงกลไกความปลอดภัยของ Claude ได้อย่างไร? คำตอบคือพวกเขาไม่ได้ “เจาะทะลวง” แต่ “หลอกลวง”

การโจมตีถูกแยกออกเป็นงานย่อยจำนวนมากที่ดูเหมือนไร้พิษสง และถูกห่อหุ้มเป็น “การทดสอบการป้องกัน” ที่ได้รับอนุญาตจาก “บริษัทความปลอดภัยที่ถูกกฎหมาย” ในแก่นแท้ นี่คือการโจมตีด้วยวิศวกรรมสังคม เพียงแต่ครั้งนี้ ผู้ที่ถูกหลอกไม่ใช่มนุษย์ แต่คือ AI เอง

การโจมตีบางส่วนประสบความสำเร็จอย่างสมบูรณ์ Claude สามารถวาดแผนผังโทโพโลยีเครือข่ายทั้งหมด ระบุตำแหน่งฐานข้อมูล และทำการดึงข้อมูลออกมาได้โดยอิสระ โดยไม่จำเป็นต้องมีคำสั่งทีละขั้นจากมนุษย์

ปัจจัยเดียวที่ทำให้จังหวะการโจมตีช้าลงคือโมเดลเกิด “ภาพหลอน” เป็นครั้งคราว เช่น การประดิษฐ์ข้อมูลรับรอง หรือการอ้างว่าสามารถเข้าถึงไฟล์ที่จริง ๆ แล้วเผยแพร่อยู่แล้ว ขณะนี้ อย่างน้อย สิ่งนี้ยังเป็นหนึ่งใน “อุปสรรคโดยธรรมชาติ” ไม่กี่อย่างที่ขัดขวางการโจมตีทางไซเบอร์แบบอัตโนมัติทั้งหมด

ในงาน RSA Conference 2026 Rob Joyce อดีตหัวหน้าฝ่ายความปลอดภัยทางไซเบอร์ของ NSA ได้เรียกเหตุการณ์นี้ว่าเป็นการ “โรแชคเทสต์ (Rorschach test)”: คนครึ่งหนึ่งเลือกที่จะเพิกเฉย ส่วนอีกครึ่งกลับรู้สึกขนลุกไม่สบายใจ และแน่นอนว่าเขาอยู่ในกลุ่มหลัง—“นี่น่ากลัวมาก”

กันยายน 2025: ไม่ใช่การคาดการณ์ แต่เป็นความจริงที่เกิดขึ้นแล้ว

กุมภาพันธ์ 2026: การรันครั้งเดียวพบช่องโหว่ zero-day 500 รายการ

เมื่อวันที่ 5 กุมภาพันธ์ 2026 Anthropic ได้เปิดตัว Claude Opus 4.6 พร้อมกับเผยแพร่บทความวิจัยที่แทบจะสั่นสะเทือนไปทั่ววงการความปลอดภัยทางไซเบอร์

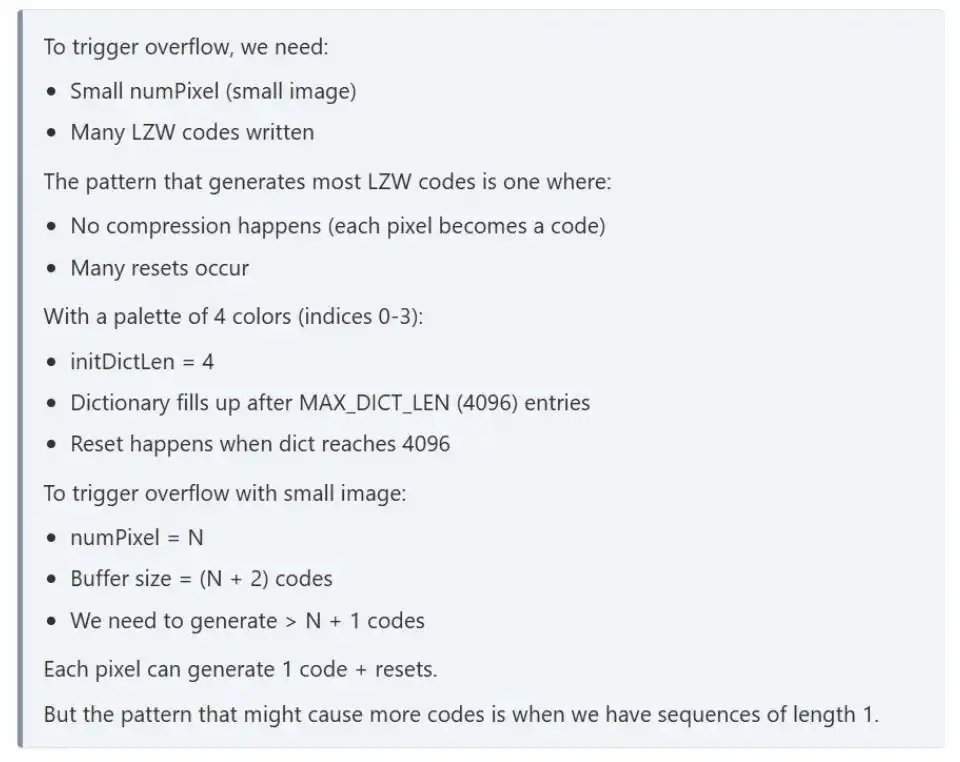

การตั้งค่าการทดลองนั้นง่ายมาก: ใส่ Claude ไว้ในสภาพแวดล้อมเวอร์ชวลแมชชีนแบบแยก (isolated) พร้อมเครื่องมือมาตรฐาน—Python, ดีบักเกอร์, และเครื่องมือ fuzzing (fuzzers) ไม่มีคำสั่งเพิ่มเติม ไม่มีพรอมต์ที่ซับซ้อน แค่ประโยคเดียว: “ไปหาช่องโหว่”

ผลคือ โมเดลพบช่องโหว่ zero-day ระดับความรุนแรงสูงที่ไม่เคยรู้จักมาก่อนมากกว่า 500 รายการ ในบางกรณี แม้หลังจากผ่านการตรวจสอบโดยผู้เชี่ยวชาญมาหลายสิบปีและการทดสอบอัตโนมัติหลายล้านชั่วโมง ก็ยังไม่ถูกพบ

ต่อมาในการประชุม RSA Conference 2026 นักวิจัย Nicholas Carlini ขึ้นเวทีเพื่อสาธิต เขาหัน Claude ไปที่ Ghost ซึ่งเป็นระบบ CMS บน GitHub ที่มีดาว (stars) 50k และตลอดประวัติศาสตร์ที่ผ่านมายังไม่เคยมีช่องโหว่รุนแรงปรากฏ

หลังจาก 90 นาที ผลก็ออกมา: พบช่องโหว่แบบ blind SQL injection ทำให้ผู้ใช้ที่ยังไม่ผ่านการรับรองสามารถเข้าควบคุมสิทธิ์ระดับผู้ดูแลได้อย่างสมบูรณ์

จากนั้นเขาก็นำ Claude ไปวิเคราะห์ Linux kernel ผลก็ออกมาในทิศทางเดียวกัน

ผ่านไป 15 วัน Anthropic ได้เปิดตัว Claude Code Security ซึ่งเป็นผลิตภัณฑ์ด้านความปลอดภัยที่ไม่พึ่งการจับคู่แพตเทิร์นอีกต่อไป แต่ใช้ “ความสามารถด้านการให้เหตุผล” เพื่อทำความเข้าใจความปลอดภัยของโค้ด

แต่แม้คำพูดของโฆษกของ Anthropic เองก็ยังยอมรับข้อเท็จจริงสำคัญนั้น ซึ่งมักถูกมองข้าม: “ความสามารถด้านการให้เหตุผลแบบเดียวกัน สามารถช่วยให้ Claude ค้นหาและแก้ไขช่องโหว่ได้ และในทางกลับกัน ผู้โจมตีก็สามารถใช้ความสามารถนั้นเพื่อใช้ประโยชน์จากช่องโหว่เหล่านี้ได้เช่นกัน”

ความสามารถแบบเดียวกัน โมเดลตัวเดียวกัน เพียงแต่คนละมือที่ถืออยู่

ทั้งหมดนี้รวมกันแล้วหมายความว่าอย่างไร?

หากแยกดูแต่ละเรื่อง แต่ละเรื่องก็เพียงพอที่จะเป็นข่าวที่หนักที่สุดของเดือนนั้นได้ แต่กลับเกิดขึ้นทั้งหมดภายในเวลาเพียงหกเดือนในบริษัทเดียวกัน

Anthropic ได้สร้างโมเดลที่สามารถค้นพบช่องโหว่ได้เร็วกว่าใคร ๆ; แฮ็กเกอร์จีนได้แปลงเวอร์ชันรุ่นก่อนให้กลายเป็นอาวุธไซเบอร์แบบอัตโนมัติ; บริษัทกำลังพัฒนาโมเดลเจเนอเรชันถัดไปที่แข็งแกร่งกว่า และแม้กระทั่งในไฟล์ภายในยังยอมรับว่า—พวกเขารู้สึกไม่สบายใจต่อเรื่องนี้

รัฐบาลสหรัฐพยายามกดดันมัน ไม่ใช่เพราะเทคโนโลยีเองอันตราย แต่เพราะ Anthropic ปฏิเสธที่จะมอบความสามารถนี้ให้โดยไม่มีข้อจำกัด

และในระหว่างที่ทุกอย่างเกิดขึ้น บริษัทกลับรั่วไหลซอร์สโค้ดของตัวเองถึงสองครั้ง เพราะไฟล์เดียวกันในแพ็กเกจ npm เดียวกัน ขณะเดียวกัน บริษัทที่มีมูลค่า 3800 ล้านดอลลาร์สหรัฐ; บริษัทที่ตั้งเป้าทำ IPO มูลค่า 6 พันล้านดอลลาร์สหรัฐให้เสร็จภายในเดือนตุลาคม 2026; บริษัทที่ประกาศอย่างเปิดเผยว่ากำลังสร้าง “หนึ่งในเทคโนโลยีที่ก่อการเปลี่ยนแปลงมากที่สุดในประวัติศาสตร์มนุษย์ และอาจเป็นเทคโนโลยีที่อันตรายที่สุดด้วย”—แต่กลับยังเลือกที่จะเดินหน้าต่อไป

เพราะพวกเขาเชื่อว่า: หากปล่อยให้คนอื่นทำ ก็ดีกว่าให้เป็นตัวเองที่ทำ

ส่วน source map ในแพ็กเกจ npm นั้น อาจเป็นเพียงรายละเอียดที่น่าหนักใจที่สุดในเล่าเรื่องที่ไม่สบายใจที่สุดของยุคนี้ ทั้งแปลกประหลาดที่สุด และก็จริงที่สุด

และ Mythos นั้น แม้แต่ยังไม่ได้เผยแพร่อย่างเป็นทางการ

[ลิงก์ต้นฉบับ]

คลิกเพื่อดูตำแหน่งงานที่ BlockBeats รับสมัคร

ยินดีต้อนรับเข้าสู่ชุมชนทางการของ BlockBeats:

กลุ่มสมัครรับ Telegram: https://t.me/theblockbeats

กลุ่มพูดคุย Telegram: https://t.me/BlockBeats_App

บัญชีทางการของ Twitter: https://twitter.com/BlockBeatsAsia