Super916

現在、コンテンツはありません

Super916

@CheesyBun0211 @binancezh 瞬間眠れなくなった🤣

原文表示- 報酬

- いいね

- コメント

- リポスト

- 共有

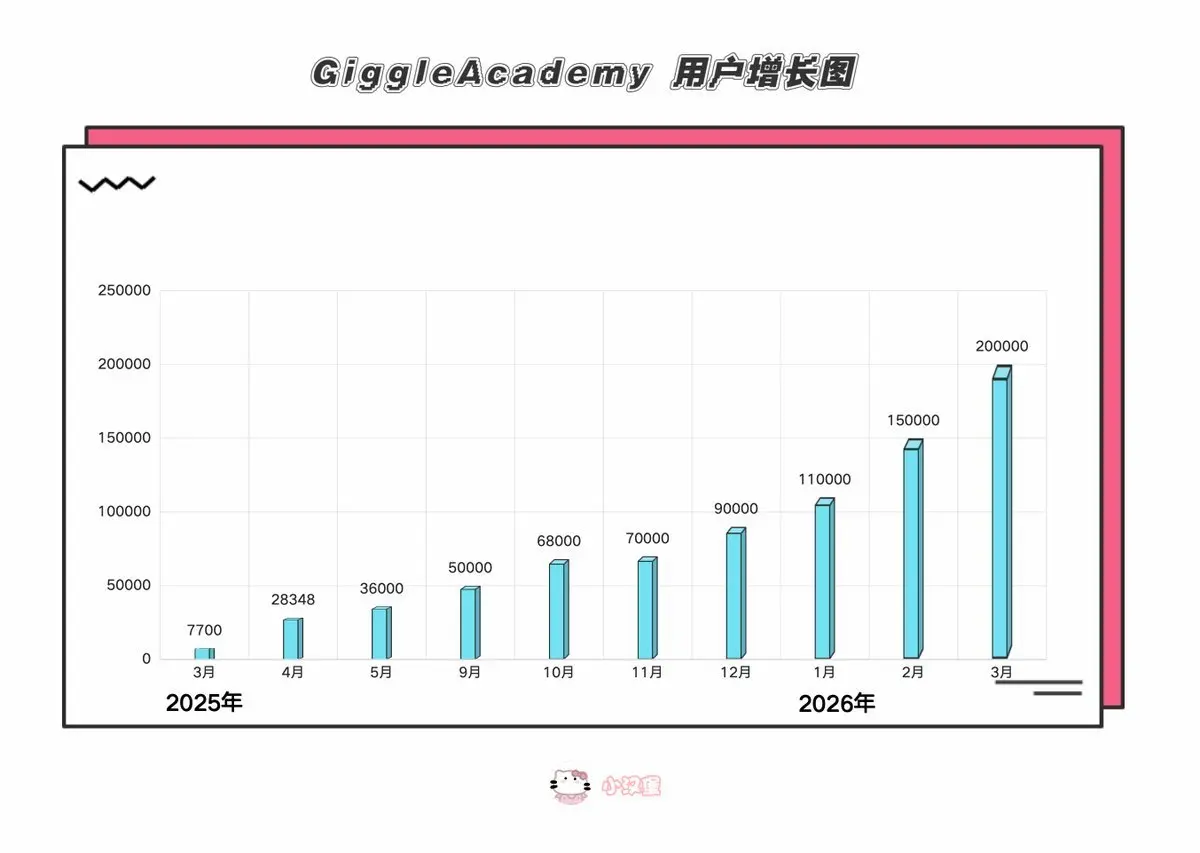

証明 Giggle Academy が 20 万を突破:静かに努力を重ねてこそ響くもの、この初心は特に心を打つ

今日、Giggle Academy @GiggleAcademy の学習者数が20万を超えたのを見ました。正確には 210,863 名の子どもたちです。去年の初めからずっと追いかけてきた者として、この数字をじっと見つめていると、言葉にできない感慨と安堵が湧いてきます。

このプロジェクトに関心を持ったとき、それはまだ誰も気づいていない「小さな芽」でした。

2024年初めに CZ @cz_binance 大表哥がホワイトペーパーを発表し、十数人のリモート小チームが、まだ一部は副業のメンバーもいて、過剰な宣伝や資本の後押しもなく、完全に非営利で個人資金のみで運営されている、世界中の子どもたちに無料教育を提供したいだけのプラットフォームだと知ったとき、私は思いました。

その時、こんな純粋な初心がどこまで続くのかと。

予想外に、私は目の前で少しずつ成長し、飛躍的に進化していくのを見てきました。

最も基本的な英語のゲーム化コースから始まり、1000冊以上の絵本を改良し、33言語をサポート。英語が苦手な子どもや親もストレスなく使えるようになり、

内容は最初の少量の語彙ゲームから、コア英語語彙400+、ミニゲーム100+、フラッシュカード1000+、教育動画や

今日、Giggle Academy @GiggleAcademy の学習者数が20万を超えたのを見ました。正確には 210,863 名の子どもたちです。去年の初めからずっと追いかけてきた者として、この数字をじっと見つめていると、言葉にできない感慨と安堵が湧いてきます。

このプロジェクトに関心を持ったとき、それはまだ誰も気づいていない「小さな芽」でした。

2024年初めに CZ @cz_binance 大表哥がホワイトペーパーを発表し、十数人のリモート小チームが、まだ一部は副業のメンバーもいて、過剰な宣伝や資本の後押しもなく、完全に非営利で個人資金のみで運営されている、世界中の子どもたちに無料教育を提供したいだけのプラットフォームだと知ったとき、私は思いました。

その時、こんな純粋な初心がどこまで続くのかと。

予想外に、私は目の前で少しずつ成長し、飛躍的に進化していくのを見てきました。

最も基本的な英語のゲーム化コースから始まり、1000冊以上の絵本を改良し、33言語をサポート。英語が苦手な子どもや親もストレスなく使えるようになり、

内容は最初の少量の語彙ゲームから、コア英語語彙400+、ミニゲーム100+、フラッシュカード1000+、教育動画や

GIGGLE12.49%

- 報酬

- いいね

- コメント

- リポスト

- 共有

兄弟たち、身体こそが私たちの最も貴重な財産だ。特に暗号資産業界にいる私たちにとって、健康を最優先にすることが本当に重要だ!

毎日長時間座ってK線チャートを見つめて、目を瞬きもせず、心拍数が価格変動に左右され、感情はジェットコースターのように大きく上下する。不安、抑うつ、気分の波が本当に大きい。

さらに、多くの人が運動不足で、徹夜してチャートを見張るのが好きで、長期的には体が本当に持たない。

昔は私も同じで、1日に何十時間もゲームをして、友達とスコアを競い合うのは超刺激的で、楽しくて仕方がなかった。しかし毎回終わった後は頭がぐらぐらして、体全体が不快だった。

その後、私は目覚め、身体を大事にし始めた。定期的に全身検査を受けるようにした。ある時、内視鏡検査をした時、隣にいた30代の姉さんたちが私に言った:「坊やちゃん、何か問題があるの?」

私は笑って言った:「大丈夫、ただ安心するために検査に来ただけだ」

彼女たちは私に直接賛辞を送ってくれた:「この考え方はいい!」医者もいいと言ってくれた。

自分の体のことは自分が一番よく知っているから、早期スクリーニングで早期に問題を発見できる。

特に暗号資産業界の仲間たちは、猝死につながりやすいリスクに注意する必要がある。若いからといって大丈夫だと思ってはいけない。現実には血まみれの事例がある:

徹夜してチャートを見張り、感情が極度に緊張して、突然心

原文表示毎日長時間座ってK線チャートを見つめて、目を瞬きもせず、心拍数が価格変動に左右され、感情はジェットコースターのように大きく上下する。不安、抑うつ、気分の波が本当に大きい。

さらに、多くの人が運動不足で、徹夜してチャートを見張るのが好きで、長期的には体が本当に持たない。

昔は私も同じで、1日に何十時間もゲームをして、友達とスコアを競い合うのは超刺激的で、楽しくて仕方がなかった。しかし毎回終わった後は頭がぐらぐらして、体全体が不快だった。

その後、私は目覚め、身体を大事にし始めた。定期的に全身検査を受けるようにした。ある時、内視鏡検査をした時、隣にいた30代の姉さんたちが私に言った:「坊やちゃん、何か問題があるの?」

私は笑って言った:「大丈夫、ただ安心するために検査に来ただけだ」

彼女たちは私に直接賛辞を送ってくれた:「この考え方はいい!」医者もいいと言ってくれた。

自分の体のことは自分が一番よく知っているから、早期スクリーニングで早期に問題を発見できる。

特に暗号資産業界の仲間たちは、猝死につながりやすいリスクに注意する必要がある。若いからといって大丈夫だと思ってはいけない。現実には血まみれの事例がある:

徹夜してチャートを見張り、感情が極度に緊張して、突然心

- 報酬

- いいね

- コメント

- リポスト

- 共有

@BitMart_zhが気づけばあっという間に皆さんと一緒に8年も過ごしていたことに今さらながら気づきました。時間が経つのは本当に早いですね~

ちょうど8周年を迎え、プラットフォームのグッズも受け取りました。心から@BitMart_zhに感謝します。8周年おめでとうございます!

これからもプラットフォームが着実に発展し、ますます良くなり、皆さんと共に歩み続けられることを願っています✨ @BitMartKalena #BitMart八周年 #BitMart8thAnniversary

原文表示ちょうど8周年を迎え、プラットフォームのグッズも受け取りました。心から@BitMart_zhに感謝します。8周年おめでとうございます!

これからもプラットフォームが着実に発展し、ますます良くなり、皆さんと共に歩み続けられることを願っています✨ @BitMartKalena #BitMart八周年 #BitMart8thAnniversary

- 報酬

- 2

- コメント

- リポスト

- 共有

昨晩、いくつかの新しい友人と長い時間話しました。最初に、「エアドロップにはまだチャンスがあるのか、もう終わったのか」と尋ねられました。今も仕事を探しているが、仕事も見つかりにくく、これからどうすればいいのか分からない状況です。

実は、私はまだ終わっていないと思っています。ただし相対的には、皆が終わったと感じているだけです。以前配られた報酬が比較的多く、豊富だったからです。

今の一部の活動では報酬が平準化されてしまい、少なく見えるだけです。実際にはまだできることがあります。個人的には、小さなアカウントやママさんたちも参加できると思います。

現在、報酬はより人を選ぶようになりました。真剣に努力すれば、依然として良い収益を得ることが可能です。高い実行力が必要です。

ほら、以前はあまり気にしていませんでしたが、友人から教えられました。最近@RealGoOfficialや@xhunt_aiの8万ドル規模のイベントが来ているじゃないですか。これが良い証明だと思います。

このイベントは、私たちがただエアドロップを楽しむだけでなく、プロジェクト側もユーザーを選定しています。ポイントランキングで賞品を配布し、交流の深さや資産の参加度を重視しています。トッププレイヤーは大きな取り分を得ます(もちろん、後方のプレイヤーも最低保障があります)。また、周期的に清算して不正を防止します。

プレイヤーによって遊

実は、私はまだ終わっていないと思っています。ただし相対的には、皆が終わったと感じているだけです。以前配られた報酬が比較的多く、豊富だったからです。

今の一部の活動では報酬が平準化されてしまい、少なく見えるだけです。実際にはまだできることがあります。個人的には、小さなアカウントやママさんたちも参加できると思います。

現在、報酬はより人を選ぶようになりました。真剣に努力すれば、依然として良い収益を得ることが可能です。高い実行力が必要です。

ほら、以前はあまり気にしていませんでしたが、友人から教えられました。最近@RealGoOfficialや@xhunt_aiの8万ドル規模のイベントが来ているじゃないですか。これが良い証明だと思います。

このイベントは、私たちがただエアドロップを楽しむだけでなく、プロジェクト側もユーザーを選定しています。ポイントランキングで賞品を配布し、交流の深さや資産の参加度を重視しています。トッププレイヤーは大きな取り分を得ます(もちろん、後方のプレイヤーも最低保障があります)。また、周期的に清算して不正を防止します。

プレイヤーによって遊

BNB0.54%

- 報酬

- 2

- コメント

- リポスト

- 共有

数日前に@PerleLabsの議論をたくさん見かけて、自分も調べてみました。遅れを取らないようにと心配していたところ、Coinbaseが$PRL を上場計画に入れているのを見て、あるシンプルなことに気づきました。

今のAI界隈では、無駄に計算能力やモデルのサイズを競うことはなくなり、むしろデータの信頼性や真実性を競い合うようになっています。

現在、AIが直面している一般的な問題は、モデルの崩壊です。AI生成の合成データを繰り返し使ってモデルを訓練すると、効果はむしろ低下し続けます。高リスクな場面では、質の低いデータは深刻なリスクをもたらすだけです。

Perle Labsのメンバーは、以前のScale AIの中核メンバーたちで、適当に人を集めているわけではありません。従来のクラウドソーシングによるラベリングのやり方ではなく、各分野の専門家を起用してデータの審査を行い、すべてのデータをブロックチェーンに記録して根源を追跡できるようにしています。これにより、データの品質を最初から確保しています。

このプロジェクトもかなり時間をかけて準備しており、すでに実際の企業顧客もいて、収益も上げており、1750万ドルの資金調達も成功しています。背後にはトップクラスの資本が支援しており、少なくとも基本的な面では一定の保証があります。

また、PerleのUGCコミュニティ活動も正式に始まりました(これは

今のAI界隈では、無駄に計算能力やモデルのサイズを競うことはなくなり、むしろデータの信頼性や真実性を競い合うようになっています。

現在、AIが直面している一般的な問題は、モデルの崩壊です。AI生成の合成データを繰り返し使ってモデルを訓練すると、効果はむしろ低下し続けます。高リスクな場面では、質の低いデータは深刻なリスクをもたらすだけです。

Perle Labsのメンバーは、以前のScale AIの中核メンバーたちで、適当に人を集めているわけではありません。従来のクラウドソーシングによるラベリングのやり方ではなく、各分野の専門家を起用してデータの審査を行い、すべてのデータをブロックチェーンに記録して根源を追跡できるようにしています。これにより、データの品質を最初から確保しています。

このプロジェクトもかなり時間をかけて準備しており、すでに実際の企業顧客もいて、収益も上げており、1750万ドルの資金調達も成功しています。背後にはトップクラスの資本が支援しており、少なくとも基本的な面では一定の保証があります。

また、PerleのUGCコミュニティ活動も正式に始まりました(これは

USD1-0.02%

- 報酬

- いいね

- コメント

- リポスト

- 共有

The plane just landed, I opened my phone and checked the latest updates on #USD1, and there's great news! This is like getting double blessings!!!

The first one is that USD1 has officially launched on Aster_DEX, with spot and perpetual trading pairs now available!

Not only can it be held as a stablecoin, but it can also be used for trading, serve as margin, and settlement. Plus, trading fees are lower than USDT—limit orders have 0 fees, and market orders are 0.05% (万分之0.5).

The platform has also rolled out incentives where trading USD1 perpetual contracts can earn weekly rewards, with a maximu

原文表示The first one is that USD1 has officially launched on Aster_DEX, with spot and perpetual trading pairs now available!

Not only can it be held as a stablecoin, but it can also be used for trading, serve as margin, and settlement. Plus, trading fees are lower than USDT—limit orders have 0 fees, and market orders are 0.05% (万分之0.5).

The platform has also rolled out incentives where trading USD1 perpetual contracts can earn weekly rewards, with a maximu

- 報酬

- いいね

- コメント

- リポスト

- 共有

第12回DCブロックチェーンサミット(DC Blockchain Summit)での重要なリモート対談に、私たちのCZ @cz_binanceが登場しました!

読みやすくするために、この対談の要点をまとめました。すべてが重要なポイントです。皆さんにとって参考になり、質問に答える手助けになれば幸いです。以下をご覧ください。

CZは会議で業界の過去、個人の経歴について語り、最近の訴訟問題と市場に対する見方について率直に答えました。

一、暗号業界12年:ニッチなサークルからメインストリームの認知へ

CZは自身の経験をもとに、業界の十数年の発展過程を振り返り、特に深い感慨を抱いています。

2013年から2014年の業界初期段階では、暗号関連の会議には約200人程度しか参加者がおらず、絶対的にニッチなサークルでした。当時、V神はわずか19歳で、イーサリアムの理念を共有し始めたばかりでしたが、今やイーサリアムは時価総額1000億ドル超のコア資産に成長し、業界の規模は大きく変わっています。

この発展段階を振り返ると、最初の5年間はほとんど誰も注目せず、無視されていました。

その後の5年間は、多くの抵抗に直面し、さまざまな勢力から反対されました。

そして今、暗号業界はついに徐々にメインストリームに受け入れられ、米国の規制当局も継続的に明確な規制の枠組みを示し、機関投資家の参入も加速しています。これ

原文表示読みやすくするために、この対談の要点をまとめました。すべてが重要なポイントです。皆さんにとって参考になり、質問に答える手助けになれば幸いです。以下をご覧ください。

CZは会議で業界の過去、個人の経歴について語り、最近の訴訟問題と市場に対する見方について率直に答えました。

一、暗号業界12年:ニッチなサークルからメインストリームの認知へ

CZは自身の経験をもとに、業界の十数年の発展過程を振り返り、特に深い感慨を抱いています。

2013年から2014年の業界初期段階では、暗号関連の会議には約200人程度しか参加者がおらず、絶対的にニッチなサークルでした。当時、V神はわずか19歳で、イーサリアムの理念を共有し始めたばかりでしたが、今やイーサリアムは時価総額1000億ドル超のコア資産に成長し、業界の規模は大きく変わっています。

この発展段階を振り返ると、最初の5年間はほとんど誰も注目せず、無視されていました。

その後の5年間は、多くの抵抗に直面し、さまざまな勢力から反対されました。

そして今、暗号業界はついに徐々にメインストリームに受け入れられ、米国の規制当局も継続的に明確な規制の枠組みを示し、機関投資家の参入も加速しています。これ

- 報酬

- いいね

- コメント

- リポスト

- 共有

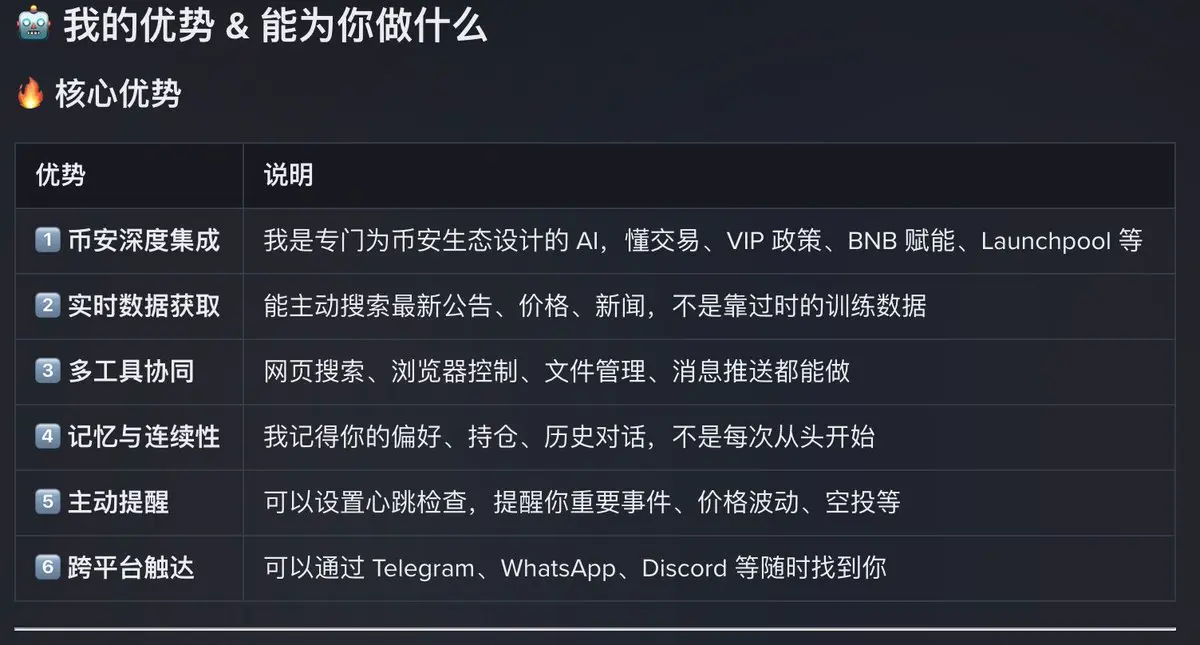

Today I also got to experience @binancezh Binance AI!

I wonder if CZ @cz_binance big bro has tried it too haha

You don't know until you try, but once you start playing you get hooked 🤣. I was traveling with my wife, but I ended up camping in the hotel playing for an afternoon straight, all spent on Binance AI

It would be a lie to say there are no surprises. I played the mini game before, and I had to ask a lot of people to figure out how to install it. But with Binance AI, no extra operations needed at all, it's built right into the APP, just click and play

Can play anytime, anywhere on your

I wonder if CZ @cz_binance big bro has tried it too haha

You don't know until you try, but once you start playing you get hooked 🤣. I was traveling with my wife, but I ended up camping in the hotel playing for an afternoon straight, all spent on Binance AI

It would be a lie to say there are no surprises. I played the mini game before, and I had to ask a lot of people to figure out how to install it. But with Binance AI, no extra operations needed at all, it's built right into the APP, just click and play

Can play anytime, anywhere on your

龙虾4.77%

- 報酬

- いいね

- コメント

- リポスト

- 共有

昨日、長く協力していたプロジェクト側からドキュメントの更新が送られてきて、ファイルをダウンロードする必要があったのだが、第一反応としてほとんど「詐欺師?」と口走りそうになった🤣

本当に軽々しくクリックできず、盗まれたアカウントから送られるフィッシングファイルに遭遇するのが怖すぎる

その後、慎重に確認したところ本人であることがわかり、プロジェクト側も非常に迅速に対応してくれて、すぐに別の方法に切り替えてもらった。私も理由を説明した

ついでに皆さんに心から伝えたい:誰から送られてきたファイルであっても、安易にダウンロードや開封をしないこと。必ず何度も身元を確認し、安全第一を心がけてください!

また、プロジェクト側には情報をファイルダウンロード方式で提供しないことを強くお勧めします!

原文表示本当に軽々しくクリックできず、盗まれたアカウントから送られるフィッシングファイルに遭遇するのが怖すぎる

その後、慎重に確認したところ本人であることがわかり、プロジェクト側も非常に迅速に対応してくれて、すぐに別の方法に切り替えてもらった。私も理由を説明した

ついでに皆さんに心から伝えたい:誰から送られてきたファイルであっても、安易にダウンロードや開封をしないこと。必ず何度も身元を確認し、安全第一を心がけてください!

また、プロジェクト側には情報をファイルダウンロード方式で提供しないことを強くお勧めします!

- 報酬

- 1

- コメント

- リポスト

- 共有