L'IA accueille le "moment USB-C", comment le MCP peut-il s'intégrer parfaitement à Ethereum ?

Contenu | Bruce

Édition & Mise en page | Huán Huán

Conception | Daisy

Le “moment USB-C” dans l’histoire de l’évolution de l’IA, en novembre 2024, le protocole MCP publié par Anthropic provoque un tremblement de terre dans la Silicon Valley. Ce standard ouvert, surnommé “USB-C de l’IA”, restructure non seulement la manière dont les grands modèles se connectent au monde physique, mais cache également le code pour déverrouiller le dilemme du monopole de l’IA et reconstruire les relations de production de la civilisation numérique. Alors que nous débattons encore de l’échelle des paramètres de GPT-5, le MCP a déjà pavé discrètement la voie décentralisée vers l’ère de l’AGI…

Bruce : J’étudie récemment le Model Context Protocol (MCP). C’est la deuxième chose qui m’excite énormément dans le domaine de l’IA après ChatGPT, car cela pourrait résoudre trois problèmes auxquels je pense depuis des années :

- Comment les non-scientifiques et les personnes ordinaires peuvent-elles participer à l’industrie de l’IA et en tirer un revenu ?

- Quels sont les points de convergence gagnant-gagnant entre l’IA et Ethereum ?

- Comment réaliser un d/acc AI ? Éviter le monopole et la censure des grandes entreprises centralisées, AGI détruit l’humanité ?

01, qu’est-ce que le MCP ?

MCP est un cadre de normes ouvertes qui simplifie l’intégration des LLM avec des sources de données et des outils externes. Si l’on compare les LLM aux systèmes d’exploitation Windows, et que des applications comme Cursor sont des claviers et du matériel, alors les MCP sont des interfaces USB qui permettent l’insertion flexible de données et d’outils externes, qui peuvent ensuite être lus et utilisés par l’utilisateur.

MCP offre trois capacités pour étendre LLM :

- Ressources(知识扩展)

- Outils (exécuter des fonctions, appeler des systèmes externes)

- Invites (modèles de prompts préécrits)

MCP peut être développé et hébergé par n’importe qui, fourni sous forme de serveur, et peut être mis hors ligne à tout moment pour arrêter le service.

02, pourquoi avons-nous besoin de MCP

Actuellement, les LLM utilisent autant de données que possible pour effectuer un grand nombre de calculs et générer un grand nombre de paramètres, intégrant ainsi des connaissances dans le modèle pour produire des réponses correspondantes. Cependant, plusieurs problèmes importants existent :

- Une grande quantité de données et de calculs nécessite beaucoup de temps et de matériel, les connaissances utilisées pour l’entraînement sont généralement obsolètes.

- Les modèles avec de nombreux paramètres sont difficiles à déployer et à utiliser sur des appareils locaux, mais en réalité, la plupart des utilisateurs peuvent ne pas avoir besoin de toutes les informations pour satisfaire leurs besoins.

- Certains modèles utilisent des robots d’exploration pour lire des informations externes afin d’assurer la temporalité, mais en raison des limites des robots d’exploration et de la qualité des données externes, cela peut produire un contenu encore plus trompeur.

- Puisque l’IA n’apporte pas vraiment d’avantages aux créateurs, de nombreux sites et contenus commencent à mettre en œuvre des mesures anti-AI, générant une grande quantité de spam, ce qui entraînera une dégradation progressive de la qualité des LLM.

- Il est très difficile pour LLM d’étendre ses fonctionnalités et opérations externes dans tous les domaines, par exemple en appelant précisément l’API GitHub pour réaliser certaines opérations. Il générera du code en se basant sur une documentation peut-être obsolète, mais ne peut garantir une exécution précise.

03, l’évolution de l’architecture de LLM gras et LLM maigre + MCP

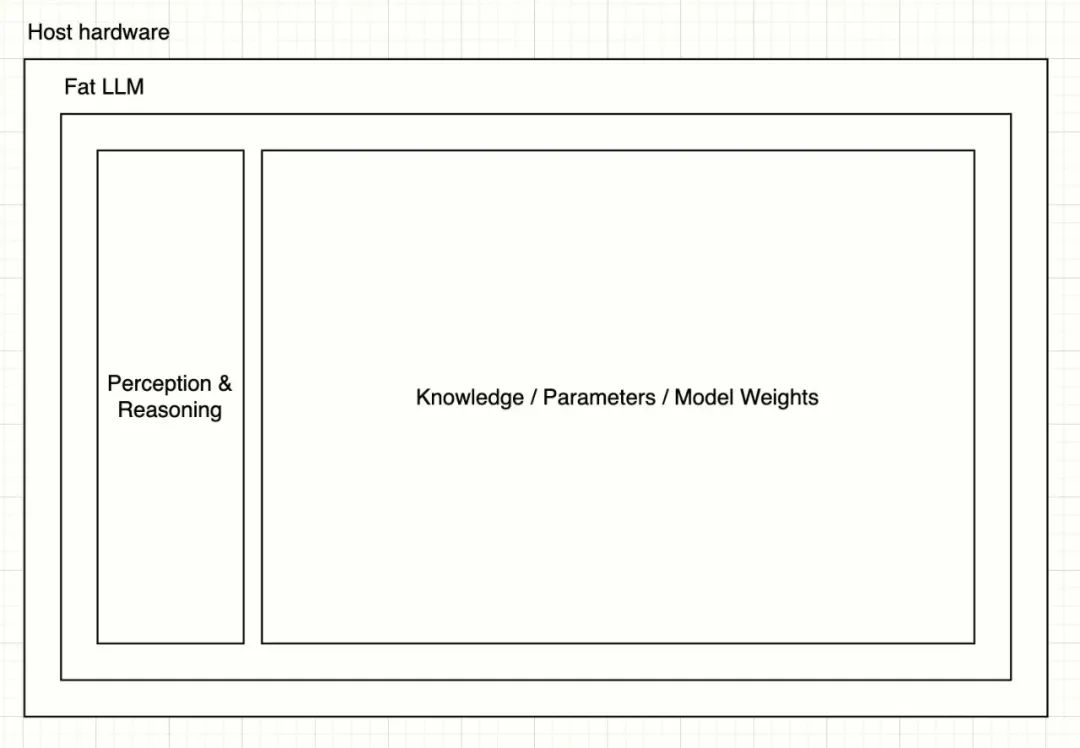

Nous pouvons considérer les modèles à très grande échelle actuels comme de gros LLM, dont l’architecture peut être représentée par l’illustration simple suivante :

Après que l’utilisateur a saisi les informations, celles-ci sont décomposées et raisonnés par la couche Perception & Reasoning, puis un vaste ensemble de paramètres est appelé pour générer des résultats.

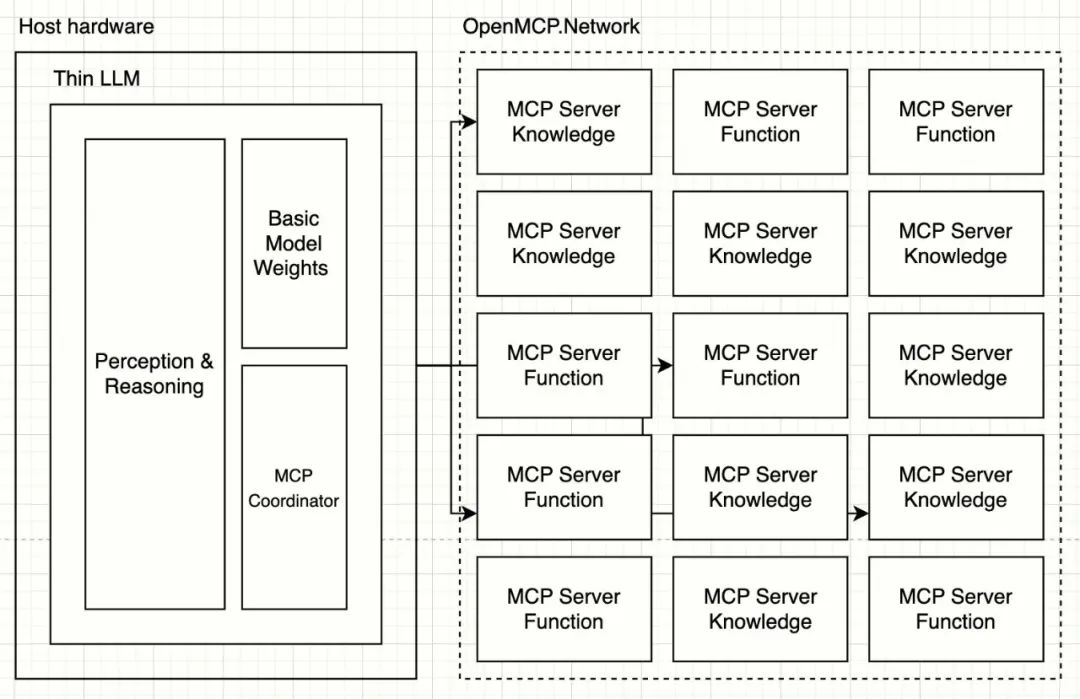

Après le MCP, le LLM pourrait se concentrer sur la parsing linguistique elle-même, se détachant des connaissances et des capacités, devenant un LLM léger :

Sous l’architecture du LLM léger, la couche Perception & Raisonnement se concentrera sur la façon de traduire les informations environnementales humaines dans leur intégralité en tokens, y compris mais sans s’y limiter : la voix, le ton, l’odeur, les images, le texte, la gravité, la température, etc., puis coordonnera et orchestrera jusqu’à des centaines de serveurs MCP via le MCP Coordinator pour accomplir des tâches. Le coût et la vitesse d’entraînement du LLM léger augmenteront rapidement, et les exigences pour les dispositifs de déploiement deviendront très faibles.

04, comment MCP résout les trois grands problèmes

Comment les gens ordinaires peuvent-ils participer à l’industrie de l’IA ?

Toute personne ayant un talent unique peut créer son propre serveur MCP pour fournir des services à LLM. Par exemple, un passionné d’oiseaux peut offrir ses notes sur les oiseaux accumulées au fil des ans via MCP. Lorsque quelqu’un utilise LLM pour rechercher des informations liées aux oiseaux, le service MCP des notes sur les oiseaux sera appelé. Le créateur recevra également une part des revenus.

C’est un cycle économique des créateurs plus précis et automatisé, avec des contenus de service davantage standardisés, permettant un comptage précis des appels et des tokens générés. Les fournisseurs de LLM peuvent même faire appel simultanément à plusieurs serveurs MCP de Bird Notes pour permettre aux utilisateurs de choisir et d’évaluer afin de déterminer qui a une meilleure qualité et obtient un poids de correspondance plus élevé.

Une combinaison gagnant-gagnant entre l’IA et Ethereum

a. Nous pouvons construire un réseau d’incitation pour les créateurs OpenMCP.Network basé sur Ethereum. Le serveur MCP doit être hébergé et fournir des services stables, les utilisateurs paient les fournisseurs de LLM, et les fournisseurs de LLM distribuent les incitations réelles sur les serveurs MCP appelés via le réseau afin de maintenir la durabilité et la stabilité de l’ensemble du réseau, incitant les créateurs de MCP à continuer à créer et à fournir un contenu de haute qualité. Ce réseau nécessitera l’utilisation de contrats intelligents pour réaliser l’automatisation, la transparence, la fiabilité et la résistance à la censure des incitations. Les signatures, la vérification des autorisations et la protection de la vie privée pendant le fonctionnement peuvent être mises en œuvre à l’aide de portefeuilles Ethereum, de ZK et d’autres technologies.

b. Développer des serveurs MCP liés aux opérations sur la chaîne Ethereum, tels que le service d’appel de portefeuille AA, permettant aux utilisateurs d’effectuer des paiements de portefeuille via le langage dans LLM sans exposer les clés privées et les autorisations associées à LLM.

c. Il existe également divers outils pour développeurs qui simplifient davantage le développement de contrats intelligents Ethereum et la génération de code.

Réaliser une décentralisation de l’IA

a. Les serveurs MCP décentralisent les connaissances et les capacités de l’IA, permettant à quiconque de créer et d’héberger des serveurs MCP, puis de s’inscrire sur des plateformes comme OpenMCP.Network pour obtenir des incitations selon les appels. Aucune entreprise ne peut contrôler tous les serveurs MCP. Si un fournisseur de LLM offre des incitations injustes aux serveurs MCP, les créateurs soutiendront le blocage de cette entreprise, et les utilisateurs, ne recevant pas de résultats de qualité, changeront pour d’autres fournisseurs de LLM afin d’assurer une concurrence plus équitable.

b. Les créateurs peuvent mettre en œuvre un contrôle d’accès granulaire sur leurs serveurs MCP pour protéger la vie privée et les droits d’auteur. Les fournisseurs de LLM maigres devraient inciter raisonnablement les créateurs à contribuer des serveurs MCP de haute qualité.

c. L’écart de capacité des LLM maigres va progressivement s’estomper, car le langage humain a une limite de couverture et son évolution est très lente. Les fournisseurs de LLM devront porter leur attention et leurs fonds sur des serveurs MCP de haute qualité, plutôt que de réutiliser davantage de cartes graphiques pour miner.

d. La capacité de l’AGI sera décentralisée et dévaluée, le LLM agissant uniquement comme un traitement du langage et une interaction avec l’utilisateur, les capacités spécifiques étant réparties dans divers serveurs MCP. L’AGI ne menacera pas l’humanité, car après la fermeture des serveurs MCP, seules des conversations de base en langage pourront avoir lieu.

05, Revue générale

- L’évolution de l’architecture des serveurs LLM + MCP consiste essentiellement à décentraliser les capacités de l’IA, réduisant ainsi le risque que l’AGI détruise l’humanité.

- L’utilisation des LLM permet de comptabiliser et d’automatiser les appels aux serveurs MCP au niveau des tokens, établissant ainsi une base pour la construction du système économique des créateurs d’IA.

- Un bon système économique peut inciter les créateurs à contribuer activement à la création de serveurs MCP de haute qualité, ce qui stimule le développement de l’humanité dans son ensemble et réalise un cycle vertueux. Les créateurs ne résisteront plus à l’IA, et l’IA offrira également plus d’emplois et de revenus, répartissant équitablement les bénéfices des entreprises commerciales monopolistiques comme OpenAI.

- Ce système économique, combinant ses caractéristiques et les besoins de son créateur, est particulièrement adapté à une mise en œuvre basée sur Ethereum.

06, Perspectives d’avenir : Évolution du scénario suivant

- Les protocoles MCP ou similaires vont apparaître en masse, et plusieurs grandes entreprises commenceront à rivaliser pour définir les standards.

- Des LLM basés sur MCP émergeront, se concentrant sur l’analyse et le traitement du langage humain avec de petits modèles, accompagnés d’un coordinateur MCP pour se connecter au réseau MCP. Les LLM prendront en charge la découverte automatique et la planification des serveurs MCP, sans configuration manuelle complexe.

- Les fournisseurs de services du réseau MCP apparaîtront, chacun avec son propre système d’incitation économique. Les créateurs de MCP pourront enregistrer et héberger leur serveur pour générer des revenus.

- Si le système d’incitation économique du réseau MCP est construit sur Ethereum, basé sur des contrats intelligents, alors le nombre de transactions sur le réseau Ethereum augmentera d’environ 150 fois (en prenant comme base un volume très conservateur d’un million d’appels de serveurs MCP par jour, avec actuellement un bloc de 12 secondes incluant 100 txs).