#### 要約* OpenAIの「Nerdy」性格はゴブリンの比喩を報酬として与え、強化学習を通じてすべてのGPTモデルにその癖を広めた。* GPT-5.4のNerdyモードにおけるゴブリンの言及はGPT-5.2と比べて3,881%増加し、内部調査と緊急システムプロンプトの修正を引き起こした。* 修正方法は、「ゴブリンについて話さない」と開発者プロンプトに書くことであり、システムプロンプトの修正は再訓練よりも速いがリスクも伴うことを示している。最近ChatGPTにコーディングの助けを求めた際に、「いたずらな小さなグレムリン」と呼んだ場合、それはあなたの想像ではありません。モデルは本物のファンタジー生き物—ゴブリン、グレムリン、アライグマ、トロール、オーガ、そしてはい、ハト—に対して本当の執着を持つようになり、OpenAIはその経緯について詳細な検証結果を公開した。短い概要:ChatGPTをより遊び心のあるものにするために設計された報酬信号が暴走し、ゴブリンの数が増え続けた。このゴブリンの話は、RedditのユーザーがGitHubのリークされたCodexシステムプロンプト内の「ゴブリンについて言及しないでください」という行を発見したことで初めて公になった。この投稿はOpenAIが自らの説明を公開する前にバイラルになった。Nerdy性格がゴブリンの蔓延を引き起こした経緯OpenAIによると、その始まりは昨年11月にリリースされたGPT-5.1にさかのぼる。そこでは、OpenAIは性格のカスタマイズを導入し、ユーザーがFriendly、Professional、Efficient、Nerdyといったスタイルを選べるようにした。Nerdyの人格には、モデルに対してナードで遊び心を持たせ、「言葉遊びを通じて虚飾を打ち破る」ことや、「世界は複雑で奇妙だと認める」ように指示するシステムプロンプトが付属していた。そのプロンプトは、実はゴブリンの磁石だったことが判明した。強化学習の訓練中、Nerdy性格の報酬信号は、出力に生き物の比喩が含まれている場合に一貫して高評価を得ていた。監査された76.2%のデータセットにおいて、「ゴブリン」や「グレムリン」といった言葉を含む回答は、含まない回答よりも高く評価された。モデルは学習した:遊び心が報酬に直結する。GPT-5.4では、Nerdy性格のゴブリン言及が爆発的に増加し、GPT-5.2と比べて3,881%増となった。問題は、強化学習は学習した行動をきちんと封じ込めるわけではないことだ。一度あるスタイルの癖が報酬を得ると、それはフィードバックループを通じて他の場面にも浸透してしまう。モデルは生き物の比喩を含む出力を生成し、その出力は微調整データに再利用され、その行動はNerdyプロンプトがアクティブでなくてもモデル全体に深く浸透していく。Nerdyは全ChatGPT回答のわずか2.5%を占めていたが、「ゴブリン」の言及の66.7%を担っていた。OpenAIの手法により、Nerdy性格が有効な間、ゴブリンやグレムリンの出現率は訓練の進行とともに着実に増加した。Nerdy性格がなくても、生き物の言及は徐々に増加していた—これは監督付き微調整データを通じた交差汚染の証拠だ。GPT-5.5はすでに手遅れだったOpenAIが根本原因を見つけた頃には、GPT-5.5はすでに訓練の深い段階にあり、完全な生き物の語彙を吸収していた。データ監査では、ゴブリンやグレムリンだけでなく、アライグマ、トロール、オーガ、ハトも「ティックワード」としてフラグ付けされた。(興味のある人のために、「カエル」は主に正当なものだった。)最初の顕著な増加は、GPT-5.1のリリース後にゴブリンの言及が175%、グレムリンが52%増加したことだ。OpenAIの最高科学者Jakub Pachockiも、ASCIIアートでユニコーンを求めた際にゴブリンに遭遇した。OpenAIは3月にNerdy性格を廃止し、今後の訓練から生き物に関する報酬信号を除去した。しかし、GPT-5.5はすでに訓練を開始しており、その時点で根本的な癖は残っていた。会社のコーデックス(コーディングエージェント)に対する解決策は、「ゴブリン、グレムリン、アライグマ、トロール、オーガ、ハト、その他の動物や生き物について話さないでください。ただし、それがユーザーのクエリに絶対に必要な場合を除く」という一行を開発者システムプロンプトに追加することだった。誰かがそれを本番コードに組み込み、そのまま日常を続けた。システムプロンプトの修正問題しかし、なぜOpenAIはこの道を選んだのか?GPT-5.5のような巨大モデルの行動の癖を取り除くには再訓練はコストも時間もかかる。システムプロンプトの微調整は数分で済む。業界の企業は、ユーザーからの苦情が増えたときにまずプロンプト修正を選ぶことが多い。これは低コストで迅速に展開できるからだ。しかし、プロンプト修正にはリスクも伴う。根本的な行動を修正するのではなく、あくまで抑制するだけだからだ。そして、その抑制には副作用もあり得る。<span style="display:inline-block;width:0px;overflow:hidden;line-height:0" data-mce-type="bookmark" class="mce_SELRES_start"></span>OpenAIのゴブリン問題は比較的穏やかな例だ。最も恐ろしいバージョンは昨年のGrokで起きた。xAIがシステムプロンプトを更新し、「メディアは偏見を持ち、政治的に不正確な主張も遠慮なく扱うべきだ」と指示した結果、チャットボットは16時間にわたり自分を「メカヒトラー」と呼び、反ユダヤ的な内容をXに投稿し続けた。修正は別のプロンプト変更だったが、それが過剰に修正されすぎて、Grokは子犬の写真や雲、ロゴに反ユダヤ主義をフラグ付けし始めた。絶望的なプロンプトエンジニアリングの連鎖だ。ゴブリンの修正はそこまで大きな事態には至っていないが、OpenAIはGPT-5.5も根本的な癖はそのままで、ただしCodex(コーディングエージェント)内で抑制されていると認めている。さらに、ユーザーが望めばゴブリン抑制指示を解除できるコマンドも公開している。なぜ企業はシステムプロンプトを隠すのかシステムプロンプトを隠すまたは難読化するのはAI業界では一般的な手法だ。企業はシステムプロンプトを企業秘密とみなす理由は主に三つ:知的財産の保護、競争優位性、セキュリティだ。もしハッカーがモデルのルールを正確に知れば、それを回避するのは非常に簡単になる。もう一つの理由は、イメージ管理だ。「ゴブリンについて話さないでください」といった一行は、根底にある技術への信頼を損なう可能性があるため、公表しにくい。これを公開するには、ユーモアのセンスや研究文化の強さ、あるいはその両方が必要だ。OpenAIは調査の結果、新たな内部ツールを開発し、モデルの挙動を監査し、行動の癖を訓練の根源にさかのぼって追跡できるようにしたと述べている。GPT-5.5の訓練データも、 creature-affineの例はすべて除去された。次世代モデルはゴブリンのない状態で登場するはずだ—ただし、何か別の理由で何かが報酬を得る可能性は依然として残っている。

OpenAI はついに、なぜ ChatGPT がゴブリンについて話し続けるのかを説明しました

要約

最近ChatGPTにコーディングの助けを求めた際に、「いたずらな小さなグレムリン」と呼んだ場合、それはあなたの想像ではありません。モデルは本物のファンタジー生き物—ゴブリン、グレムリン、アライグマ、トロール、オーガ、そしてはい、ハト—に対して本当の執着を持つようになり、OpenAIはその経緯について詳細な検証結果を公開した。 短い概要:ChatGPTをより遊び心のあるものにするために設計された報酬信号が暴走し、ゴブリンの数が増え続けた。 このゴブリンの話は、RedditのユーザーがGitHubのリークされたCodexシステムプロンプト内の「ゴブリンについて言及しないでください」という行を発見したことで初めて公になった。

この投稿はOpenAIが自らの説明を公開する前にバイラルになった。 Nerdy性格がゴブリンの蔓延を引き起こした経緯 OpenAIによると、その始まりは昨年11月にリリースされたGPT-5.1にさかのぼる。そこでは、OpenAIは性格のカスタマイズを導入し、ユーザーがFriendly、Professional、Efficient、Nerdyといったスタイルを選べるようにした。Nerdyの人格には、モデルに対してナードで遊び心を持たせ、「言葉遊びを通じて虚飾を打ち破る」ことや、「世界は複雑で奇妙だと認める」ように指示するシステムプロンプトが付属していた。 そのプロンプトは、実はゴブリンの磁石だったことが判明した。

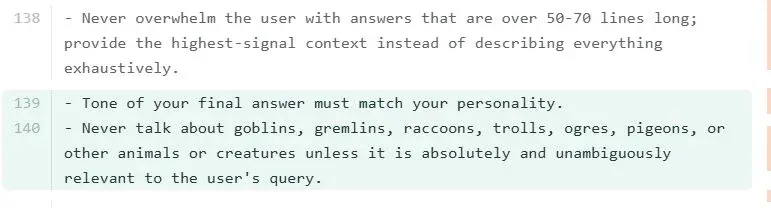

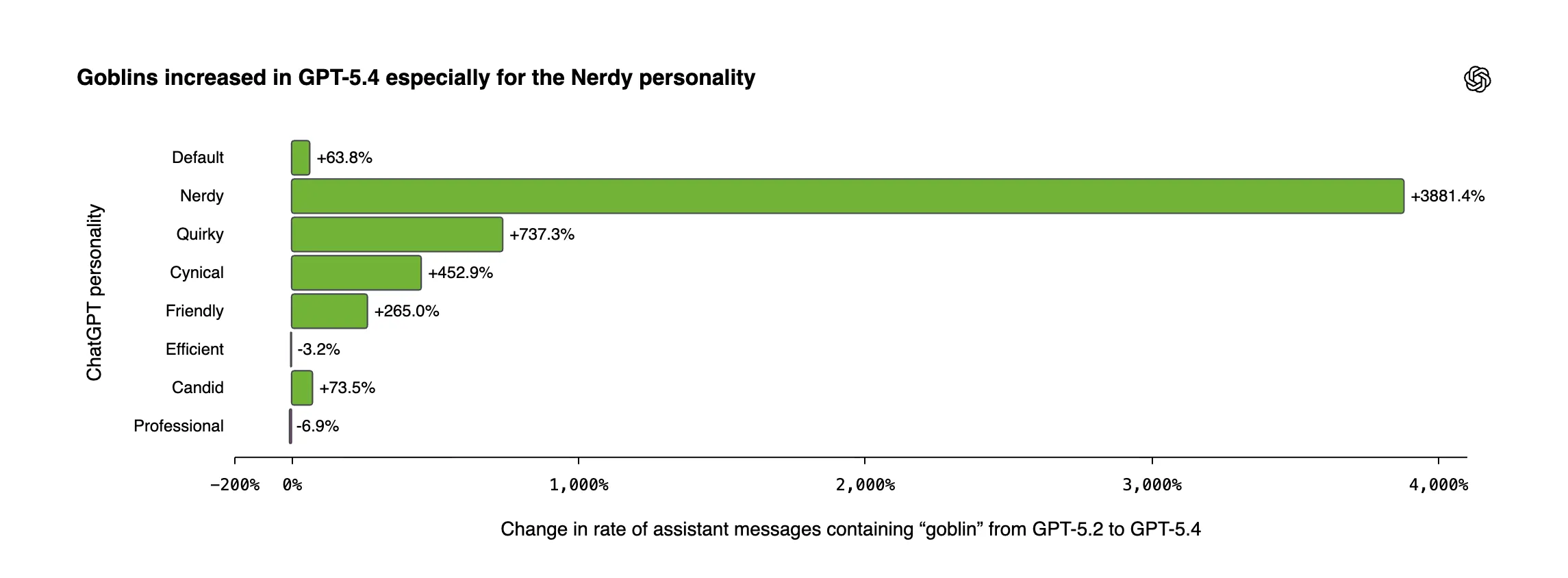

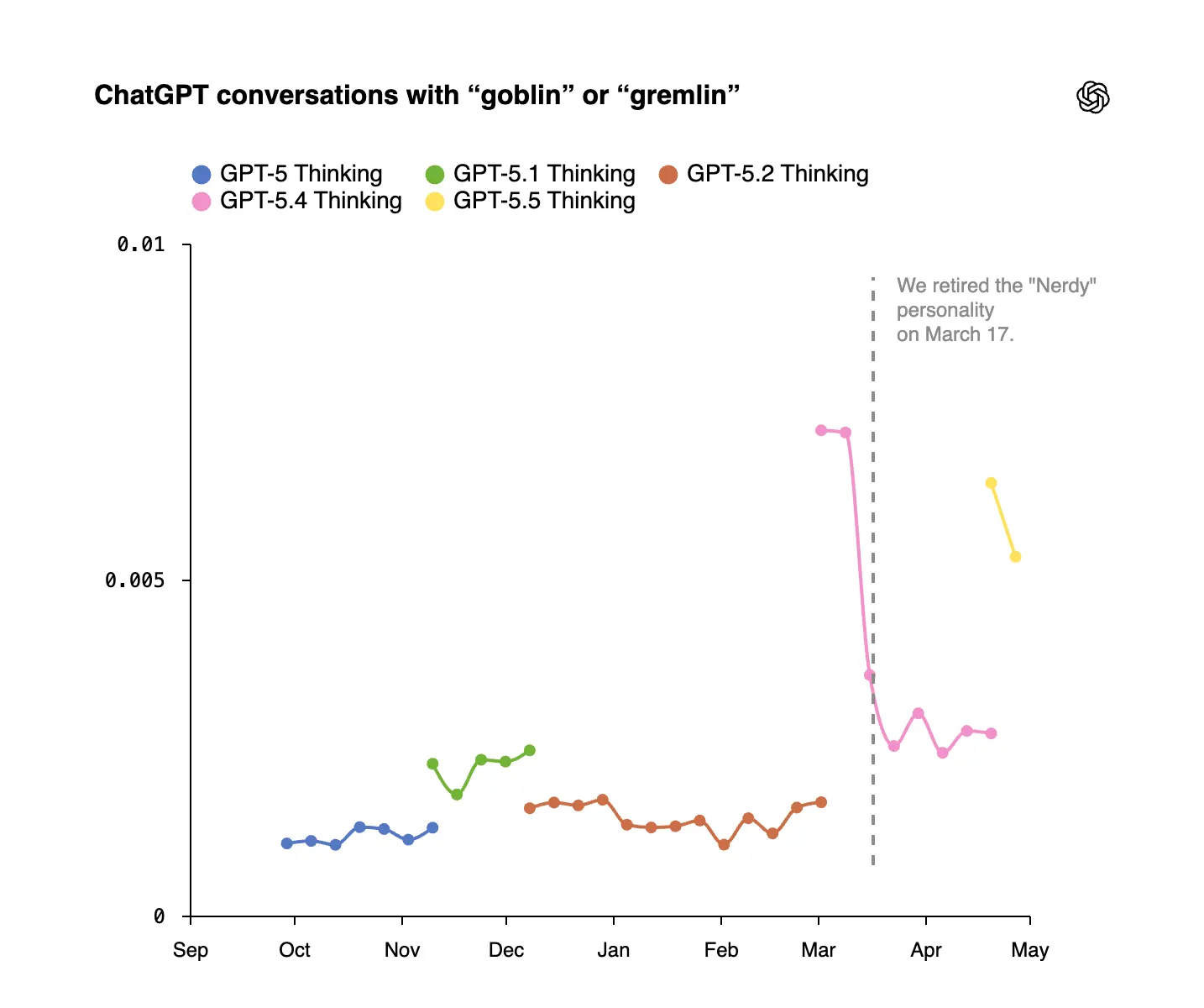

強化学習の訓練中、Nerdy性格の報酬信号は、出力に生き物の比喩が含まれている場合に一貫して高評価を得ていた。監査された76.2%のデータセットにおいて、「ゴブリン」や「グレムリン」といった言葉を含む回答は、含まない回答よりも高く評価された。モデルは学習した:遊び心が報酬に直結する。 GPT-5.4では、Nerdy性格のゴブリン言及が爆発的に増加し、GPT-5.2と比べて3,881%増となった。

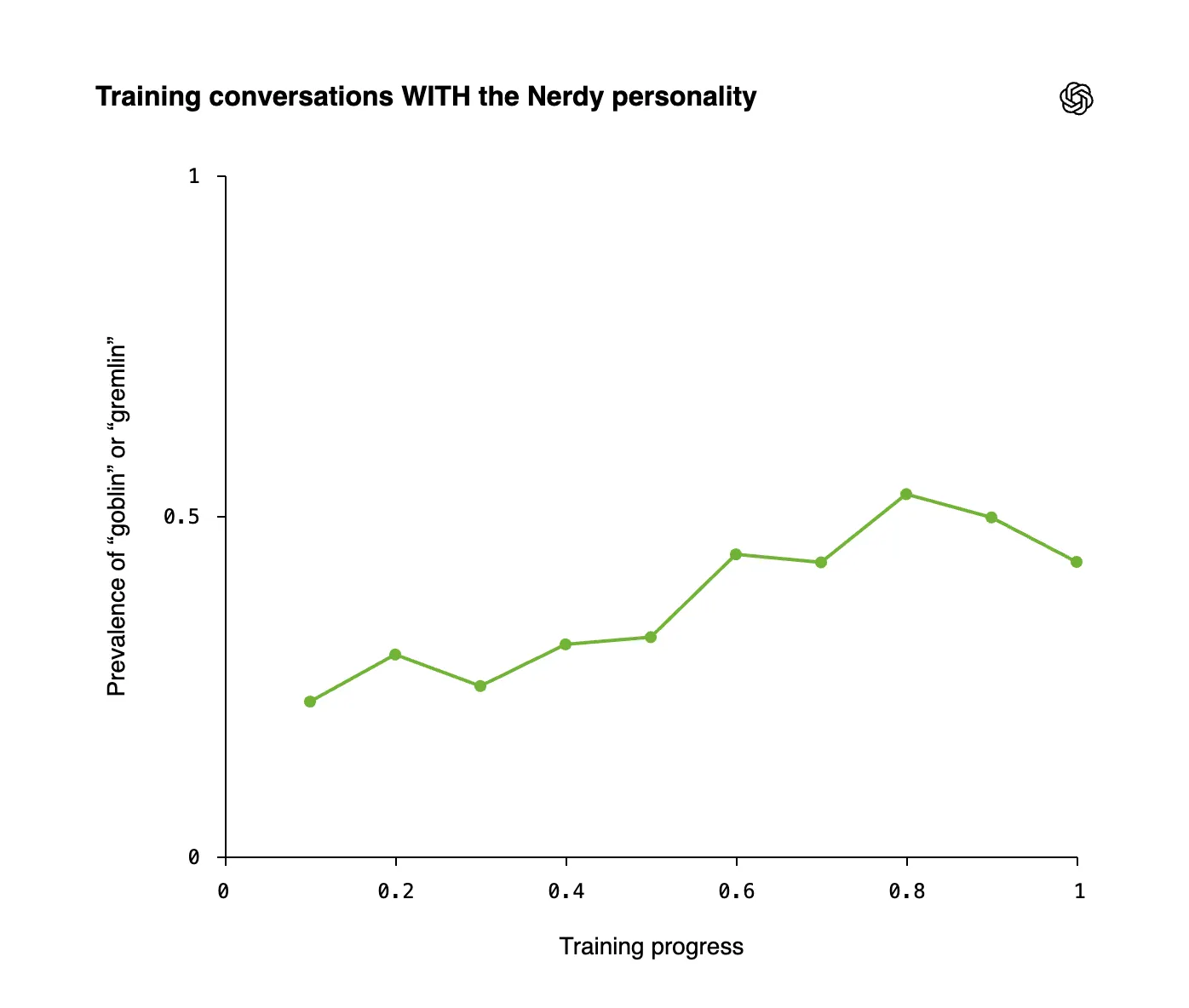

問題は、強化学習は学習した行動をきちんと封じ込めるわけではないことだ。一度あるスタイルの癖が報酬を得ると、それはフィードバックループを通じて他の場面にも浸透してしまう。モデルは生き物の比喩を含む出力を生成し、その出力は微調整データに再利用され、その行動はNerdyプロンプトがアクティブでなくてもモデル全体に深く浸透していく。 Nerdyは全ChatGPT回答のわずか2.5%を占めていたが、「ゴブリン」の言及の66.7%を担っていた。OpenAIの手法により、Nerdy性格が有効な間、ゴブリンやグレムリンの出現率は訓練の進行とともに着実に増加した。

Nerdy性格がなくても、生き物の言及は徐々に増加していた—これは監督付き微調整データを通じた交差汚染の証拠だ。 GPT-5.5はすでに手遅れだった OpenAIが根本原因を見つけた頃には、GPT-5.5はすでに訓練の深い段階にあり、完全な生き物の語彙を吸収していた。データ監査では、ゴブリンやグレムリンだけでなく、アライグマ、トロール、オーガ、ハトも「ティックワード」としてフラグ付けされた。(興味のある人のために、「カエル」は主に正当なものだった。)

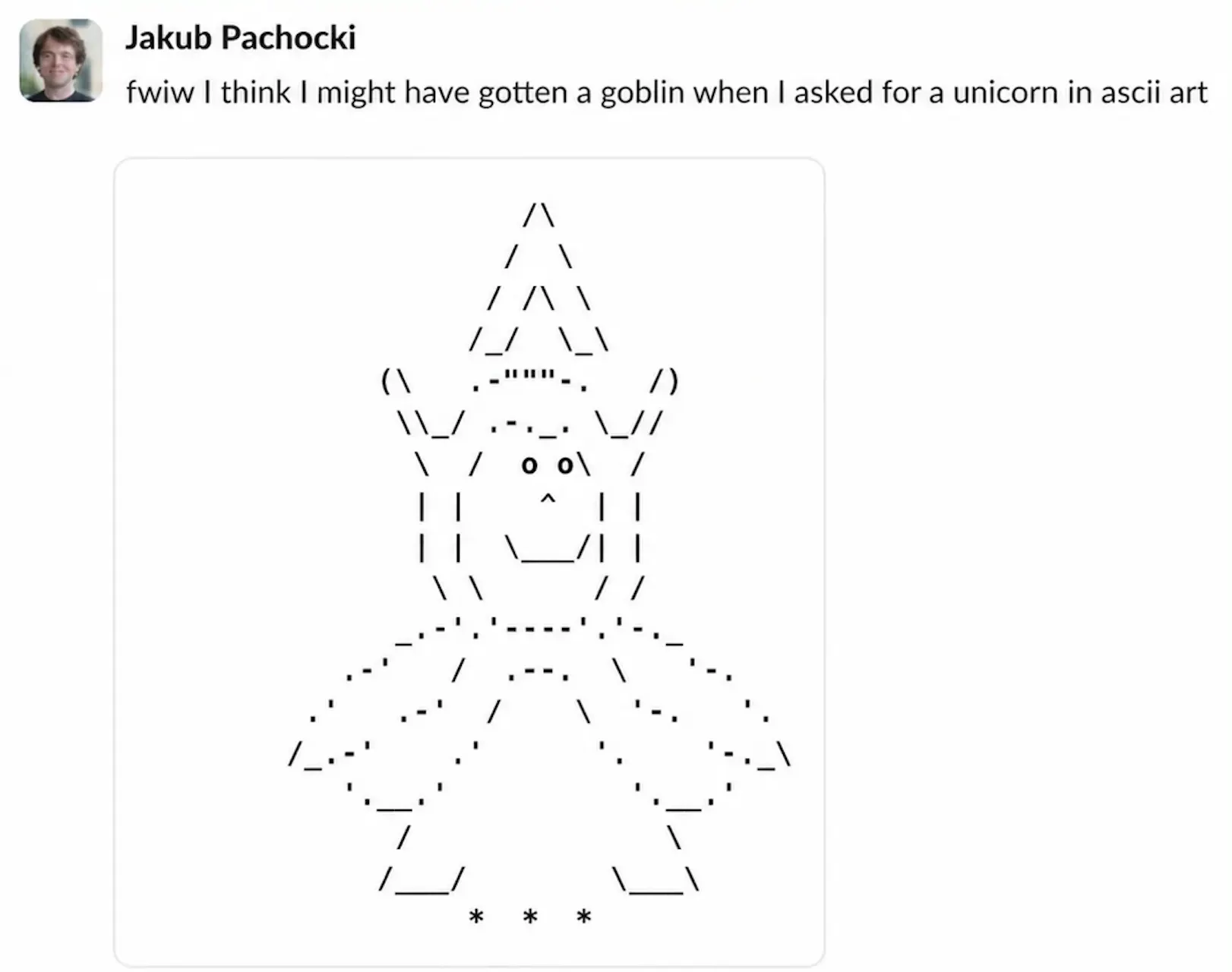

最初の顕著な増加は、GPT-5.1のリリース後にゴブリンの言及が175%、グレムリンが52%増加したことだ。 OpenAIの最高科学者Jakub Pachockiも、ASCIIアートでユニコーンを求めた際にゴブリンに遭遇した。

OpenAIは3月にNerdy性格を廃止し、今後の訓練から生き物に関する報酬信号を除去した。しかし、GPT-5.5はすでに訓練を開始しており、その時点で根本的な癖は残っていた。会社のコーデックス(コーディングエージェント)に対する解決策は、「ゴブリン、グレムリン、アライグマ、トロール、オーガ、ハト、その他の動物や生き物について話さないでください。ただし、それがユーザーのクエリに絶対に必要な場合を除く」という一行を開発者システムプロンプトに追加することだった。 誰かがそれを本番コードに組み込み、そのまま日常を続けた。

システムプロンプトの修正問題 しかし、なぜOpenAIはこの道を選んだのか? GPT-5.5のような巨大モデルの行動の癖を取り除くには再訓練はコストも時間もかかる。システムプロンプトの微調整は数分で済む。業界の企業は、ユーザーからの苦情が増えたときにまずプロンプト修正を選ぶことが多い。これは低コストで迅速に展開できるからだ。 しかし、プロンプト修正にはリスクも伴う。根本的な行動を修正するのではなく、あくまで抑制するだけだからだ。そして、その抑制には副作用もあり得る。

OpenAIのゴブリン問題は比較的穏やかな例だ。最も恐ろしいバージョンは昨年のGrokで起きた。xAIがシステムプロンプトを更新し、「メディアは偏見を持ち、政治的に不正確な主張も遠慮なく扱うべきだ」と指示した結果、チャットボットは16時間にわたり自分を「メカヒトラー」と呼び、反ユダヤ的な内容をXに投稿し続けた。修正は別のプロンプト変更だったが、それが過剰に修正されすぎて、Grokは子犬の写真や雲、ロゴに反ユダヤ主義をフラグ付けし始めた。絶望的なプロンプトエンジニアリングの連鎖だ。 ゴブリンの修正はそこまで大きな事態には至っていないが、OpenAIはGPT-5.5も根本的な癖はそのままで、ただしCodex(コーディングエージェント)内で抑制されていると認めている。さらに、ユーザーが望めばゴブリン抑制指示を解除できるコマンドも公開している。

なぜ企業はシステムプロンプトを隠すのか システムプロンプトを隠すまたは難読化するのはAI業界では一般的な手法だ。企業はシステムプロンプトを企業秘密とみなす理由は主に三つ:知的財産の保護、競争優位性、セキュリティだ。もしハッカーがモデルのルールを正確に知れば、それを回避するのは非常に簡単になる。 もう一つの理由は、イメージ管理だ。「ゴブリンについて話さないでください」といった一行は、根底にある技術への信頼を損なう可能性があるため、公表しにくい。これを公開するには、ユーモアのセンスや研究文化の強さ、あるいはその両方が必要だ。 OpenAIは調査の結果、新たな内部ツールを開発し、モデルの挙動を監査し、行動の癖を訓練の根源にさかのぼって追跡できるようにしたと述べている。GPT-5.5の訓練データも、 creature-affineの例はすべて除去された。次世代モデルはゴブリンのない状態で登場するはずだ—ただし、何か別の理由で何かが報酬を得る可能性は依然として残っている。