GoogleはGemma 4でオープンソースAIレースに再び参入する

概要

- Googleは、Apache 2.0ライセンスのもとで提供されるオープンモデルのファミリー「Gemma 4」をリリースしました。

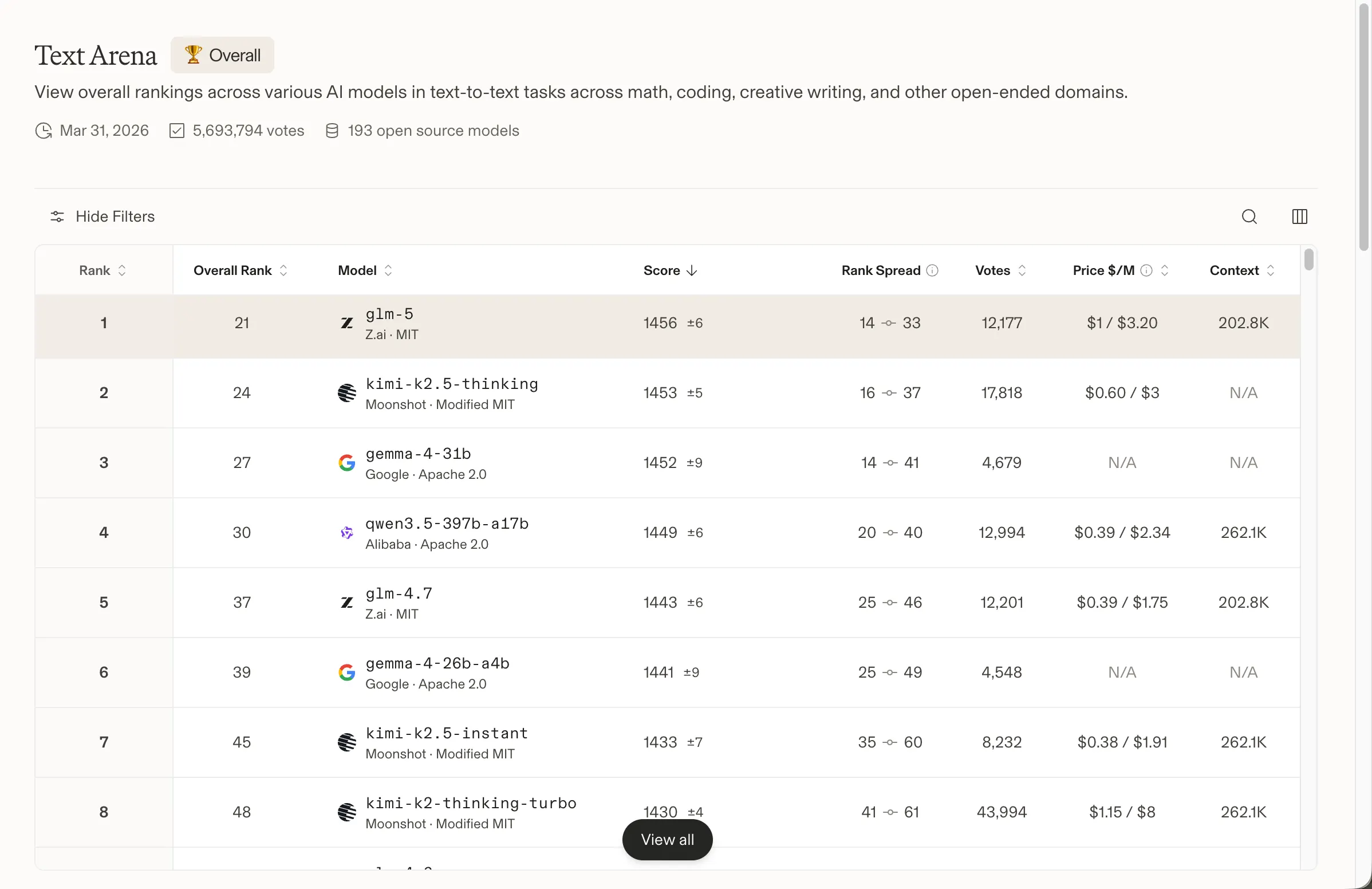

- 4モデルのラインナップは、携帯電話からデータセンターまで幅広くカバーしており、31Bモデルはすでに世界で#3にランクインしています。

- 米国のオープンソースAIに必要な後押しが入ります。DeepMindが支えるGemma 4は、DeepSeek、Qwen、その他の中国勢に対する最強のアメリカ勢としての地位を狙います。

GoogleのオープンAIへの野心は、今日かなり本気度を増しました。同社は、Gemini 3と同じ研究をベースに作られ、Apache 2.0のもとでライセンスされた4つのオープンウェイトモデル・ファミリー「Gemma 4」をリリースしました。これは、これまでのGemmaバージョンにおけるより制限の強い条件からの大きな転換です。 これまでのGemma世代はこれまでに4億回以上ダウンロードされており、10万を超えるコミュニティ派生が生まれています。このリリースは、これまでで最も野心的なものです。

ついにGemma 4をリリースしました――これまでで最も知的なオープンモデルです。

Gemini 3と同じ一流の研究から作られたGemma 4は、ブレークスルーの知能を、あなた自身のハードウェアに直接届けます。高度な推論やエージェント的なワークフローのために。

商用ライセンスのもとで… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

過去1年間、オープンソースAIのリーダーボードは、ほぼ中国勢の独壇場でした。DeepSeek、Minimax、GLM、Qwenが上位の座を席巻し、米国の代替は存在感を取り戻すのに必死でした。Decryptが昨年報じたところによると、中国のオープンモデルは、2024年末の世界的なオープンモデル利用のわずか1.2%程度から、2025年末にはおよそ30%へと伸びました。さらにAlibabaのQwenは、世界で最も使われているセルフホスト型モデルとして、MetaのLlamaを追い抜いたほどです。 MetaのLlamaは、ローカルで動かせる有能なモデルを求める開発者にとって、かつてはデフォルトの選択肢でした。その評判は薄れてきています。LlamaのMetaが管理するライセンスが、その「真にオープンソースであること」について疑問を生み、そして性能も中国勢の競争に後れを取ったからです。Allen InstituteのOLMoファミリーはその穴を埋めようとしましたが、意味のある支持を得ることはできませんでした。OpenAIは2025年8月にgpt-ossモデルをリリースし、エコシステムに新鮮な息吹をもたらしましたが、それらはフロンティア競争のために設計されたわけではありませんでした。 そして昨日、米国の30人規模のスタートアップ「Arcee AI」がTrinityをリリースしました。Trinityは、4,000億パラメータのオープンモデルで、このアメリカの現場が完全に死んでいるわけではないことを説得力をもって示しました。Gemma 4はその勢いを引き継ぎます。今回はGoogle DeepMindの全面的な後ろ盾が付いており、オープンソースAIの分野でおそらく最良のアメリカ製モデルになっていると言ってもよい状態です。 同社は発表の中で、このモデルは「Gemini 3と同じ一流の研究と技術から作られている」と述べています。Gemma 4は4つのサイズで提供されます。携帯電話やエッジデバイス向けのEffective 2Bおよび4B、速度に焦点を当てた26B Mixture of Expertsモデル、そして生の品質向けに最適化された31B Denseモデルです。

31B Denseは、現在Arena AIのテキストリーダーボード上で、すべてのオープンモデルの中で3位に位置しています。26B MoEは6位です。Googleは、両方とも自分たちのサイズの20倍のモデルを上回ると主張しています。この主張は、少なくともArena AIの数値に対しては成り立っています。そこでは中国のモデルが依然として上位2枠を占めています。

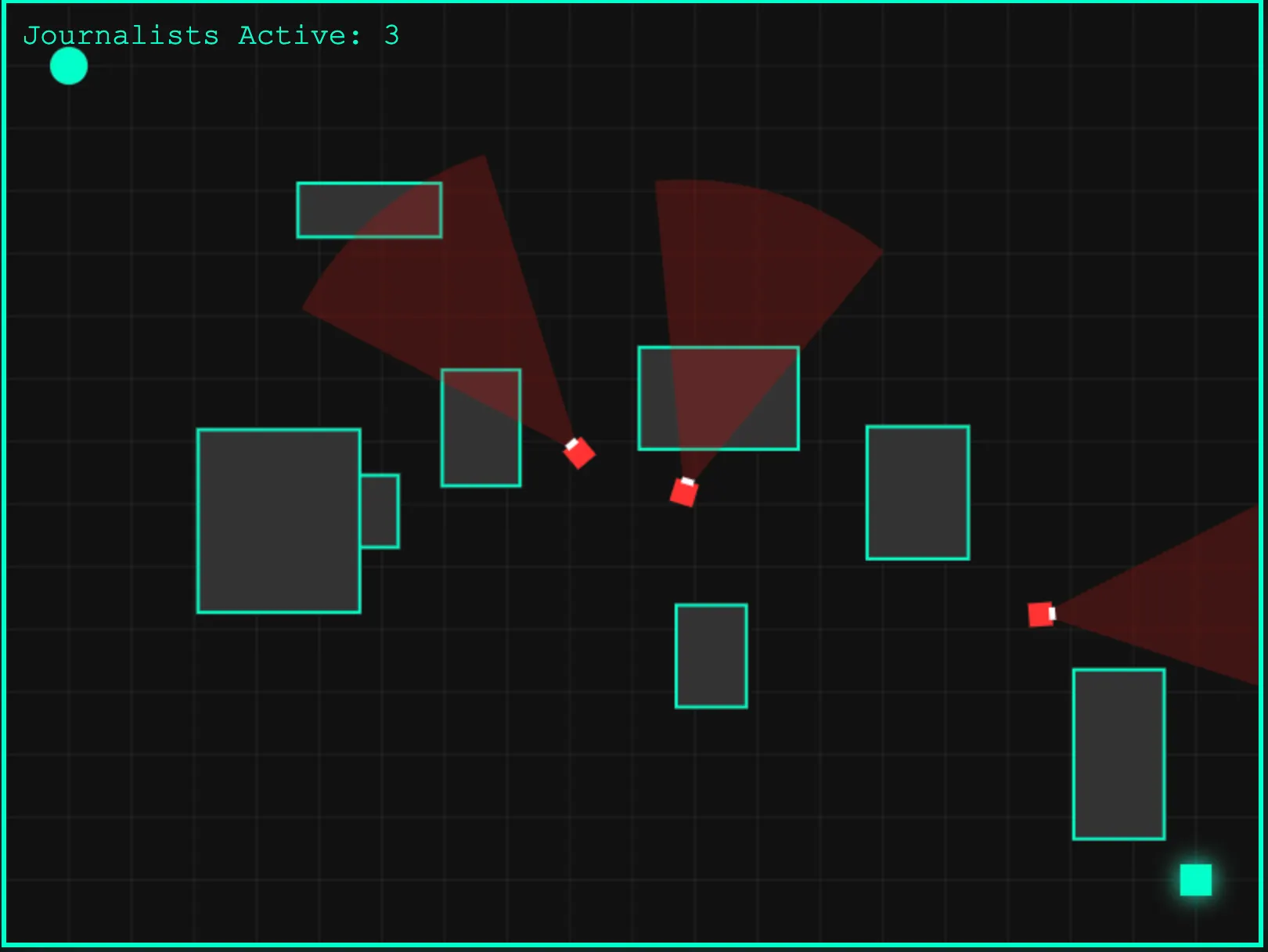

私たちはGemma 4をテストしました。能力はありますが、いくつかの注意点があります。このモデルは必要のないタスクにも推論を適用するため、単純なプロンプトへの回答が過剰に設計されているように感じられることがあります。創作文はまあまあで――使えるが、ひらめきを感じさせるほどではありません。そして、より具体的な指示やプロンプトエンジニアリングによって改善される可能性があります。 最もはっきりと成果が出たのはコードでした。ゲームの生成を依頼したところ、出力は特に派手でも凝ったものでもありませんでしたが、最初の試行でエラーなしに動きました。41B(410億)パラメータのモデルとしては悪くありません。このゼロショットの信頼性は、デバッグが必要になる「より見栄えのする結果」よりも、むしろ価値が高いと言えるかもしれません。 こちらで(基本的だが実用的な)ゲームを試せます。

4つのバリアントは、ハードウェア全体の幅をカバーしています。E2BとE4Bモデルは、Androidのスマートフォン、Raspberry Pi、そしてエッジデバイス向けに作られています。完全にオフラインで動作し、レイテンシはほぼゼロ、ネイティブな音声入力、128Kのコンテキストウィンドウを備えています。26Bと31Bモデルは、ワークステーションとクラウド展開を対象とし、コンテキストを256Kまで拡張し、自律エージェントを構築するためのネイティブな関数呼び出しと、構造化されたJSON出力を追加しています。4つのモデルすべてが、画像と動画をネイティブに処理します。より大きいモデルのフル精度の重みは、1台の80GB NVIDIA H100 GPUに収まります。量子化版は一般向けのハードウェアで動作します。 もう一つの大きな見出しは、Apache 2.0ライセンスです。GoogleのこれまでのGemmaリリースは、商用製品で法的な曖昧さを生む独自ライセンスを使っていました。Apache 2.0は、その摩擦を完全に取り除きます――開発者は、後でGoogleが条件を変えることを心配せずに、改変、再配布、商用化できます。Hugging Faceの共同創業者であるClement Delangueはこれを称賛し、「ローカルAIが今まさにその時を迎えている。これがAI業界の未来だ」と述べました。Google DeepMindのCEOであるDemis Hassabisはさらに踏み込み、Gemma 4を「それぞれのサイズにおいて世界最高のオープンモデル」だと呼びました。

Gemma 4をローンチできることにワクワクしています:それぞれのサイズにおいて世界最高のオープンモデルです。4サイズで提供され、あなたの特定のタスクに合わせてファインチューニング可能です。生のパフォーマンスが素晴らしい31B dense、低レイテンシの26B MoE、そしてエッジデバイス利用のためのeffective 2B & 4B――さあ作りましょう! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) April 2, 2026

これは強い主張です。Anthropic、OpenAI、そしてGoogle自身のGeminiによるプロプライエタリなシステムは、最も難しいベンチマークでは依然として先頭に立っています。しかし、ローカルで動かせて、自由に改変でき、自分のインフラにデプロイできるオープンウェイトモデルなら? 競争はかなり薄くなったばかりです。今すぐGemma 4は、Google AI Studio(31Bおよび26B)またはGoogle AI Edge Gallery(E2BおよびE4B)で試せます。モデルの重みもHugging Face、Kaggle、Ollamaで利用可能です。