Perle face aux plateformes traditionnelles de labellisation de données : comment le Web3 redéfinit-il le marché des données IA ?

La qualité des ensembles de données d’entraînement détermine la performance maximale des modèles d’IA. Avec l’évolution vers des modèles de grande taille axés sur la précision, l’annotation de données — processus clé d’intégration du savoir humain dans l’IA — passe d’une logique de volume à une approche centrée sur la qualité. Ce changement révèle des faiblesses structurelles dans les systèmes d’annotation traditionnels.

Dans ce contexte, Perle déploie un framework Web3, migré on-chain, pour l’annotation des données. Grâce à un réseau d’experts, un système de réputation on-chain et un mécanisme d’incitation via le token PRL, Perle vise à bâtir une infrastructure de production de données vérifiable et auditable. Dans la chaîne de valeur des données IA, Perle joue le rôle de « couche de vérification humaine », reliant l’offre de données de qualité aux besoins de l’entraînement des modèles.

Qu’est-ce qu’une plateforme traditionnelle d’annotation de données ?

Les plateformes traditionnelles d’annotation de données reposent sur un crowdsourcing centralisé. Elles relient des clients entreprises à un vaste réseau mondial d’annotateurs via une infrastructure Web2, offrant des services d’annotation multimodale (images, vidéos, textes, audio). Le processus type : l’entreprise soumet ses besoins, la plateforme distribue les tâches, les annotateurs les réalisent, puis la plateforme effectue les contrôles qualité avant livraison.

L’avantage principal réside dans l’échelle et la rapidité. Les grandes plateformes disposent de réseaux d’annotateurs étendus, capables de traiter d’énormes volumes de données rapidement. Les outils automatisés et les intégrations API renforcent encore l’efficacité. Cependant, des limites persistent : la plupart des annotateurs demeurent anonymes, les incitations sont de court terme, la traçabilité dépend des registres internes de la plateforme, et les entreprises ont peu de moyens pour vérifier indépendamment la source ou la qualité des données.

Modèle de production de données Perle (approche Web3)

Perle adopte un modèle « Expert-in-the-Loop » coordonné on-chain. Grâce à un réseau mondial d’experts, il cible des tâches complexes et de haute précision. Contrairement au crowdsourcing classique, les participants regroupent annotateurs généralistes et professionnels spécialisés.

Dans ce schéma, les entreprises publient les tâches on-chain, les experts les annotent et relisent. Un système de réputation on-chain évalue la qualité, et les récompenses en tokens PRL sont allouées instantanément. Chaque contribution est traçable, assurant un processus de production de données complet et fermé.

L’innovation majeure réside dans l’intégration de la réputation et des incitations : les contributeurs acquièrent une réputation on-chain en livrant des données de qualité, accèdent à des tâches mieux rémunérées et obtiennent des retours supérieurs. Cette dynamique élève la qualité des données et renforce l’engagement des participants sur le long terme.

Source : Perle

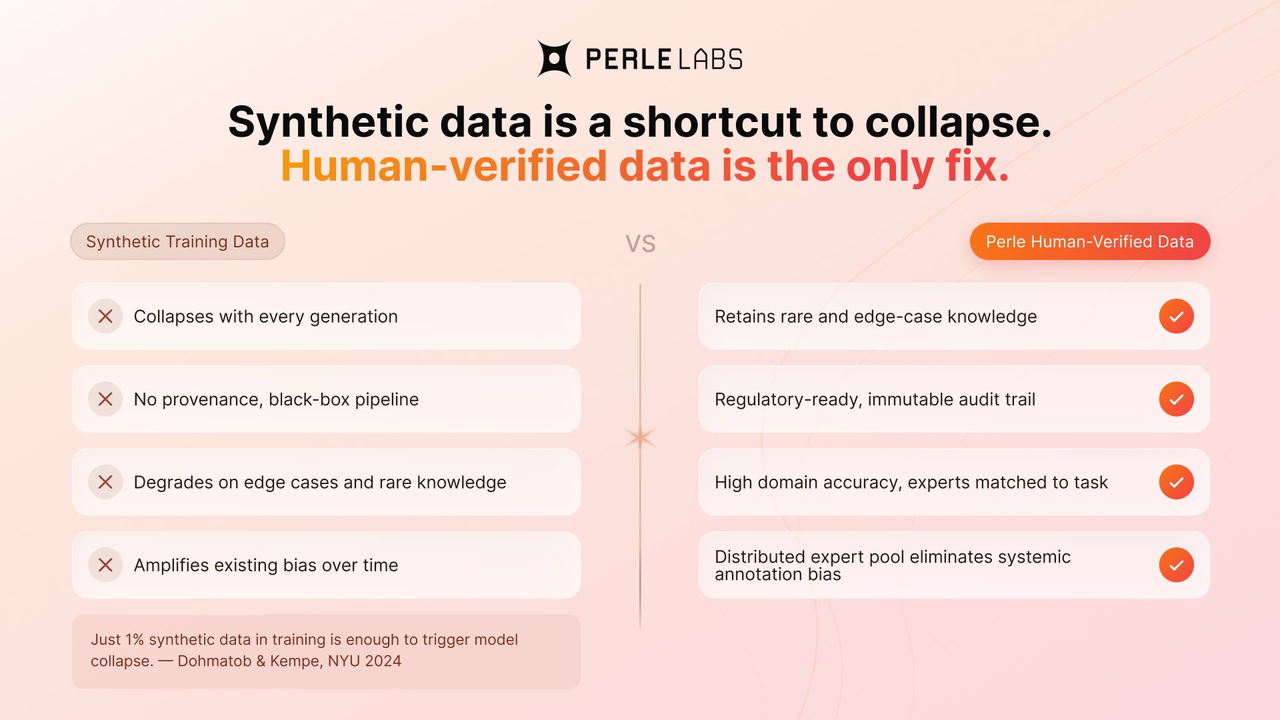

Comparatif central : Perle vs plateformes d’annotation de données traditionnelles

Perle et les plateformes traditionnelles se distinguent sur plusieurs axes. Le tableau ci-dessous résume les principaux points de comparaison :

| Dimension | Plateforme traditionnelle (Scale AI / Appen) | Perle (modèle Web3) |

|---|---|---|

| Qualité des données | Assistance automatisée + QA centralisée ; précision élevée, dépend de l’échantillonnage, biais sur cas limites | Réseau d’experts + évaluation on-chain ; benchmarks supérieurs de 70 %, précision 99,9 %, priorité à la justesse sur la rapidité |

| Mécanisme d’incitation | Paiement fixe par tâche/heure, commission plateforme 70 %, incitations court terme | Tokens PRL + réputation on-chain ; 80–90 % du rendement conservé par les contributeurs, engagement de qualité durable |

| Structure de coûts | Frais de plateforme élevés + nettoyage QA (600 000 $/an en moyenne) | Désintermédiation, règlement instantané, suppression du nettoyage et des délais (30–90 jours → 400 ms) |

| Fiabilité des données | Centralisé, opaque, confiance dans la plateforme, traçabilité limitée | Registres immuables on-chain, chaque donnée liée à la réputation, audit chiffré |

| Scalabilité | Cloud Web2, gestion complexe, faible rétention des annotateurs anonymes | Solana haut débit + guildes d’experts mondiales, réputation, expansion modulaire |

Qualité des données

Les plateformes traditionnelles privilégient la rapidité et le volume, avec pré-annotation automatisée et relecture manuelle pour un haut débit. Mais la qualité dépend de contrôles centralisés, et les annotateurs anonymes privilégient souvent la quantité, générant des problèmes de régression lors de l’entraînement. Perle s’appuie sur des guildes d’experts (médecins, avocats) et des récompenses on-chain pour la justesse. Les benchmarks montrent une surperformance de plus de 70 % dans des secteurs comme l’imagerie médicale ou la robotique, ce qui la rend adaptée aux scénarios à haut risque et forte exigence de précision.

Mécanisme d’incitation

Dans les modèles traditionnels, la rémunération est fixe et la plateforme capte la valeur, d’où une faible rétention et motivation. Perle combine récompenses PRL et réputation on-chain : les contributions de qualité obtiennent des scores, ouvrent l’accès à des tâches de valeur supérieure et créent un cercle vertueux « contribution—réputation—rendement ».

Structure de coûts

Les entreprises utilisant des plateformes traditionnelles doivent souvent prévoir un budget supplémentaire pour le nettoyage des données et subissent des délais de règlement (30–90 jours). Le règlement instantané on-chain et la désintermédiation de Perle permettent d’économiser environ 600 000 $ par an, tandis que les annotateurs obtiennent des rendements plus élevés et renforcent l’écosystème.

Fiabilité des données

Le modèle « boîte noire » des plateformes traditionnelles rend difficile la vérification de l’origine des données, générant des risques de « données fantômes ». Perle enregistre chaque contribution on-chain, liant identité et réputation d’expert. Les entreprises peuvent auditer l’ensemble du processus, améliorant conformité et explicabilité.

Scalabilité

Les plateformes traditionnelles sont limitées par l’architecture Web2, ce qui rend coûteuse la coordination de millions d’annotateurs anonymes. Perle s’appuie sur la modularité de la blockchain publique et le filtrage par réputation pour permettre une expansion mondiale fluide tout en maintenant une forte rétention.

Comment le Web3 recompose le marché des données IA ?

La technologie Web3 transforme le marché des données IA sur trois plans. La Blockchain fournit des registres infalsifiables, faisant passer la donnée du statut « d’actif interne plateforme » à « actif vérifiable ». Les incitations par tokens permettent aux participants de partager la valeur des données, corrigeant l’asymétrie des modèles traditionnels.

L’architecture décentralisée réduit aussi le contrôle des intermédiaires, favorisant une mise en relation directe entre offre et demande. Cette évolution oriente le marché des données du « crowdsourcing de masse » vers la « production experte » et ouvre la voie à l’émergence de data DAO ou de marketplaces on-chain.

Forces et défis principaux de Perle

Perle présente de nettes forces pour fournir des données de haute qualité et garantir la transparence. Son mécanisme d’experts permet de traiter des tâches IA complexes, tandis que la vérification on-chain offre confiance et auditabilité aux entreprises. Le système d’incitation attire des participants de qualité à l’échelle mondiale.

Cependant, des défis subsistent. La production de données de qualité dépend de talents professionnels, ce qui peut limiter la rapidité d’expansion. Le niveau d’accès et la maturité de l’écosystème Web3 doivent progresser. Enfin, l’adoption par les entreprises et les cadres réglementaires influenceront fortement le développement.

Perle vs plateformes traditionnelles : scénarios d’application

Sur le plan applicatif, les deux modèles sont complémentaires.

Les plateformes traditionnelles conviennent aux tâches de grande ampleur, sensibles aux coûts et à faible exigence de précision, comme la classification d’images ou l’annotation simple de textes.

Perle est plus adaptée aux scénarios exigeant précision et traçabilité, tels que l’analyse d’images médicales, le traitement de documents juridiques ou la construction de données pour des raisonnements complexes. Ces tâches requièrent un niveau de qualité extrême et reposent sur l’expertise.

| Scénario | Plateforme traditionnelle recommandée | Perle recommandée |

|---|---|---|

| Annotation générale à grande échelle (ex : classification d’images) | Haut débit, barrière d’entrée faible, idéal pour la masse | QA expert améliore la précision, coûts légèrement supérieurs |

| Domaines à risque élevé (imagerie médicale, contrats juridiques) | QA dépend de la plateforme, traçabilité faible | Réputation d’expert on-chain + audit, privilégié pour la conformité |

| Startups à budget limité | Services standardisés, adoption facile | Désintermédiation réduit les coûts à long terme, nécessite adaptation Web3 |

| Scénarios de conformité (souveraineté, explicabilité) | Audits internes complexes | Transparence on-chain complète, approbation réglementaire facilitée |

Synthèse

La comparaison entre Perle et les plateformes traditionnelles d’annotation de données illustre la transition de la « confiance centralisée » à la « confiance par protocole ». Les plateformes traditionnelles misent sur l’échelle et l’efficacité, tandis que les modèles Web3 optimisent la production de données par la transparence et l’incitation.

À long terme, le marché des données IA pourrait adopter une structure en couches : les plateformes traditionnelles continueront de répondre aux besoins de masse, tandis que des protocoles comme Perle se concentreront sur l’approvisionnement en données à forte valeur ajoutée. Leur développement conjoint contribuera à définir le plafond des capacités des modèles IA.

FAQ

Quelle est la principale différence entre Perle et Scale AI ?

Scale AI privilégie l’automatisation et le crowdsourcing à haut débit ; Perle s’appuie sur un réseau d’experts on-chain et des incitations par réputation, avec une précision et une auditabilité supérieures — particulièrement pour les domaines à risque élevé.

Comment les plateformes traditionnelles garantissent-elles la qualité des données ?

Par échantillonnage QA centralisé, assistance automatisée et relectures multiples. La traçabilité repose néanmoins sur les registres internes et ne permet pas de vérifier les contributeurs on-chain.

Pourquoi la qualité des données de Perle est-elle supérieure ?

Parce qu’elle intègre la participation d’experts, ainsi que des mécanismes de réputation et d’incitation on-chain.

Comment Perle filtre-t-elle ses annotateurs ?

Par la vérification des guildes d’experts (médecins, avocats, etc.) et l’utilisation de scores de réputation on-chain, privilégiant les tâches de qualité et évitant la participation anonyme de faible niveau.

Le modèle Web3 est-il toujours supérieur ?

Non, il est surtout pertinent pour les scénarios exigeant une qualité de données élevée, pas pour toutes les tâches.

Quels scénarios IA conviennent à Perle ?

Imagerie médicale, documents juridiques, perception robotique et autres domaines nécessitant des données précises et traçables — plutôt que des tâches de production de masse simples.

Articles Connexes

Plasma (XPL) face aux systèmes de paiement traditionnels : une nouvelle approche du règlement transfrontalier et du cadre de liquidité pour les stablecoins

Comment faire votre propre recherche (DYOR)?

Falcon Finance vs Ethena : analyse approfondie du paysage des stablecoins synthétiques

Qu'entend-on par analyse fondamentale ?

Jito vs Marinade : analyse comparative des protocoles de Staking de liquidité sur Solana