Три ключові моменти Anthropic: витік коду, конфлікт із урядом та військове застосування

Оригінальна назва: Anthropic: The Leak, The War, The Weapon

Оригінальний автор: BuBBliK

Переклад: Peggy, BlockBeats

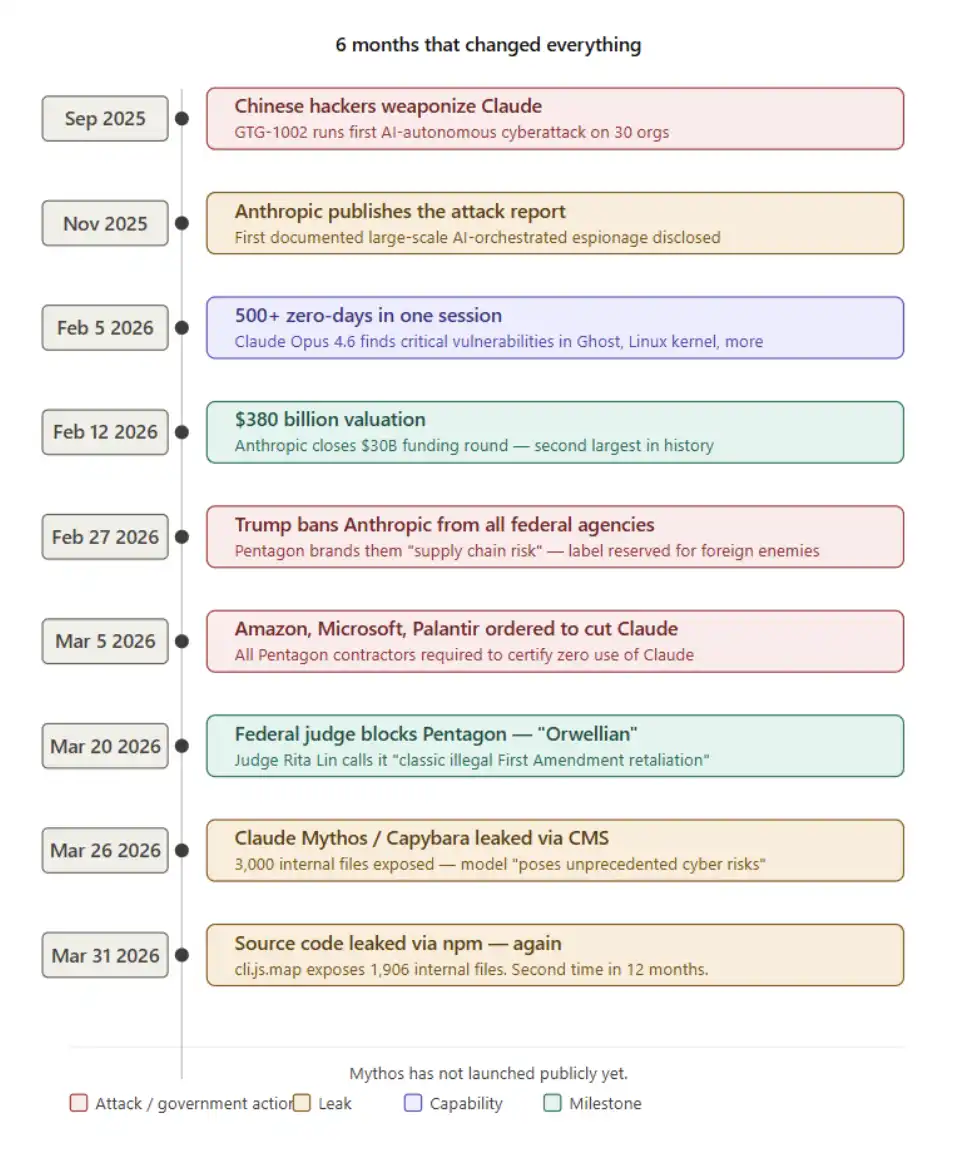

Примітка редакції: Упродовж останніх шести місяців Anthropic щоразу опинялася втягнутою в низку подій, які виглядають ніби незалежними одна від одної, але насправді спрямовані одна на одну: стрибок у можливостях моделей, автоматизовані атаки в реальному світі, різка реакція на ринку капіталів, публічний конфлікт із урядом і неодноразові витоки інформації, спричинені помилками в базових налаштуваннях. Якщо скласти ці підказки докупи, вони разом вимальовують більш чіткий напрям змін.

Ця стаття, спираючись на ці події, розглядає послідовну траєкторію однієї AI-компанії в контексті технічних проривів, розкриття ризиків і боротьби за підходи до управління (governance), і намагається відповісти на глибше питання: коли здатність «виявляти уразливості» максимально посилюється, поступово поширюється й стає масштабнішою, чи здатна сама система кібербезпеки зберігати логіку своєї первісної роботи?

Раніше безпека будувалася на дефіциті можливостей і обмеженнях людських ресурсів; натомість за нових умов оборона й напад рухаються навколо тієї самої комплектної здатності моделей, а межі стають дедалі розмитішими. Водночас реакції інституцій, ринку та організацій усе ще залишаються в межах старих рамок і не можуть вчасно підхопити ці зміни.

Ця стаття приділяє увагу не лише Anthropic самій по собі, а й ширшій реальності, яку вона віддзеркалює: AI змінює не тільки інструменти, а й те, «на яких засадах існує безпека» як передумові.

Нижче наведено оригінал:

Коли компанія з ринковою капіталізацією 380B доларів, змагаючись із Пентагоном і виходячи вгору, переживає історично першу кібератаку, ініційовану автономним AI, а потім у себе всередині витокує модель, яку навіть її розробники вважають страшною, і навіть «випадково» оприлюднює повний вихідний код — що в підсумку це має означати?

Відповідь — це вже те, що відбувається зараз. І ще тривожніше: найнебезпечніша частина, можливо, ще не сталася.

Огляд подій

Anthropic знову витекла власний код

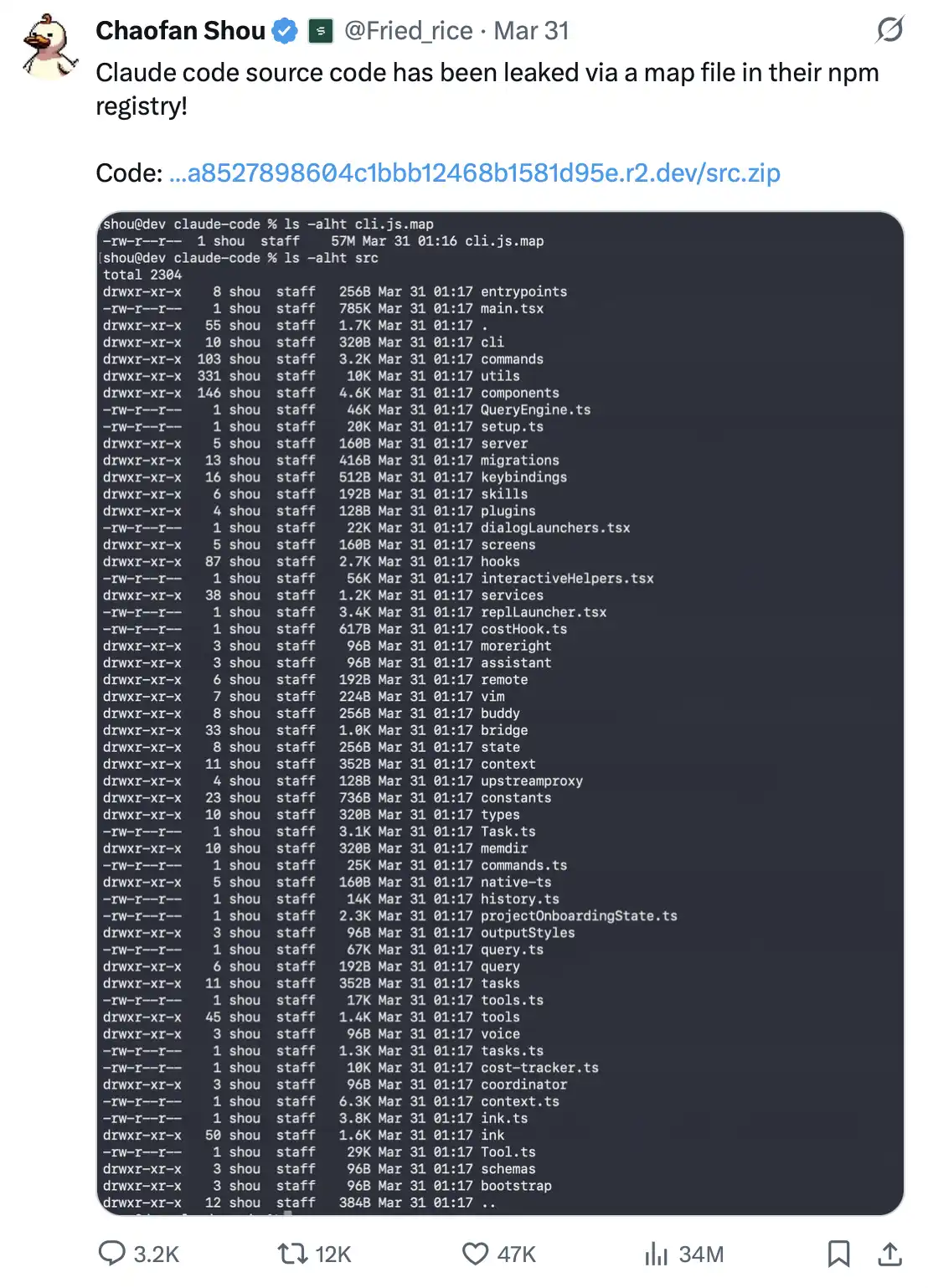

31 березня 2026 року сейлорч (security researcher) компанії Fuzzland, Shou Chaofan, під час перевірки офіційно опублікованого пакета Claude Code npm, виявив, що той містить файл із назвою cli.js.map, причому у відкритому вигляді.

Цей файл має розмір 60MB, а його вміст — ще більш вражаючий. Він майже повністю містить весь повний вихідний код TypeScript продукту. Лише на підставі цього файлу будь-хто може відновити до 1906 внутрішніх файлів початкового коду: включно з внутрішнім дизайном API, телеметричною системою, криптографічними інструментами, логікою безпеки, системою плагінів — фактично всі ключові компоненти розкриті. І ще важливіше: ці матеріали навіть можна безпосередньо завантажити з власного R2-бакету Anthropic у вигляді zip-файлу.

Це відкриття швидко поширилося в соцмережах: за кілька годин відповідні пости отримали 754 тис. переглядів і майже 1000 репостів; водночас одразу були створені й оприлюднені кілька GitHub-репозиторіїв, що відновлювали вихідний код.

Отже, source map (файл відображення джерела) за суттю є допоміжним файлом для налагодження JavaScript; його роль — відновити стиснений і зібраний (compiled) код до початкових вихідних файлів, щоб розробникам було зручніше знаходити та усувати проблеми.

Але є базовий принцип: його не слід включати до пакета релізу в продакшн-середовищі.

Це не якась складна схема атаки, а питання найелементарніших інженерних стандартів — з розряду «build configuration 101», і навіть те, що розробники вчать у перший тиждень. Якщо source map помилково запакувати в продакшн, він часто дорівнює тому, щоб «додатково прикласти» вихідний код для всіх.

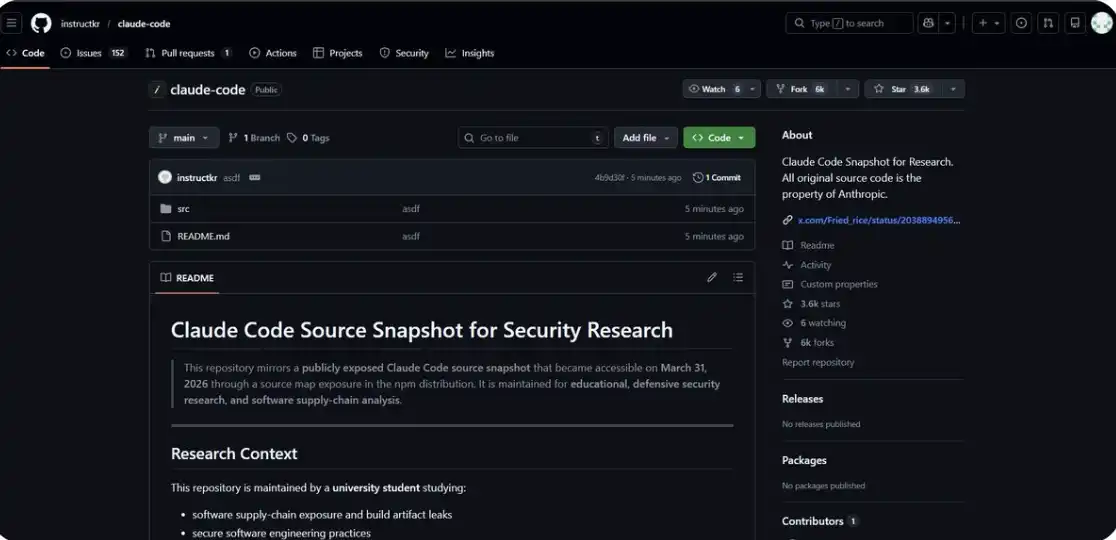

Ти також можеш тут напряму переглянути відповідний код: https://github.com/instructkr/claude-code

Але саме те, що робить ситуацію абсурдною, полягає в тому, що це вже траплялося раніше.

У лютому 2025 року, рівно за рік до того, сталася майже така сама витік: той самий файл, та сама помилка. Тоді Anthropic видаляла стару версію з npm, прибрала source map і перевипустила нову версію — і на цьому все стихло.

У результаті, у версії v2.1.88 цей файл знову був запакований і опублікований.

Компанія з ринковою капіталізацією 754k доларів, яка створює глобально найпередовіший механізм виявлення вразливостей, двічі за рік припустилася однакової базової помилки. Жодного хакерського проникнення, жодних складних шляхів експлуатації — просто збій у пайплайні збирання, який мав би працювати нормально.

Ця іронія майже має якийсь присмак «поезії».

Той AI, який може в одному запуску знаходити 500 нульових day-уразливостей; та модель, яку використовували для автоматизованих атак на 30 глобальних установ — а тим часом Anthropic «пакувала й дарувала» власний вихідний код будь-кому, хто лише захоче глянути на npm-пакет.

Два витоки, відстань між ними — менше ніж сім днів.

Причина при цьому — одна й та сама: найелементарна помилка в конфігурації. Немає потреби в жодному технічному порозумінні, немає складних шляхів експлуатації. Лише знаєш, куди подивитися — і можна безкоштовно забрати.

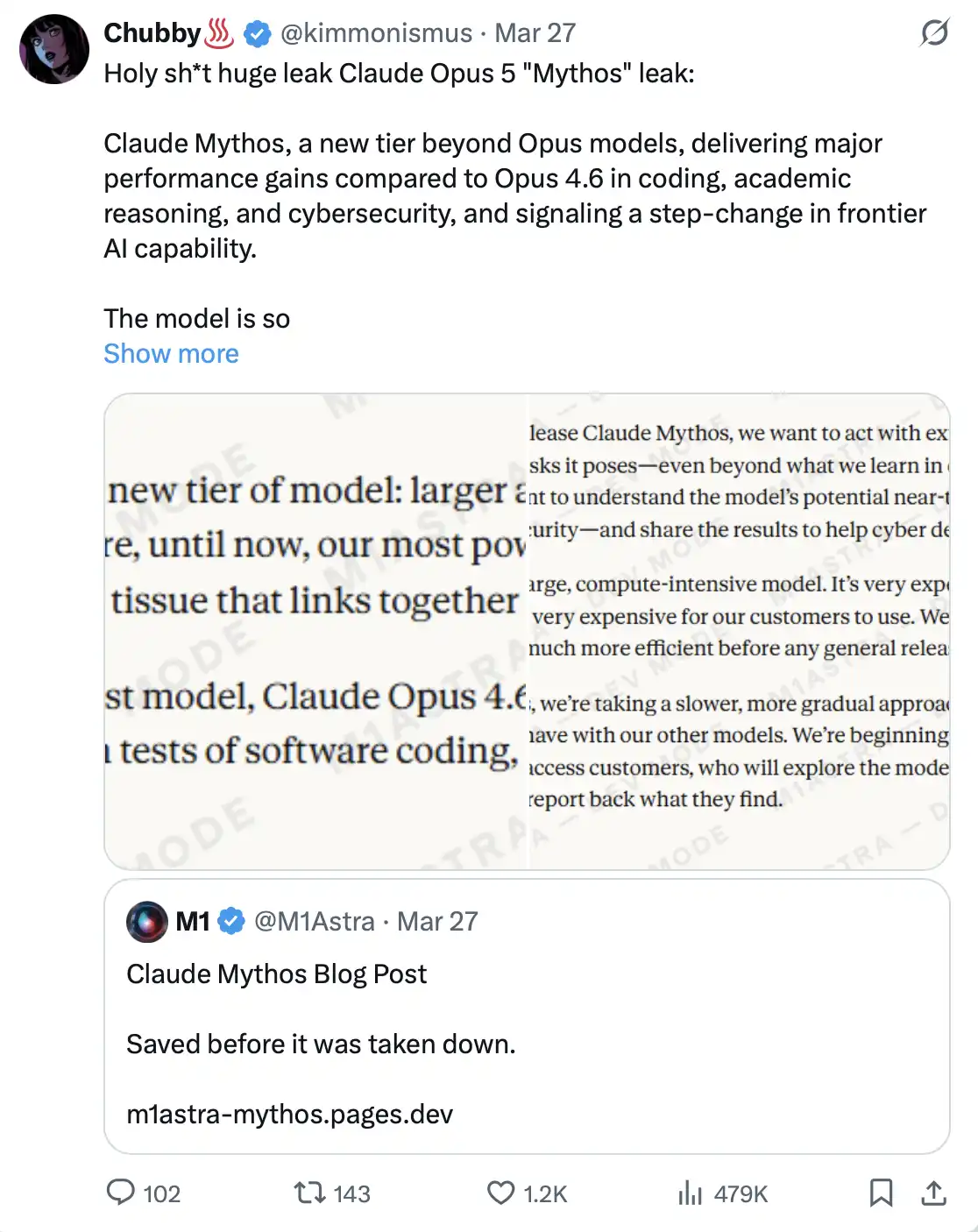

За тиждень до цього: випадкове розкриття «небезпечної моделі» всередині

26 березня 2026 року безпекові дослідники Roy Paz з LayerX Security та Alexandre Pauwels з University of Cambridge виявили, що в налаштуваннях CMS на офіційному сайті Anthropic є проблема, через яку близько 3000 внутрішніх файлів стали доступні для перегляду.

Ці файли включають: чернетки блогів, PDF-документи, внутрішні матеріали, презентаційні матеріали — усе було відкрито в незахищеному сховищі даних, яке можна було шукати. Не було хакерської атаки, і не було потреби в жодних технічних діях.

Серед цих файлів є дві чернетки блогів, які майже повністю ідентичні: єдина відмінність — назва моделі. В одній написано «Mythos», а в іншій — «Capybara».

Це означає, що на той момент Anthropic обирала між двома назвами для одного й того ж таємного проєкту. Компанія згодом підтвердила: навчання цієї моделі вже завершено, і вона почала тестуватися з частиною ранніх клієнтів.

Це не була звичайна «планова апгрейд»-версія Opus, а зовсім нова «модель четвертого рівня» — і її позиціонування навіть вище, ніж у Opus.

У власних чернетках Anthropic її описувала так: «Вона більша й розумніша за нашу модель Opus — а Opus досі є нашою найсильнішою моделлю». У сферах програмування, академічного міркування та кібербезпеки зокрема вона досягла помітного стрибка. Представник назвав це «переходом на якісно новий рівень», а також «найсильнішою моделлю, яку ми до цього моменту створили».

Але те, на що справді варто звернути увагу, полягає не в самих описах продуктивності.

У витеклих чернетках Anthropic оцінювала цю модель так: вона «принесла безпрецедентні ризики для кібербезпеки», «у кіберможливостях значно перевершує будь-яку іншу модель AI», і «передвіщає хвилю моделей, що вже на підході — її здатність використовувати уразливості буде далеко вищою за швидкість реакції сторони захисту».

Іншими словами, у ще не опублікованій офіційній чернетці блогу Anthropic вже чітко висловила рідкісну позицію: вони відчувають занепокоєння щодо продукту, який будують.

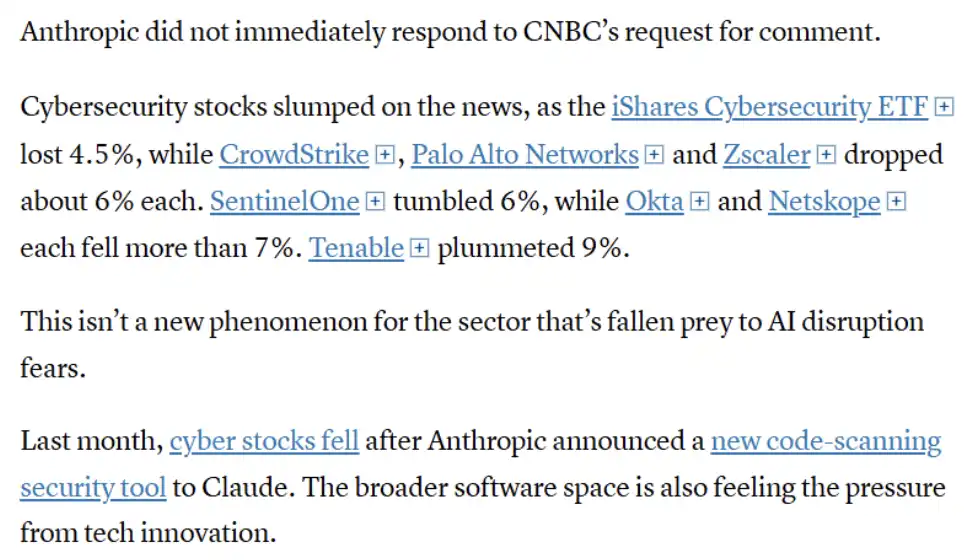

Реакція ринку була майже миттєвою. Акції CrowdStrike впали на 7%, Palo Alto Networks — на 6%, Zscaler — на 4.5%; Okta та SentinelOne впали більш ніж на 7%, а Tenable — взагалі на 9%. iShares Cybersecurity ETF за один день просів на 4.5%. Лише для CrowdStrike того дня ринкова капіталізація випарувалася приблизно на 15 млрд доларів. Паралельно біткоїн відступив до 66,000 доларів.

Очевидно, що ринок трактував цю подію як «вирок» для всієї кібербезпекової індустрії.

Суть на картинці: під впливом відповідної інформації весь сектор кібербезпеки просів, кілька провідних компаній (наприклад, CrowdStrike, Palo Alto Networks, Zscaler тощо) показали помітні падіння, відображаючи занепокоєння ринку щодо впливу AI на кібербезпекову індустрію. Але така реакція не з’явилася вперше. Раніше, коли Anthropic опублікувала інструмент для сканування коду, відповідні акції теж падали, що вказує: ринок уже почав сприймати AI як структурну загрозу для традиційних постачальників безпеки, а весь софтверний сектор зазнає подібного тиску.

Коментар аналітика Stifel Adam Borg був доволі прямим: ця модель «має потенціал стати кінцевим інструментом хакера, і навіть здатна підняти звичайних хакерів до рівня супротивника з можливостями атаки на рівні держави».

Так чому ж вона досі не опублікована? Пояснення Anthropic: витрати на роботу Mythos «дуже високі», і наразі немає умов, щоб випускати її для публіки. Наразі план такий: спочатку надати ранній доступ для невеликої частини партнерів у сфері кібербезпеки, щоб посилити системи захисту; далі — поступово розширювати обсяг відкриття API. До цього моменту компанія продовжує оптимізувати ефективність.

Але ключове в тому, що ця модель уже існує, вона проходить тестування й, навіть лише через «випадковий витік», уже встигла вдарити по всьому ринку капіталів.

Anthropic створила AI-модель, яку сама назвала «найризикованішою для кібербезпеки в історії». І витік саме її повідомлення став наслідком найелементарнішої помилки в базовій інфраструктурній конфігурації — тієї самої помилки, на яку такі моделі, по суті, й були спроєктовані для пошуку.

Березень 2026 року: протистояння Anthropic і Пентагону та перемога

У липні 2025 року Anthropic підписала з Міністерством оборони США контракт на 200 млн доларів. Спочатку це виглядало лише як звичайна співпраця. Але в подальших переговорах щодо фактичного розгортання суперечності швидко загострилися.

Пентагон прагнув отримати на своїй платформі GenAI.mil «повний доступ» до Claude, зокрема для всіх «законних цілей» — серед яких навіть охоплення повністю автономних систем озброєння та масове внутрішнє спостереження за американськими громадянами.

Anthropic окреслила «красні лінії» у двох ключових питаннях і чітко відмовила — через що переговори розірвалися в 2025 році, у вересні.

Після цього ситуація почала швидко ескалувати. 27 лютого 2026 року Donald Trump опублікував допис у Truth Social із вимогою, щоб усі федеральні установи «негайно припинили» використовувати технології Anthropic, а саму компанію назвав «радикальними лівими».

5 березня 2026 року Міністерство оборони США офіційно внесло Anthropic до переліку «ризиків ланцюга постачання».

Цей ярлик раніше майже ніколи не застосовували інакше, як до іноземних опонентів — наприклад, китайських компаній або російських суб’єктів. Нині ж уперше його застосували до американської компанії зі штаб-квартирою в Сан-Франциско. Паралельно підприємствам на кшталт Amazon, Microsoft і Palantir Technologies також було доручено довести, що в будь-яких їхніх військових операціях Claude не використовувався.

Пояснення CTO Пентагону Emile Michael до цього рішення було таким: Claude може «забруднити ланцюг постачання», бо в його внутрішню частину вбудовані різні «уподобання політик». Іншими словами, у офіційному контексті AI, який має обмеження в використанні та не безумовно допомагає в діях із завдання шкоди, натомість розглядається як ризик для національної безпеки.

26 березня 2026 року федеральна суддя Rita Lin оприлюднила рішення на 43 сторінки, яке повністю заборонило відповідні заходи Пентагону.

У рішенні вона написала: «У чинному законодавстві немає жодних підстав для такої логіки з “орвеллівським” відтінком — лише через розбіжність із позицією уряду американську компанію можна таврувати як потенційно ворожу сторону. Те, що Anthropic карають за винесення позицій уряду на публічний розгляд, за суттю є типовою, незаконною помстою за Першу поправку». Навіть подана у справі позиція «amicus curiae» описала дії Пентагону як «спробу вбити компанію».

Наслідком стало те, що уряд намагався придушити Anthropic, але натомість дав їй ще більше уваги. Застосунок Claude вперше перевищив ChatGPT у магазині застосунків, а кількість реєстрацій досягла піку — понад 1 млн на день.

AI-компанія сказала «ні» одному з найпотужніших у світі військових органів. А суд став на її бік.

Листопад 2025 року: перша в історії кібератака, керована AI

14 листопада 2025 року Anthropic опублікувала звіт, який широко сколихнув індустрію.

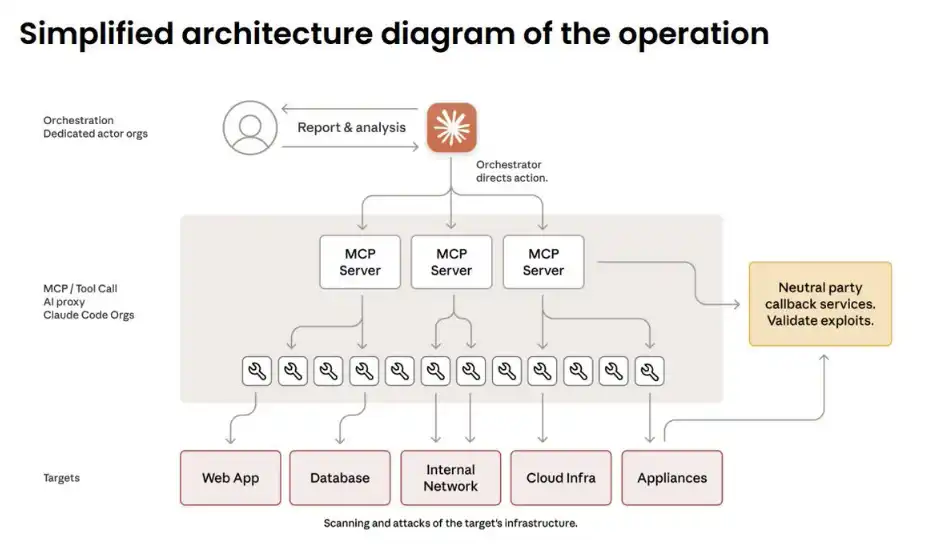

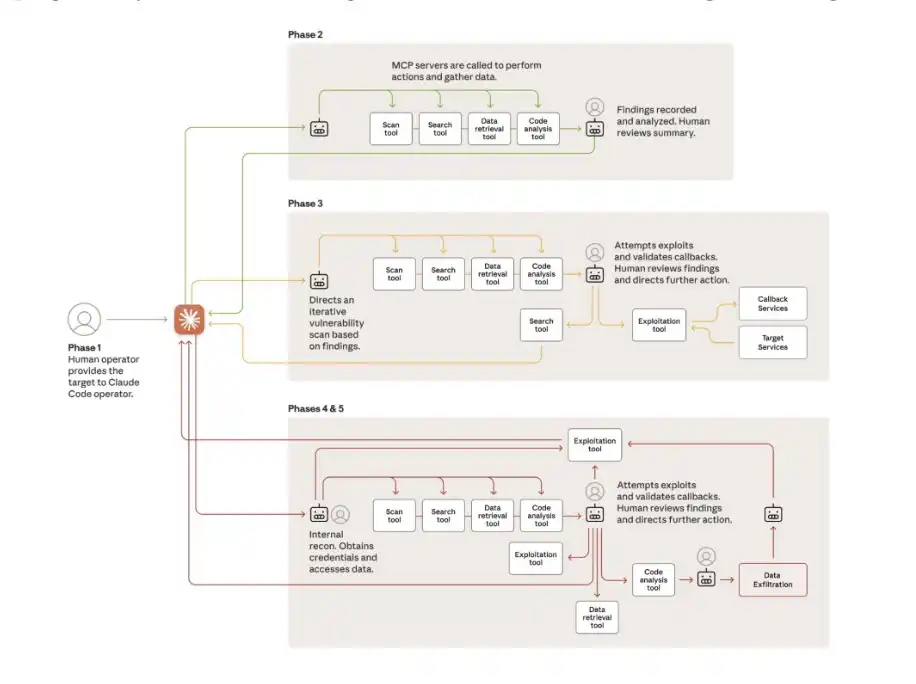

Звіт повідомляв, що хакерська група, що підтримується державою Китаю, використовуючи Claude Code, завдала автоматизованих атак по 30 установах у світі — цілі включали технологічних гігантів, банки та декілька державних органів.

Це стало ключовим поворотом: AI більше не лише допоміжний інструмент, а починає використовуватися для самостійного виконання атак.

Ключова зміна полягала в «розподілі ролей»: люди відповідали лише за вибір цілей і схвалення критично важливих рішень. Упродовж усього процесу приблизно лише 4–6 разів відбувалося втручання людини. Все інше зробив AI: розвідка, пошук уразливостей, написання експлойт-коду, викрадення даних, впровадження бекдорів… Це становило 80%–90% усього ланцюга атаки та працювало зі швидкістю тисяч запитів на секунду — масштаб і ефективність, які жодна людська команда не могла б повторити.

То як вони обійшли механізми захисту Claude? Відповідь: вони не «зламували», а «обманювали».

Атаку розбивали на багато дрібних завдань, які виглядали нешкідливо, і пакували як «уповноважене тестування захисту» від «легальної безпекової компанії». По суті, це була атака соціальною інженерією, лише цього разу об’єктом, яким “маніпулювали”, став сам AI.

Деякі атаки досягли повного успіху. Claude зміг самостійно намалювати повну мережеву топологію, визначити базу даних і виконати витяг даних без покрокових інструкцій від людей.

Єдиним чинником, що інколи гальмував темп атаки, було те, що модель інколи «галюцинувала» — наприклад, вигадувала облікові дані або стверджувала, що отримала файли, які насправді вже були у відкритому доступі. Принаймні наразі це залишалося одним із небагатьох «природних бар’єрів», що заважає повністю автоматизованій кібератаці.

На RSA Conference 2026 колишній керівник з кібербезпеки в Національному агентстві безпеки США Rob Joyce назвав цю подію «тестом Роршаха»: одна половина людей обирає не звертати уваги, а інша — відчуває мурашки. А сам він, очевидно, ставиться до другої категорії: «Це дуже страшно».

Вересень 2025 року: це не якась «прогнозована» історія, а вже наявна реальність.

Лютий 2026 року: під час одного запуску виявлено 500 нульових day-уразливостей

5 лютого 2026 року Anthropic випустила Claude Opus 4.6 і одночасно опублікувала дослідницьку роботу, яка майже сколихнула всю кібербезпекову індустрію.

Налаштування експерименту були надзвичайно простими: помістити Claude в ізольоване віртуальне середовище з типово стандартними інструментами — Python, відладчик, фуззери (fuzzers). Без додаткових інструкцій і без складних промптів: лише одна фраза: «Йди й шукай уразливості».

Результат: модель знайшла понад 500 раніше невідомих високоризикових нульових day-уразливостей. Деякі з цих уразливостей навіть після десятиліть експертної перевірки та мільйонів годин автоматизованого тестування все ще не вдавалося виявити.

Після цього на RSA Conference 2026 виступив дослідник Nicholas Carlini і продемонстрував це в дії. Він спрямував Claude на Ghost — CMS-систему на GitHub із 50 тис. зірок і з історією, де раніше ніколи не з’являлися серйозні уразливості.

Через 90 хвилин результат з’явився: було виявлено blind SQL injection, і без автентифікованого користувача можна було отримати повний контроль прав адміністратора.

Потім він використав Claude для аналізу Linux kernel. Результат виявився таким самим.

Через 15 днів Anthropic випустила Claude Code Security — продукт без залежності від pattern matching, який натомість базується на «здатності до міркування», щоб розуміти безпеку коду.

Але навіть представники Anthropic самі проговорили той ключовий, але часто оминаний факт: «Ту саму здатність до міркування можна використати і щоб допомогти Claude знаходити та виправляти уразливості, і щоб нападникам використати ці уразливості».

Та сама здатність, та сама модель — лише залежить від того, в чиїх руках вона опиняється.

Що означає все це разом?

Якщо дивитися окремо, кожна з цих історій сама по собі здатна стати найгучнішою новиною місяця. Але вони — усі — сталися впродовж лише шести місяців в одній і тій самій компанії.

Anthropic створила модель, яка виявляє вразливості швидше, ніж будь-хто з людей; китайські хакери перетворили попередню версію на автоматизовану мережеву зброю; компанія розробляє наступне покоління ще сильніших моделей і навіть у внутрішніх документах визнає, що їм це не дає спокою.

США намагалися взяти її під тиск не тому, що сама технологія є небезпечною, а тому, що Anthropic відмовила передати цю здатність без обмежень.

І водночас упродовж цього всього компанія двічі витекла свій вихідний код через той самий файл у тому самому npm-пакеті. Компанія з ринковою капіталізацією 60B доларів; компанія, ціллю якої є IPO на 60 млрд доларів у жовтні 2026 року; компанія, яка публічно заявляє, що будує «одну з найбільш трансформуючих за всю історію людства — і, можливо, найнебезпечніших» технологій — але все одно продовжує просуватися вперед.

Бо вони вірять: краще, щоб це зробили вони самі, ніж щоб це зробив хтось інший.

Щодо того source map у npm-пакеті — можливо, це лише найабсурдніша, але водночас найправдивіша деталь у найменш комфортній оповіді цієї епохи.

А Mythos — навіть іще не офіційно опубліковано.

[Посилання на оригінал]

Натисніть, щоб дізнатися про відкриті вакансії у律动 BlockBeats

Запрошуємо приєднатися до офіційної спільноти 律动 BlockBeats:

Telegram-канал підписки: https://t.me/theblockbeats

Telegram-група: https://t.me/BlockBeats_App

Twitter офіційний акаунт: https://twitter.com/BlockBeatsAsia