AI встречает "момент USB-C", как MC идеально объединяется с Ethereum?

Содержимое | Брюс

Редактирование & верстка | Хуанхуан

Дизайн | Дейзи

“USB-C момент” в эволюции ИИ: в ноябре 2024 года протокол MCP, выпущенный компанией Anthropic, вызывает землетрясение в Силиконовой долине. Этот открытый стандарт, названный “USB-C мира ИИ”, не только реконструирует способ соединения больших моделей с физическим миром, но и скрывает ключ к решению проблемы монополии ИИ и перестройке производственных отношений цифровой цивилизации. Пока мы все еще обсуждаем масштаб параметров GPT-5, MCP уже тихо прокладывает путь к децентрализованной эпохе AGI…

Брюс: В последнее время я изучаю Model Context Protocol (MCP). Это второе, после ChatGPT, что меня очень волнует в области ИИ, поскольку это может помочь решить три проблемы, над которыми я размышлял много лет:

- Как обычные люди, не являющиеся учеными или гениями, могут участвовать в индустрии ИИ и зарабатывать деньги?

- В чем заключается взаимовыгодное сочетание ИИ и Ethereum?

- Как реализовать AI d/acc? Избежать монополии больших централизованных компаний, цензуры, уничтожения человечества AGI?

01, что такое MCP?

MCP — это открытый стандартный фреймворк, который может упростить интеграцию LLM с внешними источниками данных и инструментами. Если мы сравним LLM с операционной системой Windows, приложения, такие как Cursor, являются клавиатурой и аппаратным обеспечением, тогда MCP — это USB-интерфейс, который поддерживает гибкое подключение внешних данных и инструментов, после чего пользователи могут считывать и использовать эти внешние данные и инструменты.

MCP предлагает три возможности для расширения LLM:

- Ресурсы(知识扩展)

- Инструменты(выполнение функций, вызов внешних систем)

- Подсказки(预编写提示词模板)

MCP может быть разработан и размещен любым человеком, предлагая услуги в качестве сервера, и может быть отключен в любое время.

02, почему нужен MCP

В настоящее время LLM использует как можно больше данных для выполнения большого количества вычислений и генерации множества параметров, интегрируя знания в модель, чтобы обеспечить соответствующий вывод знаний в диалоге. Однако существует несколько значительных проблем:

- Большое количество данных и вычислений требует много времени и оборудования, а знания, используемые для обучения, обычно устарели.

- Модели с большим количеством параметров трудно развертывать и использовать на локальных устройствах, но на самом деле пользователям в большинстве случаев может не понадобиться вся информация для выполнения требований.

- Некоторые модели используют способ сбора данных с помощью пауков для получения внешней информации для вычислений с целью достижения актуальности, однако из-за ограничений пауков и качества внешних данных это может привести к более вводящему в заблуждение содержимому.

- Поскольку ИИ не приносит значительной выгоды создателям, многие сайты и контент начинают внедрять меры против ИИ, генерируя большое количество мусорной информации, что приведет к постепенному снижению качества LLM.

- LLM трудно расширить во всех аспектах внешних функций и операций, таких как точный вызов интерфейса GitHub для выполнения некоторых операций. Он будет генерировать код на основе устаревшей документации, но не может гарантировать его точное выполнение.

03, Эволюция архитектуры толстых LLM и тонких LLM + MCP

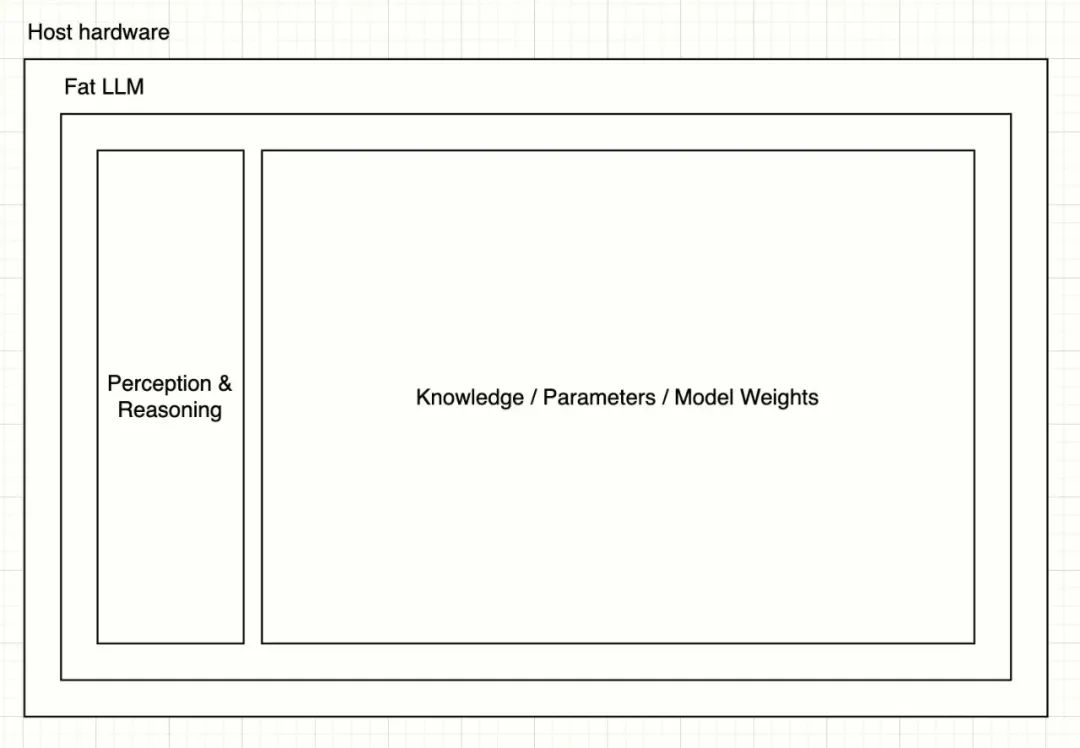

Мы можем рассматривать нынешние сверхмасштабные модели как толстые LLM, архитектура которых может быть представлена на следующей простой схеме:

После ввода информации пользователем, через уровень Восприятия и Рассуждения происходит разбор и логическое обоснование ввода, затем вызываются огромные параметры для генерации результата.

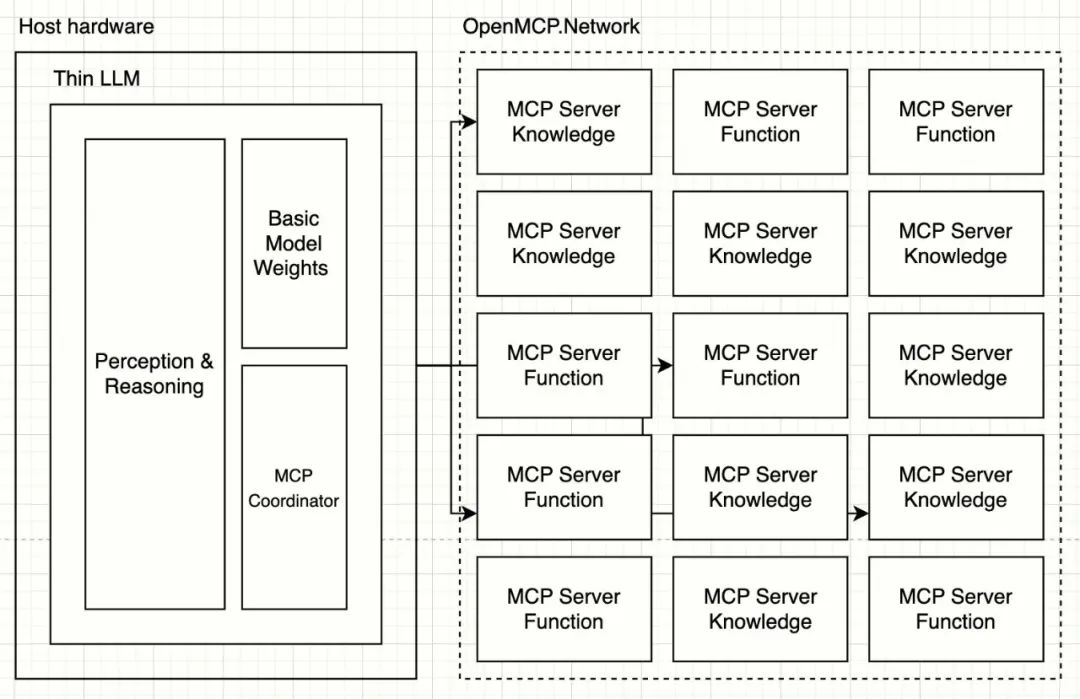

После MCP LLM может сосредоточиться на самом языковом анализе, отделив знания и способности, становясь «тонким» LLM:

В рамках архитектуры Slim LLM, уровень восприятия и рассуждения будет сосредоточен на том, как преобразовать всю информацию о физической среде человека в токены, включая, но не ограничиваясь: голосом, интонацией, запахом, изображениями, текстом, гравитацией, температурой и т.д., а затем через MCP Coordinator организовать и координировать выполнение задач с помощью сотен MCP Servers. Стоимость обучения Slim LLM и скорость значительно возрастут, а требования к развертываемым устройствам станут очень низкими.

04、MCP как решает три основные проблемы

Как обычные люди могут участвовать в индустрии ИИ?

Любой человек с уникальными талантами может создать свой собственный MCP сервер для обслуживания LLM. Например, любитель птиц может предоставить свои многолетние заметки о птицах через MCP. Когда кто-то использует LLM для поиска информации о птицах, будет вызван текущий сервис MCP с заметками о птицах. Создатель также получит долю дохода.

Это более точный и автоматизированный цикл экономики создателей, где содержание услуг более стандартизировано, количество вызовов и выходных токенов можно точно подсчитать. Поставщики LLM могут даже одновременно вызывать несколько MCP серверов Bird Notes, позволяя пользователям выбирать и оценивать, чтобы определить, чье качество лучше, и получить более высокий вес соответствия.

Двойное выигрышное сочетание AI и Ethereum

a. Мы можем создать сеть стимулирования создателей OpenMCP.Network на основе Ethereum. MCP Server должен быть размещен и предоставлять стабильные услуги, пользователи платят поставщикам LLM, а поставщики LLM распределяют реальные стимулы через сеть на вызываемые MCP Servers, чтобы поддерживать устойчивость и стабильность всей сети, побуждая создателей MCP продолжать создание и предоставление качественного контента. Эта сеть будет нуждаться в использовании смарт-контрактов для автоматизации, прозрачности, доверия и защиты от цензуры стимулов. Подписание, проверка прав доступа и защита конфиденциальности в процессе работы могут быть реализованы с использованием технологий Ethereum Wallet, ZK и т.д.

b. Разработка MCP-серверов, связанных с операциями на Ethereum, например, службы вызова кошелька AA, пользователи смогут осуществлять платежи из кошелька в LLM с помощью языка, не раскрывая соответствующие закрытые ключи и права LLM.

c. Также есть различные инструменты для разработчиков, которые упрощают разработку смарт-контрактов Ethereum и генерацию кода.

Реализация децентрализованного ИИ

a. MCP Servers децентрализуют знания и способности ИИ, любой может создавать и размещать MCP Servers, зарегистрировавшись на таких платформах, как OpenMCP.Network, и получать вознаграждение за вызовы. Ни одна компания не может контролировать все MCP Servers. Если поставщик LLM предоставляет несправедливые вознаграждения MCP Servers, создатели поддержат блокировку этой компании, а пользователи, не получив качественных результатов, перейдут к другим поставщикам LLM для обеспечения более справедливой конкуренции.

b. Создатели могут осуществлять тонкую настройку контроля доступа к своим MCP Servers для защиты конфиденциальности и авторских прав. Поставщики тонких LLM должны побуждать создателей вносить вклад в высококачественные MCP Servers, предлагая разумные стимулы.

c. Разрыв в возможностях тонких LLM будет постепенно сглаживаться, поскольку человеческий язык имеет пределы охвата и эволюция происходит очень медленно. Поставщикам LLM придется сосредоточить внимание и средства на качественных MCP-серверах, а не на повторном использовании большего количества графических процессоров для майнинга.

d. Способности AGI будут децентрализованы и уменьшены, LLM будет использоваться только для обработки языка и взаимодействия с пользователем, конкретные способности будут распределены по различным MCP серверам. AGI не будет представлять угрозу для человечества, потому что после отключения MCP серверов возможен только базовый языковой диалог.

05, Общий обзор

- Эволюция архитектуры LLM + MCP серверов по сути является децентрализацией возможностей ИИ, что снижает риск уничтожения человечества AGI.

- Способ использования LLM позволяет проводить статистику и автоматизацию вызовов MCP серверов на уровне токенов, что закладывает основу для создания экономической системы для AI-креаторов.

- Хорошая экономическая система может побудить создателей активно вносить вклад в создание высококачественных MCP-серверов, что приведет к развитию всего человечества и обеспечит положительный цикл. Создатели больше не будут противостоять ИИ, а ИИ также предоставит больше рабочих мест и доходов, разумно распределяя прибыль таких монопольных коммерческих компаний, как OpenAI.

- Эта экономическая система, сочетая свои особенности и потребности создателя, очень хорошо подходит для реализации на базе Ethereum.

06, Перспективы на будущее: Эволюция следующего сценария

- Протоколы MCP или подобные им будут появляться один за другим, несколько крупных компаний начнут конкурировать за определение стандарта.

- Появятся LLM на основе MCP, сосредоточенные на анализе и обработке человеческого языка, с небольшими моделями, подключенными к сети MCP через MCP Coordinator. LLM будет поддерживать автоматическое обнаружение и планирование MCP-серверов без необходимости в сложной ручной настройке.

- Поставщики услуг сети MCP появятся, у каждого будет своя система экономических стимулов, создатели MCP смогут получать доход, зарегистрировав и разместив свои серверы.

- Если система экономического стимулирования сети MCP построена с использованием Ethereum и основана на смарт-контрактах, то транзакции сети Ethereum по консервативным оценкам увеличатся примерно в 150 раз (согласно очень консервативным 100 миллионам вызовов серверов MCP в день, текущий блок 12s включает в себя вычисления 100 txs).