ZKML und verteiltes Computing: Eine potenzielle Governance-Erzählung für KI und Web3

Der Stand von KI und Web 3: Außer Kontrolle geratene Schwärme und Entropiewachstum

In „Out of Control: The New Biology of Machines, Society, and the Economy“ schlug Kevin Kelly einmal ein Phänomen vor: Das Bienenvolk führt Wahlentscheidungen in einem Gruppentanz nach verteiltem Management durch, und das gesamte Bienenvolk wird diesem folgen Gruppentanz Die größten Bienenschwärme der Welt werden zu Meistern einer Veranstaltung. Dies ist auch die sogenannte „Seele des Bienenstocks“, die von Maurice Maeterlinck erwähnt wurde – jede Biene kann ihre eigene Entscheidung treffen, andere Bienen zur Bestätigung anleiten und die endgültige Entscheidung liegt wirklich bei der Gruppe.

Das Gesetz der Entropiezunahme und Unordnung selbst folgt dem Gesetz der Thermodynamik, und die theoretische Visualisierung in der Physik besteht darin, eine bestimmte Anzahl von Molekülen in eine leere Box zu stecken und das endgültige Verteilungsprofil zu berechnen. Spezifisch für Menschen kann der vom Algorithmus erzeugte Mob das Gesetz der Gruppe aufzeigen, auch wenn es individuelle Denkunterschiede gibt. Oft wird er aufgrund von Faktoren wie der Zeit in einer leeren Kiste eingeschränkt und trifft schließlich eine Konsensentscheidung.

Natürlich sind die Gruppenregeln möglicherweise nicht korrekt, aber Meinungsführer, die einen Konsens vertreten und aus eigener Kraft einen Konsens erzielen können, sind absolute Superindividuen. Doch in den meisten Fällen strebt der Konsens nicht die vollständige und bedingungslose Zustimmung aller an, sondern erfordert lediglich eine gemeinsame Identität der Gruppe.

Wir diskutieren hier nicht, ob KI den Menschen in die Irre führen wird. Tatsächlich gibt es bereits viele solcher Diskussionen, sei es die große Menge an Müll, der durch Anwendungen der künstlichen Intelligenz erzeugt wird, die die Authentizität von Netzwerkdaten verunreinigt hat, oder aufgrund von Gruppenentscheidungen. Fehler machen, die zu einigen führen werden Der Vorfall führte zu einer gefährlicheren Situation.

Die aktuelle Situation der KI weist ein natürliches Monopol auf. Beispielsweise erfordert das Training und der Einsatz großer Modelle viele Rechenressourcen und Daten, aber nur wenige Unternehmen und Institutionen verfügen über diese Bedingungen. Diese Hunderte Millionen Daten werden von jedem Monopolbesitzer als Schätze betrachtet, ganz zu schweigen von der gemeinsamen Nutzung der Quellen, selbst ein gegenseitiger Zugriff ist unmöglich.

Dies hat zu einer enormen Datenverschwendung geführt. Jedes große KI-Projekt muss wiederholt Benutzerdaten sammeln, und am Ende bekommt der Gewinner alles – sei es Fusionen und Übernahmen oder Verkäufe, die Erweiterung einzelner Riesenprojekte oder das traditionelle Internet. Die Logik des Rodeos Rennen.

Viele Leute sagen, dass KI und Web 3 zwei verschiedene Dinge sind und keinen Zusammenhang haben – die erste Hälfte des Satzes ist richtig, das sind zwei verschiedene Spuren, aber die zweite Hälfte des Satzes ist problematisch, da sie verteilte Technologie verwendet, um das Monopol zu begrenzen der künstlichen Intelligenz und der Einsatz künstlicher Intelligenztechnologie zur Förderung der Bildung eines dezentralen Konsensmechanismus ist einfach eine natürliche Sache.

Grundlegende Schlussfolgerung: Lassen Sie die KI einen echten Konsensmechanismus für verteilte Gruppen bilden

Der Kern der künstlichen Intelligenz liegt im Menschen selbst, und Maschinen und Modelle sind nichts anderes als Spekulation und Nachahmung menschlichen Denkens. Die sogenannte Gruppe ist eigentlich schwer zu abstrahieren, denn was wir jeden Tag sehen, ist immer noch ein echtes Individuum. Das Modell besteht jedoch darin, umfangreiche Daten zum Lernen und Anpassen zu verwenden und schließlich die Gruppenform zu simulieren. Bewerten Sie nicht, welche Ergebnisse dieses Modell hervorrufen wird, denn Vorfälle, bei denen Gruppen Böses begehen, kommen nicht ein- oder zweimal vor. Aber das Modell stellt die Generierung dieses Konsensmechanismus dar.

Wenn beispielsweise für ein bestimmtes DAO der Governance-Mechanismus implementiert wird, wirkt sich dies zwangsläufig auf die Effizienz aus. Der Grund dafür ist, dass die Bildung eines Gruppenkonsenses eine mühsame Sache ist, ganz zu schweigen von der Reihe von Abstimmungen, Statistiken usw. Wenn die Governance von DAO in Form eines KI-Modells verkörpert wird und die gesamte Datenerfassung aus den Sprachdaten aller DAO-Mitglieder erfolgt, wird die Ausgabeentscheidung tatsächlich näher am Gruppenkonsens liegen.

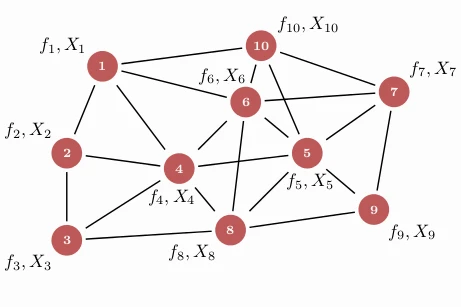

Der Gruppenkonsens eines einzelnen Modells kann nach obigem Schema trainiert werden, ist für diese Individuen jedoch immer noch eine Insel. Wenn es ein kollektives Intelligenzsystem zur Bildung einer Gruppen-KI gibt, wird jedes KI-Modell in diesem System zusammenarbeiten, um komplexe Probleme zu lösen. Tatsächlich wird dies einen großen Einfluss auf die Stärkung der Konsensebene haben.

Für kleine Sammlungen können Sie unabhängig eine Ökologie aufbauen oder eine kooperative Sammlung mit anderen Sammlungen bilden, um sehr große Rechenleistung oder Datentransaktionen effizienter und kostengünstiger zu bewältigen. Aber hier kommt das Problem erneut: Der Status Quo zwischen den verschiedenen Modelldatenbanken ist völlig misstrauisch und abschreckend gegenüber anderen – genau darin liegen die natürlichen Eigenschaften der Blockchain: durch Vertrauenslosigkeit, wirklich verteilte KI-Maschine-zu-Maschine-Sicherheit und effiziente Interaktion.

Ein globales intelligentes Gehirn kann dafür sorgen, dass die ursprünglichen unabhängigen und einfunktionalen KI-Algorithmusmodelle miteinander kooperieren, komplexe intelligente Algorithmusprozesse intern ausführen und ein verteiltes Gruppenkonsensnetzwerk bilden, das weiter wachsen kann. Dies ist auch die größte Bedeutung der Stärkung des Web 3 durch KI.

Privatsphäre und Datenmonopol? Kombination aus ZK und maschinellem Lernen

Der Mensch muss gezielte Vorkehrungen treffen, sei es gegen das Böse der KI oder aus Gründen des Schutzes der Privatsphäre und der Angst vor Datenmonopolen. Das Kernproblem besteht darin, dass wir nicht wissen, wie die Schlussfolgerung gezogen wurde, und dass der Betreiber des Modells auch nicht die Absicht hat, diese Frage zu beantworten. Und für die oben erwähnte Kombination des globalen intelligenten Gehirns ist es umso notwendiger, dieses Problem zu lösen, sonst ist keine Datenpartei bereit, ihren Kern mit anderen zu teilen.

ZKML (Zero Knowledge Machine Learning) ist eine Technologie, die wissensfreie Beweise für maschinelles Lernen verwendet. Zero-Knowledge Proofs (ZKP), das heißt, der Prüfer (Prüfer) kann den Prüfer (Verifizierer) von der Echtheit der Daten überzeugen, ohne die spezifischen Daten preiszugeben.

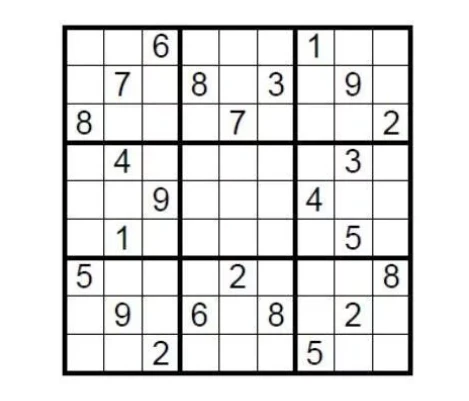

Zitiert mit einem theoretischen Fall. Es gibt ein Standard-9×9-Sudoku. Die Abschlussbedingung besteht darin, die Zahlen von 1 bis 9 in die neun Neunquadrate-Raster einzutragen, sodass jede Zahl in jeder Zeile, Spalte und in jedem Neunquadrat-Raster nur einmal vorkommen darf. Wie kann also die Person, die dieses Rätsel löst, dem Herausforderer beweisen, dass das Sudoku eine Lösung hat, ohne die Antwort preiszugeben?

Sie müssen nur das Feld mit der Antwort abdecken und dann den Herausforderer nach dem Zufallsprinzip bitten, ein paar Zeilen oder Spalten auszuwählen, alle Zahlen zu mischen und zu überprüfen, ob sie alle eins bis neun sind. Dies ist eine einfache, wissensfreie Ausführungsform.

Die Zero-Knowledge-Proof-Technologie weist drei Merkmale auf: Vollständigkeit, Korrektheit und Zero-Knowledge, das heißt, sie beweist die Schlussfolgerung, ohne irgendwelche Details preiszugeben. Die Quelle seiner Technologie kann die Einfachheit widerspiegeln: Im Kontext der homomorphen Verschlüsselung ist die Schwierigkeit der Verifizierung weitaus geringer als die Schwierigkeit, Beweise zu generieren.

Unter maschinellem Lernen versteht man die Verwendung von Algorithmen und Modellen, die es Computersystemen ermöglichen, aus Daten zu lernen und sich zu verbessern. Das Lernen aus Erfahrung durch Automatisierung ermöglicht es dem System, Aufgaben wie Vorhersage, Klassifizierung, Clustering und Optimierung auf der Grundlage von Daten und Modellen automatisch auszuführen.

Im Kern geht es beim maschinellen Lernen darum, Modelle zu erstellen, die aus Daten lernen und automatisch Vorhersagen und Entscheidungen treffen. Die Konstruktion dieser Modelle erfordert normalerweise drei Schlüsselelemente: Datensätze, Algorithmen und Modellbewertung. Datensätze bilden die Grundlage des maschinellen Lernens und enthalten Datenbeispiele, die zum Trainieren und Testen von Modellen für maschinelles Lernen verwendet werden. Algorithmen sind das Herzstück von Modellen für maschinelles Lernen und definieren, wie das Modell aus Daten lernt und Vorhersagen trifft. Die Modellevaluierung ist ein wichtiger Teil des maschinellen Lernens, der dazu dient, die Leistung und Genauigkeit des Modells zu bewerten und zu entscheiden, ob das Modell optimiert und verbessert werden muss.

Beim traditionellen maschinellen Lernen müssen Datensätze für Schulungen normalerweise an einem zentralen Ort gesammelt werden, was bedeutet, dass Dateneigentümer die Daten mit Dritten teilen müssen, was zu einem Risiko von Datenlecks oder Datenschutzverlusten führen kann. Mit ZKML können Dateneigentümer Datensätze mit anderen teilen, ohne die Daten preiszugeben, was durch die Verwendung von Zero-Knowledge-Proofs erreicht wird.

Wenn Zero-Knowledge-Proof zur Stärkung des maschinellen Lernens angewendet wird, sollte der Effekt vorhersehbar sein, was die seit langem geplagten Datenschutz-Blackbox- und Datenmonopolprobleme löst: ob die Projektpartei sie nutzen kann, ohne die Benutzerdateneingabe oder das Spezifische preiszugeben Details des Modells? Ist es nach Abschluss des Nachweises und der Verifizierung möglich, dass jede Sammlung ihre eigenen Daten oder Modelle weitergibt, um zu funktionieren, ohne private Daten preiszugeben? Natürlich ist die aktuelle Technologie noch am Anfang und es wird in der Praxis sicherlich viele Probleme geben. Dies behindert unsere Vorstellungskraft nicht und viele Teams entwickeln sich bereits weiter.

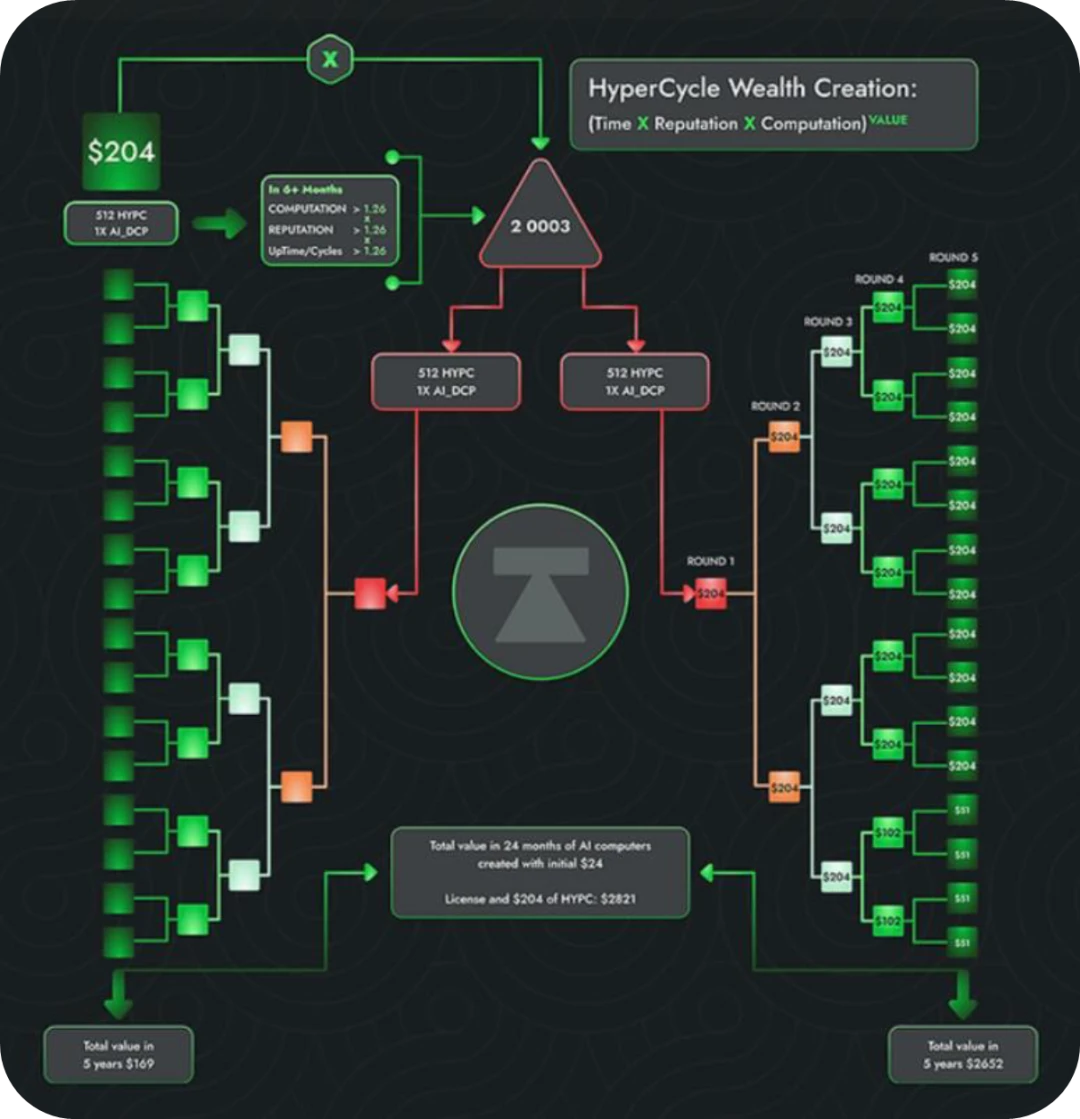

Wird diese Situation zu einer kostenlosen Prostitution kleiner Datenbanken durch große Datenbanken führen? Wenn Sie über Governance nachdenken, kehren Sie zu unserem Web-3-Denken zurück, und die Essenz von Crypto ist Governance. Ob durch eine große Anzahl an Bewerbungen oder durch Teilen, Sie sollten die Anreize erhalten, die Sie verdienen. Ob durch den ursprünglichen Pow-, PoS-Mechanismus oder die neuesten verschiedenen PoR-Mechanismen (Reputation Proof Mechanism), sie alle bieten Garantien für den Anreizeffekt.

Verteilte Rechenleistung: eine innovative Erzählung, die mit Lügen und Realität verflochten ist

Ein dezentrales Rechenleistungsnetzwerk war schon immer ein heiß diskutiertes Szenario im Verschlüsselungskreis. Schließlich erfordern große KI-Modelle eine erstaunliche Rechenleistung, und ein zentralisiertes Rechenleistungsnetzwerk wird nicht nur Ressourcenverschwendung verursachen, sondern auch ein erhebliches Monopol bilden – im Vergleich dazu Am Ende ist die Anzahl der GPUs das Letzte, was zu bekämpfen ist, was zu langweilig ist.

Der Kern eines dezentralen Rechenleistungsnetzwerks besteht darin, an verschiedenen Standorten und auf verschiedenen Geräten verstreute Rechenressourcen zu integrieren. Als Hauptvorteile werden häufig genannt: Bereitstellung verteilter Rechenfunktionen, Lösung von Datenschutzproblemen, Verbesserung der Glaubwürdigkeit und Zuverlässigkeit von Modellen der künstlichen Intelligenz, Unterstützung einer schnellen Bereitstellung und eines schnellen Betriebs in verschiedenen Anwendungsszenarien sowie Bereitstellung dezentraler Datenspeicher- und -verwaltungsschemata. Richtig, durch dezentrale Rechenleistung kann jeder KI-Modelle ausführen und sie an echten On-Chain-Datensätzen von Benutzern auf der ganzen Welt testen, sodass sie flexiblere, effizientere und kostengünstigere Rechendienste nutzen können.

Gleichzeitig kann die dezentrale Rechenleistung Datenschutzprobleme lösen, indem sie einen starken Rahmen zum Schutz der Sicherheit und Privatsphäre der Benutzerdaten schafft. Es bietet außerdem einen transparenten und überprüfbaren Rechenprozess, erhöht die Glaubwürdigkeit und Zuverlässigkeit von Modellen der künstlichen Intelligenz und stellt flexible und skalierbare Rechenressourcen für eine schnelle Bereitstellung und einen schnellen Betrieb in verschiedenen Anwendungsszenarien bereit.

Wir betrachten das Modelltraining aus einem vollständigen zentralisierten Rechenprozess. Die Schritte sind normalerweise unterteilt in: Datenvorbereitung, Datensegmentierung, Datenübertragung zwischen Geräten, paralleles Training, Gradientenaggregation, Parameteraktualisierung, Synchronisierung und wiederholtes Training. Selbst wenn der zentrale Computerraum Hochleistungs-Rechengerätecluster nutzt und Rechenaufgaben über Hochgeschwindigkeitsnetzwerkverbindungen teilt, sind in diesem Prozess die hohen Kommunikationskosten zu einer der größten Einschränkungen des dezentralen Rechenleistungsnetzwerks geworden.

Obwohl das dezentrale Rechenleistungsnetzwerk viele Vorteile und Potenziale bietet, ist der Entwicklungspfad daher je nach aktuellen Kommunikationskosten und tatsächlichen Betriebsschwierigkeiten immer noch mühsam. In der Praxis erfordert die Realisierung eines dezentralen Rechenleistungsnetzwerks die Überwindung vieler praktischer technischer Probleme, sei es die Gewährleistung der Zuverlässigkeit und Sicherheit von Knoten, die effektive Verwaltung und Planung verteilter Rechenressourcen oder die Erzielung einer effizienten Datenübertragung und Kommunikation usw ., ich befürchte, dass es tatsächlich große Probleme sind.

Tail: Erwartungen an Idealisten

Zurück zur aktuellen kommerziellen Realität: Das Narrativ der tiefen Integration von KI und Web 3 sieht so schön aus, aber Kapital und Benutzer sagen uns durch praktische Maßnahmen mehr darüber, dass dies eine äußerst schwierige Reise der Innovation sein wird, es sei denn, das Projekt kann es sein Wie OpenAI Ebenso sollten wir einen starken finanziellen Unterstützer begrüßen, solange wir stark sind, sonst werden uns die grenzenlosen Forschungs- und Entwicklungskosten und das unklare Geschäftsmodell völlig zerstören.

Sowohl KI als auch Web 3 befinden sich derzeit in einem sehr frühen Entwicklungsstadium, genau wie die Internetblase Ende des letzten Jahrhunderts, und erst fast ein Jahrzehnt später wurde das wahre goldene Zeitalter offiziell eingeläutet. McCarthy träumte davon, in einem einzigen Urlaub eine künstliche Intelligenz mit menschlicher Intelligenz zu entwickeln, aber erst fast siebzig Jahre später wagten wir den entscheidenden Schritt in Richtung künstlicher Intelligenz.

Das Gleiche gilt für Web 3+AI, wir haben die richtige Richtung festgelegt und der Rest wird der Zeit überlassen.

**Wenn die Zeit vergeht, sind diese stehenden Menschen und Dinge der Grundstein für unseren Übergang von der Science-Fiction zur Realität. **