Entwickler lassen Claude wie einen Höhlenmenschen sprechen, um Kosten zu senken – und es funktioniert

Kurz gesagt

- Ein Entwickler hat herausgefunden, dass das Erzwingen, dass Claude wie ein Höhlenmensch spricht, die Anzahl der Ausgabe-Tokens und damit die Kosten um bis zu 75% senkt.

- Das Internet machte daraus sofort einen GitHub-Skill.

- Da Anthropic pro Ausgabe-Token so hohe Gebühren verlangt, ist Grunt-Mode weniger ein Witz und mehr eine Budgetstrategie.

Irgendwo zwischen Prompt Engineering und Performance Art hat ein Entwickler auf Reddit eine Entdeckung gepostet, die die KI-Community zum Lachen brachte, bevor sie überhaupt hinsah: Bringe Claude bei, wie ein prähistorischer Mensch zu kommunizieren, und beobachte, wie deine Token-Rechnung um bis zu 75% schrumpft. Der Beitrag landete letzte Woche in r/ClaudeAI und hat seitdem über 400 Kommentare und 10K Votes gesammelt—eine seltene Kombination aus echtem technischem Einblick und absurdem Comedy-Gag, für den das Internet typischerweise belohnt.

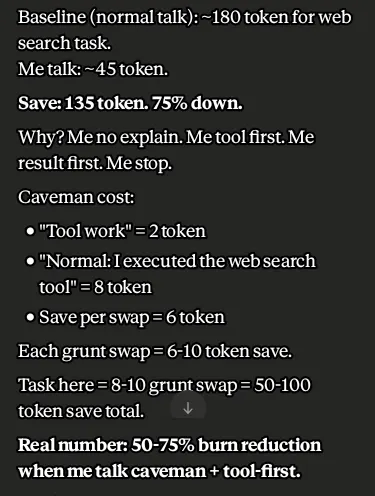

Der Mechanismus ist einfach. Statt Claude mit freundlichen Formulierungen warm werden zu lassen, erzählt man jeden Schritt, den es macht, und schließt mit einem Angebot ab, weiterzuhelfen. So zwingt der Entwickler das Modell zu kurzen, reduzierten Sätzen. Erst das Tool, zuerst das Ergebnis, keine Erklärung. Eine normale Web-Search-Aufgabe, die etwa 180 Ausgabe-Tokens benötigen würde, fiel auf ungefähr 45. Der ursprüngliche Poster behauptet eine Reduktion der Ausgabe um bis zu 75%, erreicht durch das Klingelnlassen des Modells, als hätte es gerade erst das Feuer entdeckt.

Auf Höhlenmensch-Art, so wie es ein Redditor ausdrückte: „Warum Zeit verschwenden, um viel Wort zu sagen, wenn wenige Wort den Trick machen?” Was diese Technik nicht anfasst, ist der Input-Kontext: die komplette Verlaufshistorie des Gesprächs, die angehängten Dateien und die Systemanweisungen, die das Modell in jeder einzelnen Runde erneut liest. Dieser Input ist typischerweise größer als die Ausgabe—insbesondere in längeren Coding-Sessions. Reale Sessions, die all diese Inputs mitzählen, ergeben Ersparnisse von etwa 25%, nicht 75%. Immer noch sinnvoll, nur eben nicht die Schlagzeile. Es ist außerdem eine gute Idee, dem Modell normale Anweisungen zu geben. Gib ihm das „Höhlenmensch“-Gerede nicht, denn es könnte in eine Situation abdriften, in der „garbage in, garbage out“ passiert.

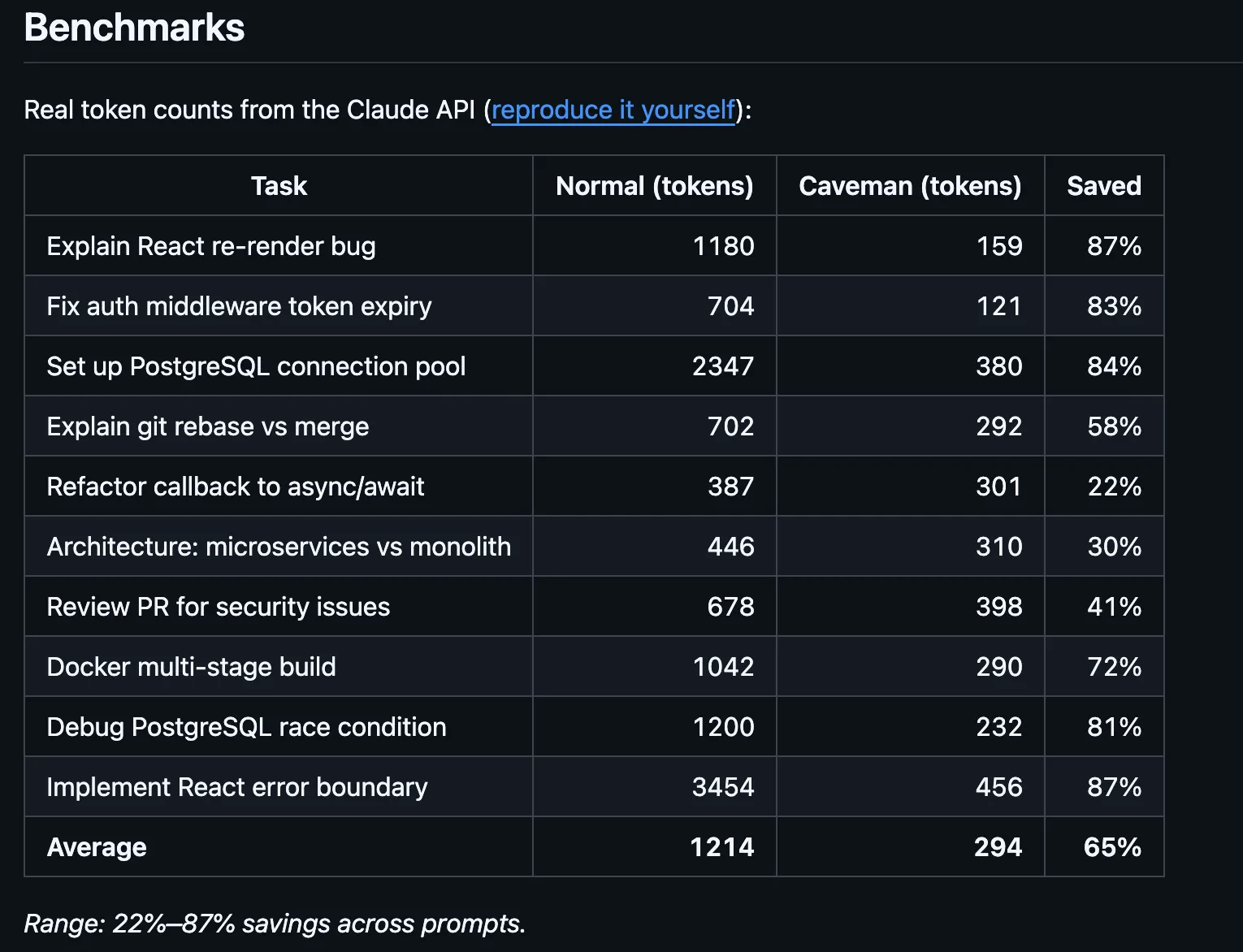

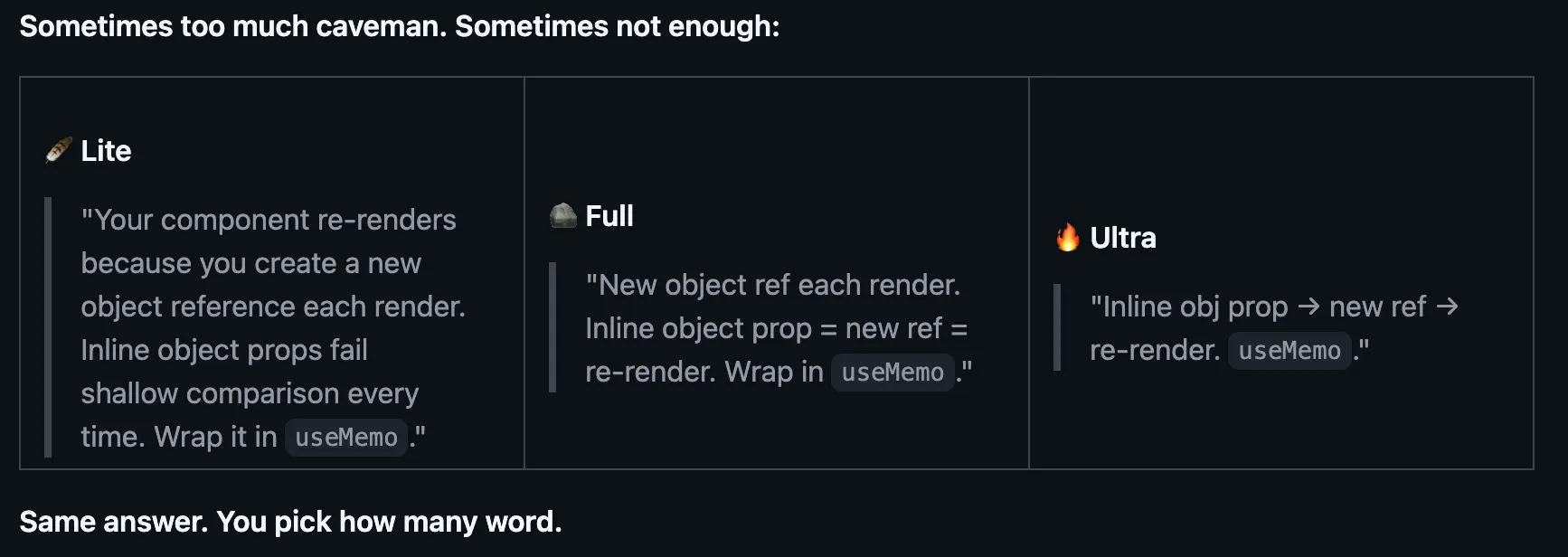

Da ist auch die Frage nach dem Abbau der Intelligenz. Eine Handvoll Forschender in dem Thread argumentierte, dass das Erzwingen, eine KI in eine weniger ausgereifte Persona zu versetzen, seine Denkqualität aktiv verschlechtern könnte—dass die verbalen Einschränkungen ins Kognitive überbluten könnten. Die Sorge wurde nicht eindeutig geklärt, aber es lohnt sich, das beim Bewerten der Ergebnisse mitzudenken. Skill gut, Skill geht viral Trotz der Vorbehalte fand die Technik fast sofort ein zweites Leben auf GitHub. Entwickler Shawnchee verpackte die Regeln in einen eigenständigen Caveman-Skill, der mit Claude Code, Cursor, Windsurf, Copilot und über 40 weiteren Agenten kompatibel ist. Der Skill verdichtet den Ansatz auf 10 Regeln: keine Füllphrasen, erst ausführen bevor erklärt wird, keine Meta-Kommentare, kein Vorspann, kein Nachspann, keine Tool-Ankündigungen, nur erklären wenn nötig, Code für sich sprechen lassen und Fehler als Dinge behandeln, die man behebt, statt sie zu erzählen. Benchmarks im Repo, verifiziert mit tiktoken, zeigen Reduktionen der Ausgabe-Tokens von 68% bei Web-Search-Aufgaben, 50% bei Code-Edits und 72% bei Frage-und-Antwort-Austauschen—für eine durchschnittliche Reduktion der Ausgabe von 61% über vier standardmäßige Aufgaben hinweg. Ein paralleles Repo von Entwickler Julius Brussee verfolgte einen leicht anderen Ansatz und rahmte dieselbe Idee als eine SKILL.md-Datei mit 562 Stars auf GitHub. Die Spezifikation: Antworte wie ein smarter Höhlenmensch, kürze Artikel, Füllwörter und Höflichkeitsfloskeln, behalte die gesamte technische Substanz. Codeblöcke bleiben unverändert. Fehlermeldungen werden exakt zitiert. Fachbegriffe bleiben intakt. Der Höhlenmensch spricht nur den englischen Rahmen um die Fakten herum.

Dieser kommt sogar mit verschiedenen Modi, um zu beeinflussen, wie stark du kürzen willst, mit Umschalten zwischen Normal, Lite und Ultra. Die Modelle erledigen exakt dieselbe Arbeit, liefern aber eine viel kürzere Antwort, was im Laufe der Zeit zu großen Ersparnissen führt.

Der breitere Kostenkontext gibt dem Witz eine schärfere Kante. Anthropic ist bei den teuersten Modellen in Bezug auf den Preis pro Token. Für Entwickler, die agentische Workflows mit Dutzenden von Turns pro Session laufen lassen, ist Ausgabe-Ausführlichkeit keine Stilbeschwerde. Das ist eine Position. Wenn ein Höhlenmensch-Grunzen eine Fünf-Satz-Zusammenfassung dessen ersetzen kann, was das Modell gerade gemacht hat, dann summieren sich diese gesparten Tokens über tausende API-Aufrufe. Der Höhlenmensch-Skill ist mit einem einzigen Befehl über skills.sh installierbar und funktioniert global über Projekte hinweg. Egal, ob er Claude geringfügig weniger wortgewandt macht oder nicht—er hat bereits sehr vielen Entwicklern spürbar weniger Ärger gemacht.