Warum steigen die GPU-Preise außer Kontrolle?

Original-Titel: Die große GPU-Knappheit – Mietkapazität – Veröffentlichung unseres H100 1-Jahres-Mietpreisindex

Original-Autor: Daniel Nishball, Jordan Nanos, Cheang Kang Wen u. a.

Übersetzung: Peggy, BlockBeats

Redaktionshinweis: Da KI sich von „Werkzeug“ hin zur „Basisinfrastruktur für Workflows“ bewegt, gerät der GPU-Mietpreis in einen beschleunigten Aufwärtstrend, während sich das Angebot fortlaufend weiter verengt.

Von einem Anstieg der einjährigen H100-Preise um fast 40 % über die vorzeitige Verankerung der Rechenleistung bis in die zweite Jahreshälfte 2026 bis hin dazu, dass KI-Labore die Versorgung durch langfristige Verträge und Verlängerungsmechanismen kontinuierlich fest in die Hand nehmen: Die Marktlogik für GPUs hat sich deutlich verändert. Preise werden nicht mehr in erster Linie durch die Hardwarekosten bestimmt, sondern gemeinsam durch den Token-Verbrauch, Modellfähigkeit und Produktionseffizienz geformt.

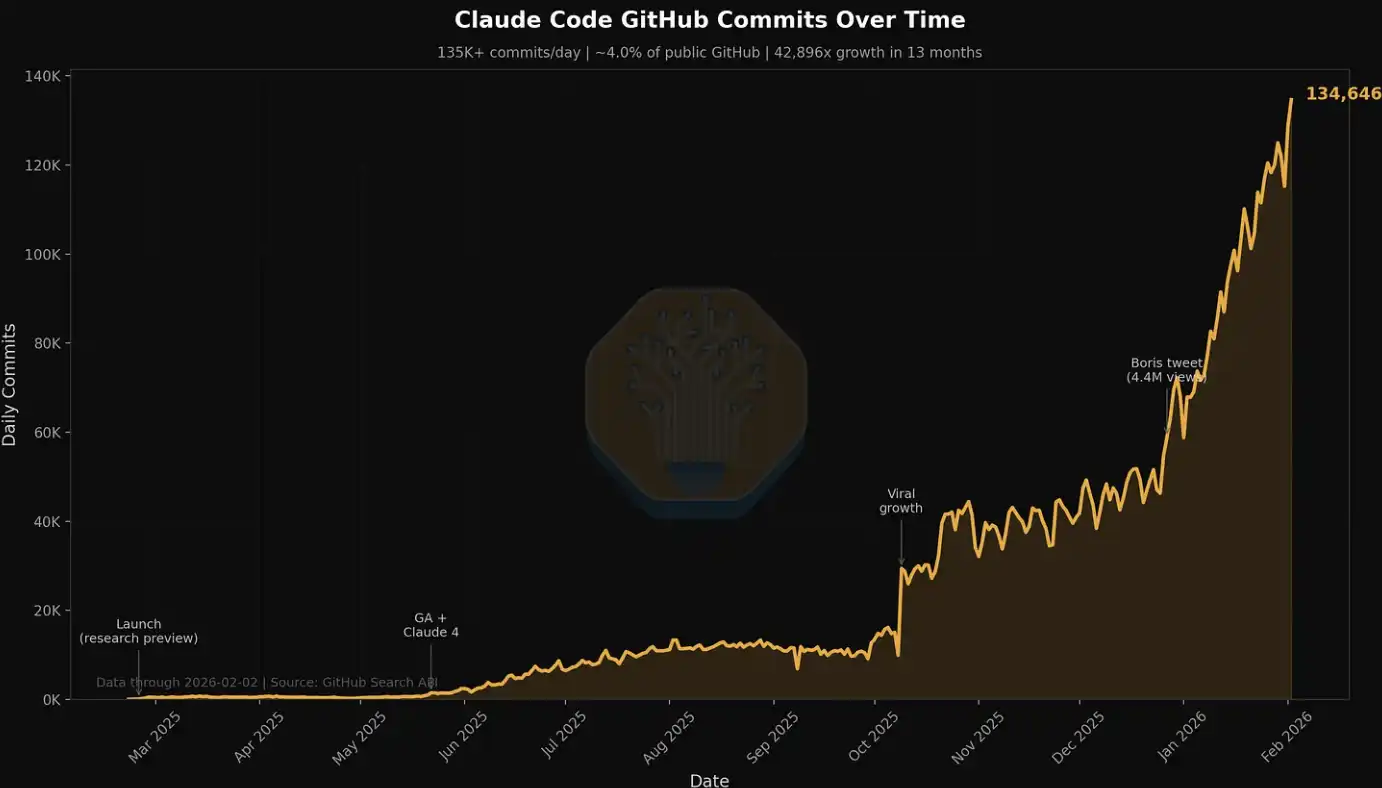

Besonders entscheidend sind die Veränderungen auf der Nachfrageseite. Neue Paradigmen wie Multi-Agent-Systeme, native Content-Generierung und KI-Programmierwerkzeuge treiben die Token-Nutzung in einen Bereich exponentiellen Wachstums. Die Kernannahme des Reports wird ebenfalls zunehmend klar: Die Investitionsrendite von KI-Tools wurde bereits bestätigt; die 5–10-fache Rückkehr sorgt dafür, dass die Rechenleistungspreise über eine beträchtliche Zeit hinweg nur schwer eine wirksame Bremse für die Nachfrage bilden können.

Die daraus entstehende Spannung wird immer deutlicher: Der reale Markt für Rechenleistung ist geprägt von weitgehender Knappheit und einer Verschiebung der Preissetzungsmacht nach oben, während der Kapitalmarkt noch bei der Erwartung „wird letztlich überreichlich und zur Ware“ verweilt. Diese Fehlanpassung zwischen Erwartung und Realität formt die Bewertungslogik im Bereich der KI-Infrastruktur neu.

Wenn Rechenleistung zur neuen Produktionsressource wird, befinden sich ihre Preismechanismen, die Angebotsstruktur und die Kapitalrendite in einer Phase tiefgreifender Umgestaltung.

Im Folgenden der Originaltext:

Der Bedarf an Anthropic’s Claude 4.6 Opus und Claude Code ist stark in die Höhe geschossen. Der jährliche wiederkehrende Umsatz (ARR) stieg innerhalb eines einzigen Quartals von Ende letzten Jahres, von 9 Milliarden US-Dollar, auf aktuell mehr als 25 Milliarden US-Dollar – nahezu eine Verdreifachung. Gleichzeitig treiben Open-Source-Modelle, die unter anderem von GLM und Kimi K2.5 vertreten werden, die schnelle Ausweitung von Anwendungsszenarien rund um Open-Source-Modelle voran. Kontinuierliche Finanzierungsrunden für Unternehmen – darunter Anthropic, OpenAI und mehrere Neolabs – verstärken ebenfalls die Nachfrage nach GPU-Ressourcen.

Dieser Wendepunkt bedeutet: Die Nachfrage steigt innerhalb kurzer Zeit sprunghaft an, und bei den extrem großen Cloud-Anbietern (hyperscalers) sowie bei aufkommenden Cloud-Dienstleistern (Neoclouds) ist bereits eine GPU-Raubzug-Welle (GPU-Shopping) entstanden.

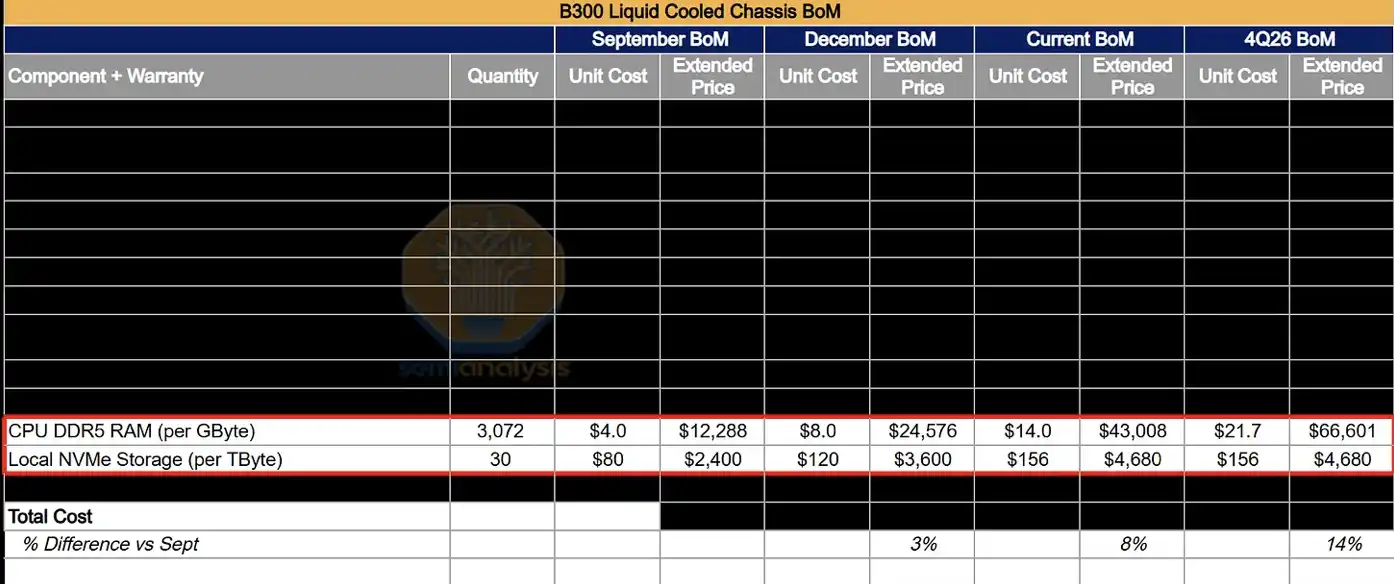

Diese neu hinzugekommene Nachfrage treibt die Preise entlang der gesamten Lieferkette nach oben – von DRAM- und NAND-Speicher über Glasfaser-Kabel, Rechenzentrums-Hosting bis hin zu Infrastruktur wie Gasturbinen. Nahezu alle zugehörigen Produkte und Dienstleistungen sind dabei im Preis gestiegen.

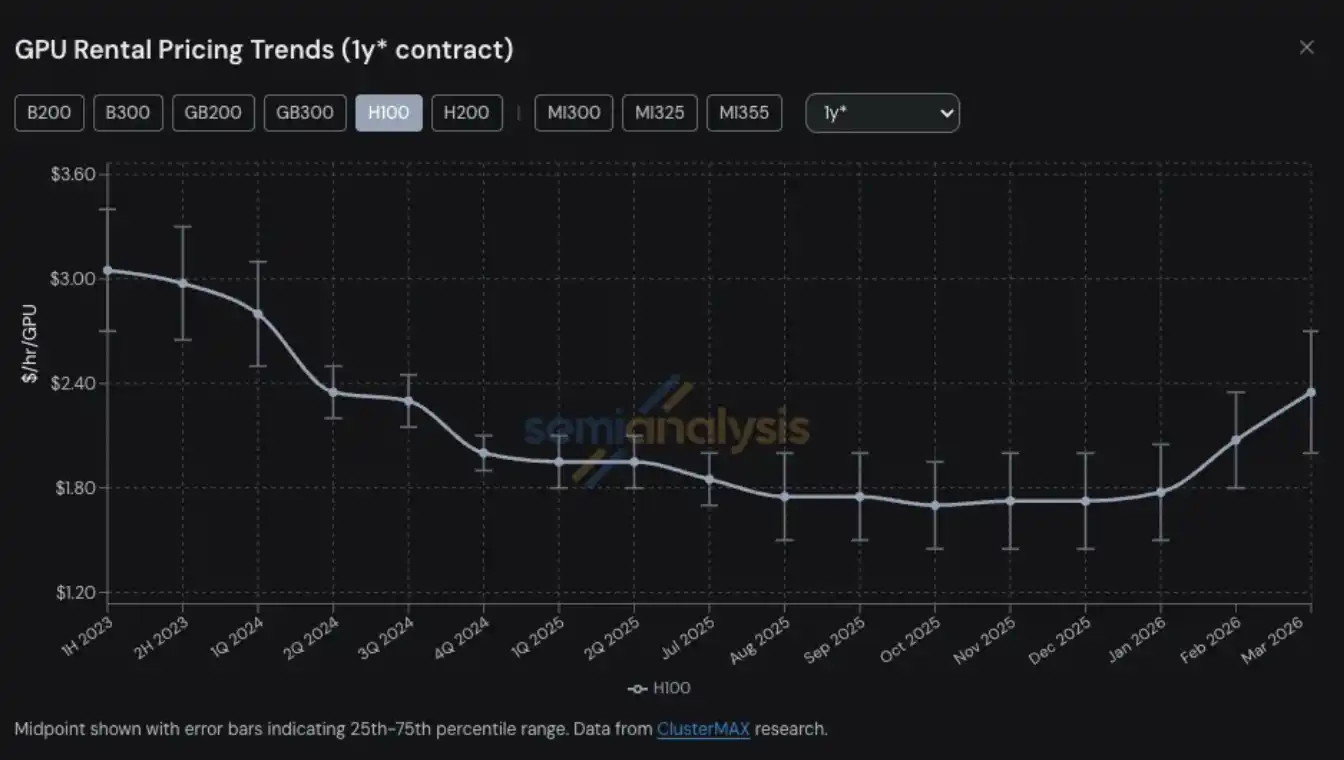

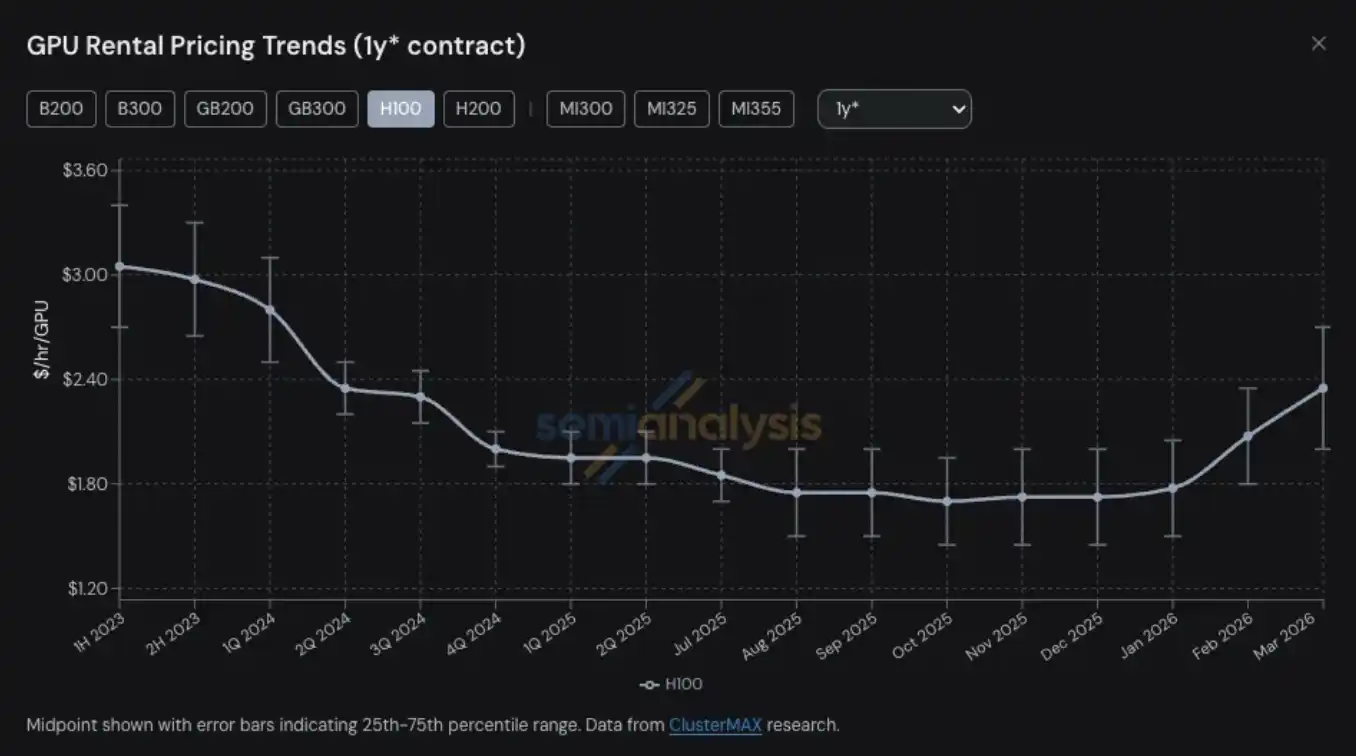

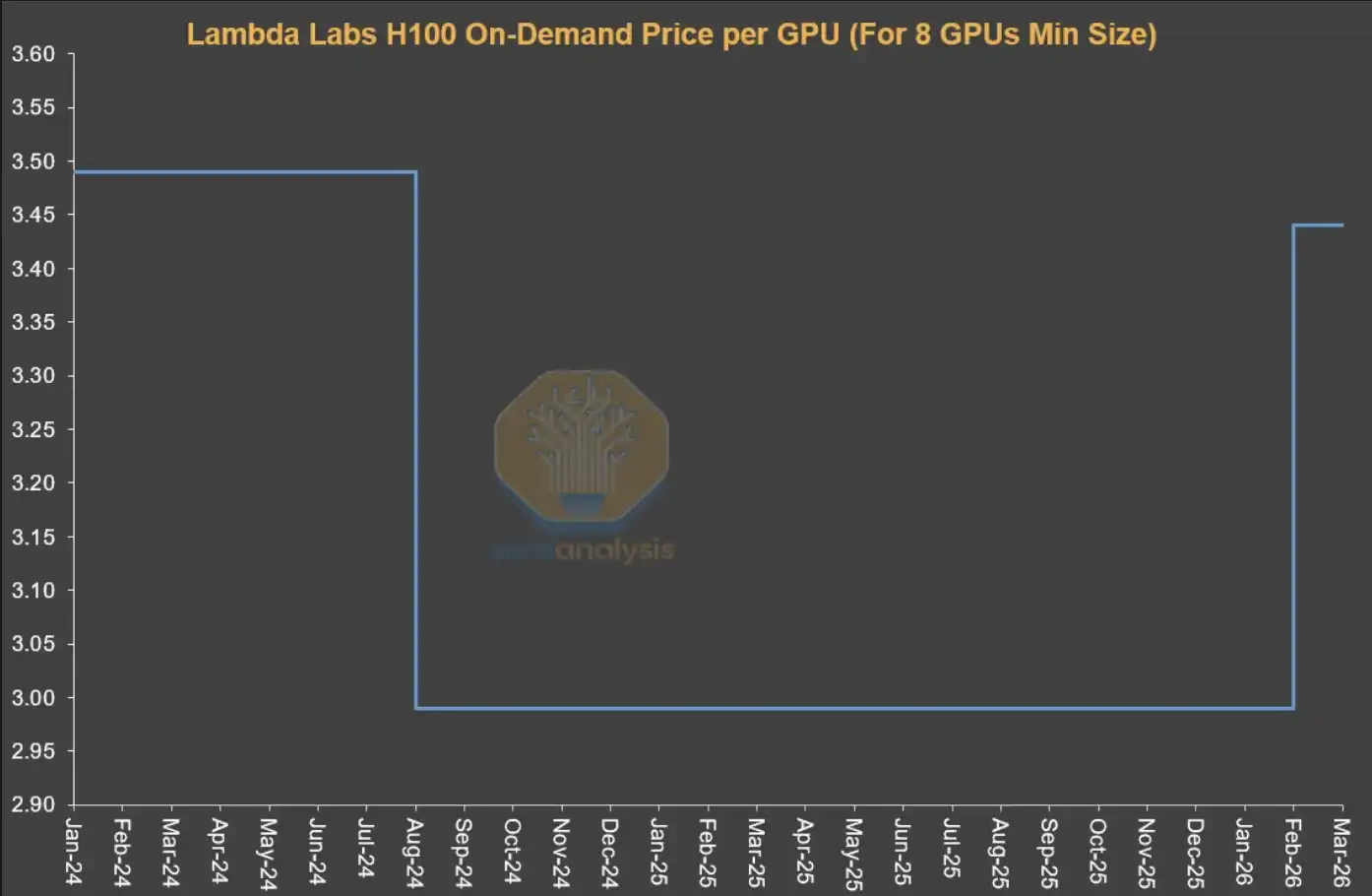

GPU-Mietpreise sind zu einem der vielen Produkte und Dienstleistungen rund um Rechenleistung geworden, in dem als erstes ein Versorgungsengpass auftritt und die Preise deutlich springen. Der Preis für einen einjährigen H100-GPU-Mietvertrag stieg von einem Tiefpunkt im Oktober 2025 von 1,70 US-Dollar pro GPU und Stunde auf 2,35 US-Dollar im März 2026 – ein Anstieg von knapp 40 %.

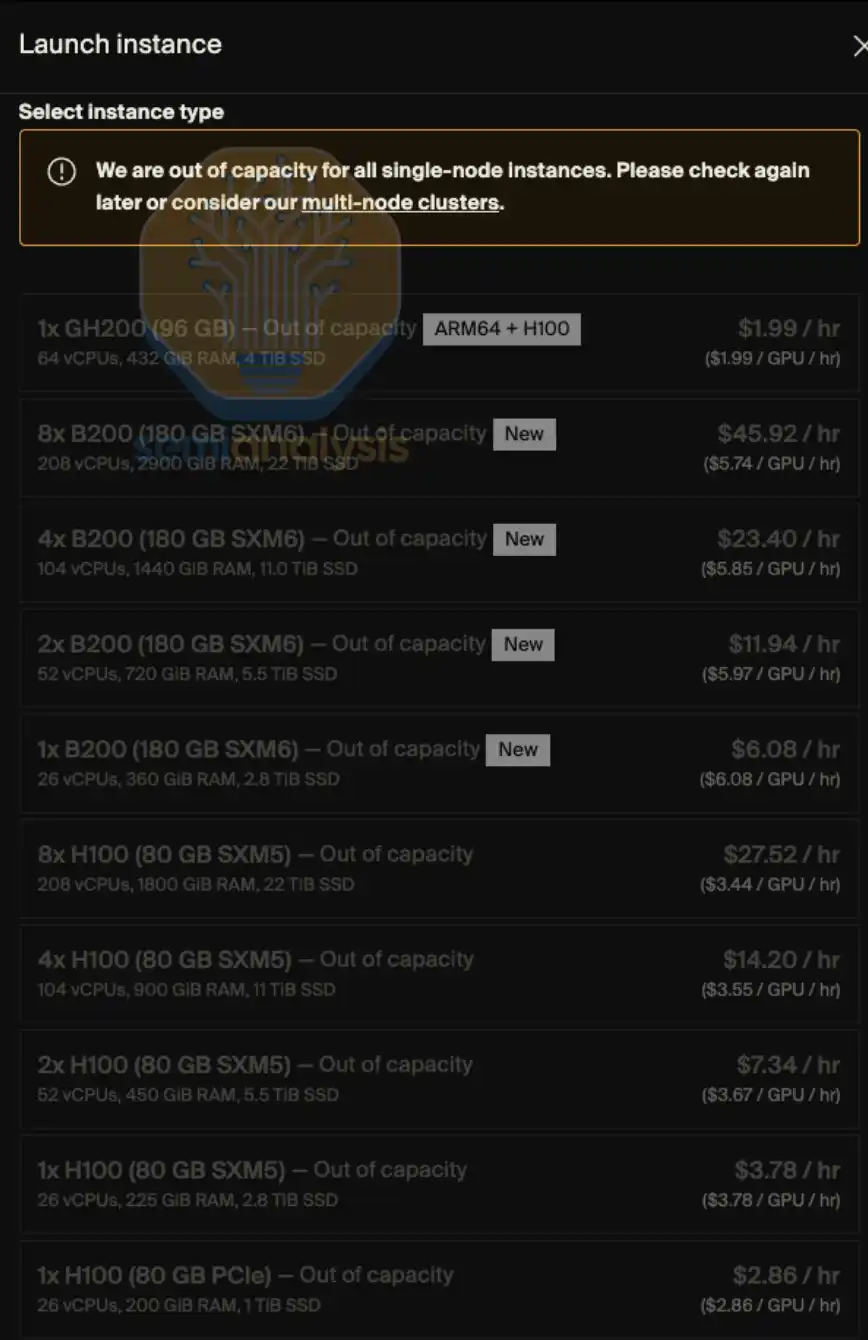

Die nachfrageabhängige (on-demand) GPU-Mietkapazität ist in praktisch allen Modellen nahezu vollständig ausverkauft – Nutzer, die bereits on-demand-Instanzen gesichert haben, geben die Rechenleistung auch nach den Preiserhöhungen nicht wieder an den Markt zurück. Anfang 2026 ist die Schwierigkeit, GPU-Rechenleistung zu finden, fast so hoch wie beim Versuch, noch „den letzten Flug“ zu bekommen: hohe Preise, fast keine Tickets. Wenn man es noch treffender formuliert: Anstatt Tickets zu jagen, ist es eher, als würde man „über Kanäle Medikamente einkaufen“.

Bei SemiAnalysis verfolgen wir seit langem tiefgehend verschiedene Trends und zentrale Themen im Ökosystem der Neoclouds und der hyperskaligen Cloud-Anbieter – dazu gehören auch GPU-Mietpreise. Diese Fähigkeit speist sich aus unserer kontinuierlichen Forschung und Praxis in Projekten wie ClusterMAX, InferenceX und AI Cloud Total Cost of Ownership (TCO).

Gleichzeitig haben wir erheblich an Energie investiert, um verschiedene KI-Labore bei der Anbindung an Neocloud-Dienstleister zu unterstützen, um am Markt GPU-Mietressourcen zu finden, und um mit praktisch allen Beteiligten im Ökosystem fortlaufend über die Entwicklung der GPU-Mietpreise zu kommunizieren.

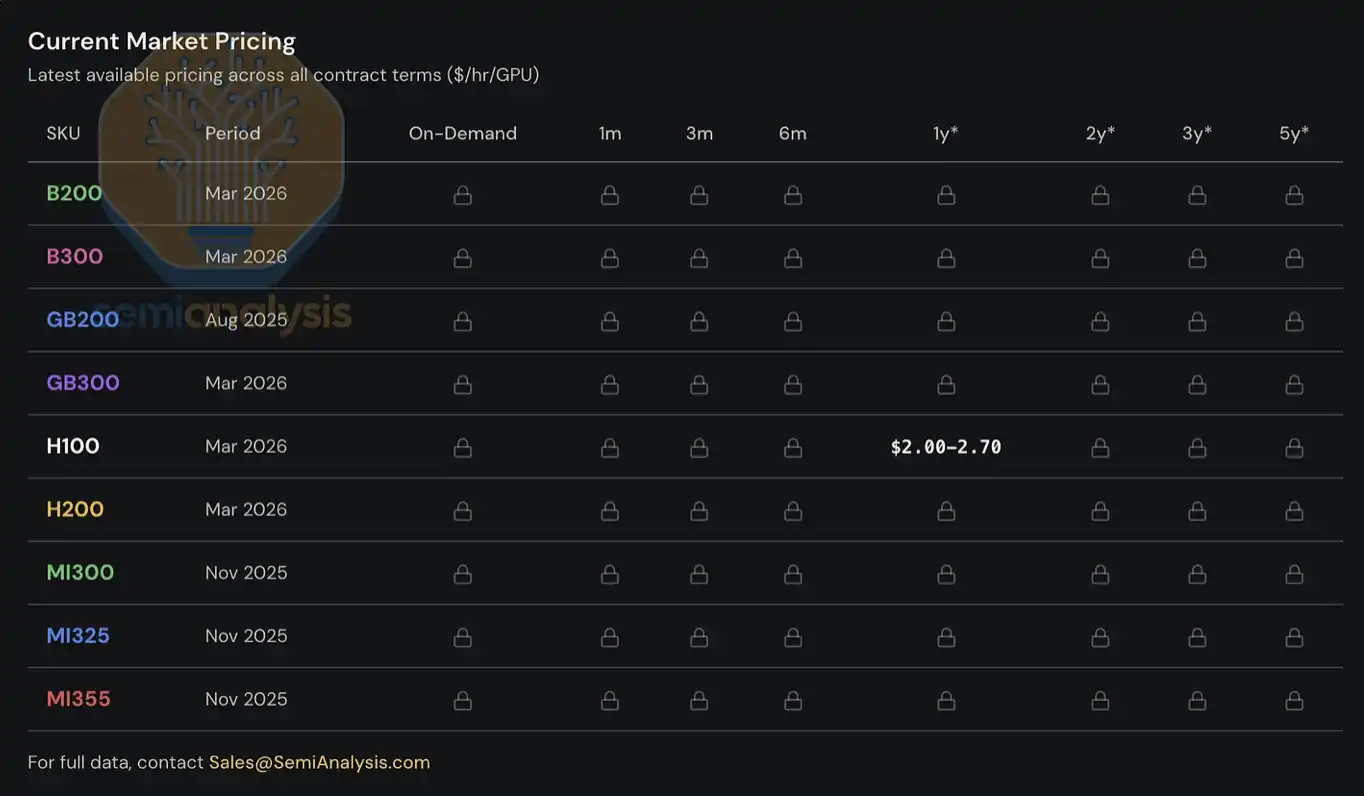

Seit 2023 haben wir für Kunden ein System zur Erstellung und Pflege eines GPU-Mietpreisindex aufgebaut, das gängige GPU-Modelle (wie H100, H200, B200, B300, GB200, GB300, MI300, MI325, MI355) abdeckt und zudem über unterschiedliche Mietlaufzeiten hinweg reicht – von on-demand über 1 Monat Kurzzeitmiete bis hin zu langfristigen Verträgen mit maximal 5 Jahren. Dieser Index basiert auf Umfragedaten mehrerer Neocloud-Dienstleister sowie von Käufern von Rechenleistung und wird zusätzlich über reale Transaktionsdaten sowie durch Querverifikation mit Verhandlungen und Abschlüssen, an denen wir im Rahmen des Matchings beteiligt waren, validiert.

Heute stellen wir den H100-1-Jahres-GPU-Mietpreisindex der Öffentlichkeit bereit, in der Hoffnung, der Branche mehr Daten und Einblicke zu geben. Der Index wird monatlich aktualisiert, und wir veröffentlichen laufend aktuelle Trendinterpretationen und Marktbeobachtungen über X und LinkedIn. Was die vollständigen Preisdaten zur Abdeckung unterschiedlicher Mietlaufzeitstrukturen sowie anderer gängiger GPU-Modelle betrifft: Derzeit sind diese nur für institutionelle Nutzer zugänglich, die unser AI-Cloud-TCO-Modell abonnieren.

Dieser Report wird sich auf die neuesten Trends im GPU-Mietmarkt, Beobachtungen aus der Marktpraxis sowie wichtige Daten konzentrieren, erläutern, wie wir die gesamte Marktstruktur verstehen, und eine erste Einschätzung zur zukünftigen Entwicklung der Mietpreise liefern.

GPU-Mietmarkt tritt in die Phase „dynamischer Preisgestaltung“ ein

Allein anhand der H100-1-Jahres-Mietpreiskurve lässt sich die Anspannung des Marktes noch nicht vollständig darstellen – unsere eigenen praktischen Erfahrungen beim Beschaffen von Rechenleistung vor Ort sowie die Rückmeldungen von Marktteilnehmern zeigen deutlich härtere Verhältnisse.

Die aktuelle Nachfrage kommt aus mehreren stark unterschiedlichen Nutzungsszenarien; eine „universelle Lösung“ existiert praktisch nicht. Beispielsweise sind im Inferenz-Teil großskalige Mixture-of-Experts-Modelle (MoE) besser geeignet, um auf neuesten groß angelegten Systemen wie GB300 NVL72 zu laufen; im Trainingsteil hat H100 in puncto Preis-Leistungs-Verhältnis weiterhin Vorteile, sodass selbst „relativ ältere“ GPUs in einer weiterhin hohen Nachfrage verbleiben.

Mittlerweile zahlen Kunden sogar in Wettbewerb um die Zahlung von 14 US-Dollar pro GPU und Stunde für die AWS-p6-b200 Spot-Instanzen, um sich Einsätze zu sichern. Einige führende Neocloud-Dienstleister verkaufen keine einzelnen Nodes mehr; einige Verlängerungspreise für H100-Verträge sind sogar vollständig identisch mit denen, die vor zwei bis drei Jahren bei Vertragsabschluss vereinbart wurden. Und manche H100-Verträge wurden bereits direkt bis 2028 verlängert – mit einer Laufzeit von bis zu 4 Jahren. Wenn man jetzt auch nur versucht, einen H100- oder H200-Cluster mit acht Nodes (64 GPUs) zu finden, ist das nicht einfach – von den Dienstleistern, die wir kontaktiert haben, waren bereits die Hälfte vollständig ausverkauft; die meisten Antworten lauteten: Es gibt in naher Zukunft schlicht keine Hopper-Architektur-GPUs, deren Verträge auslaufen und die freigegeben werden.

Wir haben sogar gehört, dass einige Mieter von Rechenleistung damit begonnen haben, ihre gemieteten Cluster erneut zu zerlegen und weiterzuvermieten – so, als würde man während des Monaco-Grand-Prix Wohnungen in Kurzzeitmieten auftrennen. Ob als Nächstes sogenannte „Neocloud-Zwischenvermieter“ entstehen, ist wahrscheinlich nicht mehr nur ein Witz.

Auch die Blackwell-Lieferung ist extrem angespannt. Wir haben erfahren, dass sich aufgrund einer starken Nachfrage nach Open-Source-Weight-Modellen sowie eines anhaltenden explosionsartigen Ausbaus der Inferenznachfrage die Bereitstellungs- und Lieferzyklen der nächsten Blackwell-Cluster inzwischen auf Juni bis Juli verlängert haben. Zudem sind die meisten dieser demnächst startenden Cluster bereits vorab gesichert. Tatsächlich gilt für den gesamten Markt: Bis 2026 August bis September neu hinzukommende Kapazitäten sind nahezu vollständig vorreserviert.

GPU-Mietpreise: Rückkehr des Bullenlaufes (Kursanstieg in „Wiederauferstehung“)

Warum ist der Markt an diesen Punkt gelangt? Noch vor 6 Monaten äußerten die meisten Marktbeobachter Zweifel am „Endwert“ der GPUs und gingen allgemein davon aus, dass die GPU-Mietpreise im Zeitverlauf unvermeidlich weiter fallen würden. Zu jener Zeit hätte man, wenn Neocloud- oder hyperskalige Cloud-Anbieter in ihren Finanzmodellen einen Abschreibungszyklus von 6 Jahren zur Behandlung von GPU-Assets verwenden, sogar Kritik von Finanzanalysten ernten müssen. Bevor wir über zukünftige Trends sprechen, werfen wir zuerst kurz einen Blick darauf, wie sich die Dinge in diese Lage entwickelt haben.

Vor der zweiten Hälfte des Jahres 2025 lautete die vorherrschende Erwartung im gesamten Ökosystem: Mit dem großflächigen Rollout von Blackwell und dessen deutlich niedrigeren Kosten pro Rechenleistung wird die Mietpreisgestaltung für Hopper (also H100 und H200) deutlich zurückgehen. Tatsächlich aber ist es genau umgekehrt. In der zweiten Hälfte 2025 schwächte sich die Nachfrage nach H100 nicht nur nicht ab, sondern verstärkte sich in vielen Szenarien weiter. Die schnelle Verbreitung von Open-Source-Weight-Modellen sowie die anhaltende Beschleunigung der damaligen Inferenznachfrage waren die frühesten Signale für diese fast endlose Welle der Rechenleistungsnachfrage.

Im Januar 2026 erreichte der Rechenleistungsmarkt den nächsten Wendepunkt: Nach mehreren Quartalen schnellen Anstiegs bei den Preisen für DRAM und NAND begann die Preisentwicklung in eine nahezu „parabelartige“ Hochphase überzugehen. Nach unseren Speicher-Modellen lagen die jährlichen Zuwachsraten der Vertrags-/Kontraktpreise für LPDDR5 und DDR5 im ersten Quartal 2026 jeweils bei annähernd dem 4-fachen bzw. 5-fachen gegenüber dem Vorjahr.

Um das Margenrisiko zu bewältigen, das durch den starken Anstieg der Kosten für einzelne Komponenten ausgelöst wurde, begannen OEMs, die Preise für KI-Server anzuheben – und zwar in einem Maß, das deutlich über dem Anstieg der Kosten für die zugrunde liegenden Komponenten selbst lag. Das macht die Entscheidungen über CapEx für Cluster komplexer: Höhere Server-Kaufkosten drücken die erwartete Rendite der Projekte, zwingen einige Betreiber dazu, den Rollout langsamer zu planen oder sogar die Umsetzung des Projekts ganz aufzugeben. Das Ergebnis: Ein Teil des zusätzlichen Angebots, das ursprünglich hätte online gehen können, wurde nach hinten verschoben oder beiseitegelegt – was die angespannte Lage im Mietmarkt weiter verschärfte.

In diesem Einkaufchaos, das durch „unkontrollierte KI-Serverpreisgestaltung“ ausgelöst wurde, nahm die Nachfrage nach GPU-Miete deutlich an Fahrt auf. Das noch vorhandene Angebot an Rechenleistung in der Marktlandschaft wurde in Januar und Februar nahezu vollständig aufgezehrt. Bis März konnte man für praktisch keine Mietlaufzeit mehr verfügbare Kapazitäten finden – weder bei H100 noch bei H200 noch bei B200. Der Preis für 1-Jahres-Mieten lag Ende Januar bereits über 2 US-Dollar pro GPU und Stunde, und stieg in der zweiten Hälfte von Februar gegenüber Ende Januar nochmals um 15 %–20 %. Erwartet wird, dass er bis Ende März im Vergleich zum Vormonat noch einmal um 15 %–20 % steigen wird.

Eines der wichtigsten Treiber der Nachfrage zu Jahresbeginn stammt aus der nativen Mediengenerierung (native media generation). Anwendungen wie Seedance und Nano Banana treiben die Nutzer dazu, Bilder und Videos in großem Maßstab zu generieren und zu iterieren, wodurch der Token-Durchsatz deutlich steigt. Noch entscheidender und zudem besser sichtbar ist jedoch die wachsende Bedeutung von Multi-Agent-Workloads: Diese Systeme führen mehrstufige Prozesse in Umgebungen mit hoher Parallelität kontinuierlich aus und iterieren dabei – sie treiben Token-Verbrauch und Rechenleistungsbedarf mit einem „exponentiellen“ Wachstum nach oben.

Diese Entwicklung ist besonders deutlich in den entsprechenden Daten zu Claude Code zu sehen, auf die wir in mehreren früheren Artikeln bereits hingewiesen haben. Nehmen wir als Beispiel SemiAnalysis: Nur in den vergangenen 7 Tagen hat das Unternehmen intern mehrere Milliarden Tokens verbraucht, bei durchschnittlichen Kosten von etwa 5 US-Dollar pro 1 Million Tokens. Aber die dadurch erzielte Zeitersparnis, die Erweiterung von Workflows und die Verbesserung der Fähigkeiten liegen weit über den Kosten selbst. Heute hat SemiAnalysis ein ganzes Set an KI-Tools in mehrere Workflows eingebettet. Es beschränkt sich nicht mehr auf simples Suchen und Zusammenfassen, sondern reicht bis hin zu Szenarien wie Daten-Dashboards, automatischem Scraping, Verarbeitung großer Datenmengen sowie agentenbasierter Finanzmodellierung.

Wir verfolgen auch den explosionsartigen Anstieg dieser Nachfrage anhand von Kennzahlen wie dem Claude Commits Daily (tägliche Claude-Commits). Nach dem aktuellen Trend gehen wir davon aus, dass Claude Code bis Ende 2026 mehr als 20 % aller Code-Commits ausmachen wird. Man kann sagen: Während du es noch nicht bemerkt hast, hat KI bereits begonnen, den gesamten Software-Entwicklungsprozess zu „verschlingen“. Für institutionelle Kunden, die diesen Datensatz erhalten möchten, können Sie sich an unser API-Team wenden. Ein kleiner Spoiler vorab: Dieser Commit-Umfang liegt bereits deutlich über dem Niveau, das wir ursprünglich veröffentlicht hatten.

In unserem Umfeld sind praktisch alle schwere Nutzer von Claude Code. Gleichzeitig wissen wir, dass dieses Umfeld selbst tief in KI- und Halbleiterbereichen eintaucht und im Grunde nur „eine kleine Minderheit an der Frontlinie“ ist.

Für viele Fortune-500-Unternehmen und die breite Öffentlichkeit sind Claude Code und „die Welt der Agenten“ lediglich ein etwas neuartiges Randthema, das höchstens gelegentlich im Facebook-Newsfeed oder in NPR-Podcasts auftaucht. Sie haben nahezu nicht erkannt, dass eine Produktivitätswelle – angetrieben von intelligenten Agenten – und ein struktureller Schock unmittelbar bevorstehen.

Wenn immer mehr Akteure aus der Realwirtschaft allmählich die erstaunliche Kapitalrendite erkennen, die die Nutzung von KI-Tools mit sich bringt, und in diese „Rechenleistungswelle“ einsteigen, wird der Token-Verbrauch weiterhin stufenweise nach oben steigen. Die Debatte über das Verhältnis von KI-Investitionsaufwand und -Ertrag ist in der Sache bereits entschieden: Der Wert, den KI-Tools schaffen, liegt häufig um eine Größenordnung über ihren Kosten. Vor diesem Hintergrund verschiebt sich die Token-Nachfragekurve weiter nach rechts; das formt eine starke Kraft, die (in der aktuellen Phase) relativ unelastisch ist, und treibt so die GPU-Mietpreise kontinuierlich nach oben.

Kurz gesagt: Wenn die Investitionsrendite für KI-Tools 5–10-fach betragen kann, dann gibt es für die GPU-Mietpreise immer noch erhebliches Aufwärtspotenzial, nur so kann die Nachfrage tatsächlich gebremst werden. Wir schließen auch nicht aus, dass ein weiterer Anstieg der Mietpreise weiterhin nach oben durchgereicht wird und die Kosten für Server und zentrale Komponenten weiter hochzieht.

Veröffentlichung des SemiAnalysis H100 1-Jahres-Mietpreisindex

Heute machen wir den SemiAnalysis H100-1-Jahres-Mietvertragspreisindex kostenlos für die Öffentlichkeit zugänglich. Ziel ist es, das Bewusstsein in der Branche für Trends und Transparenz bei GPU-Mietpreisen zu erhöhen.

Der Index wird auf Basis von monatlichen Umfragedaten mit mehr als 100 Marktteilnehmern (einschließlich Neocloud-Dienstanbietern sowie Käufern und Verkäufern von Rechenleistung) erstellt, um den repräsentativen Preisbereich für GPU-Mietpreise festzulegen (25. bis 75. Perzentil). Gleichzeitig erfolgt eine Querverifikation auch über reale Transaktionsdaten, und wir matchen Käufer und Verkäufer in unserem eigenen Netzwerk, nehmen direkt an Teilen der Transaktionen teil und kalibrieren so das Preisniveau weiter.

Seit 2023 verfolgen wir fortlaufend GPU-Daten, darunter H100, H200, B200, B300, GB200 und GB300, zu Vertrags-/Kontraktpreisen über Mietlaufzeiten von 3 Monaten bis 5 Jahren; außerdem beziehen wir die entsprechenden Daten aus der AMD-Reihe ein (MI300, MI325, MI355).

Im Vergleich zu den bereits existierenden GPU-Indizes auf dem Markt weist der SemiAnalysis H100-1-Jahres-Vertrags-Preisindex mehrere entscheidende Unterschiede auf:

Erstens basieren viele GPU-Mietindizes auf Spot-/on-demand-Notierungen oder öffentlich gelisteten Preisen, aber in der Praxis werden die allermeisten GPU-Miettransaktionen über langfristige Verträge abgewickelt – üblicherweise mit Laufzeiten von mehr als 6 Monaten. Diese Preise kommen oft durch bilaterale Verhandlungen zustande und tauchen in keiner öffentlichen Datenbank auf. Die meisten großen Neocloud-Dienstleister bevorzugen es, mindestens 1-Jahres-Verträge zu unterzeichnen; 2–3 Jahre sind noch besser, und wenn ein 5-Jahres-Wrap-Around-Bundling-Deal (Großpaketverkauf) vereinbart werden kann, ist das ideal. Der SemiAnalysis H100-1-Jahres-Mietindex fokussiert genau auf diesen „Vertragsmarkt“ – also den Teil des Marktes, in dem das tatsächliche Transaktionsvolumen am stärksten konzentriert ist. Durch die klare Ausrichtung auf eine konkrete Mietlaufzeit ist der Index auch leichter verständlich für Nutzer, um den abgedeckten Marktbereich einzuschätzen und mit eigenen Beobachtungen zu vergleichen und zu validieren.

Zweitens bedeuten öffentlich offengelegte Preise nicht, dass es sich um echte Abschluss-/Transaktionspreise handelt. Die von hyperskaligen Cloud-Anbietern und Neoclouds veröffentlichten Preise liefern eher eine Referenz für Trendrichtungen als das tatsächliche Transaktionsniveau. Diese Preise hinken oft Veränderungen im Vertragsmarkt hinterher und werden normalerweise erst angepasst, nachdem sich die Nachfrage nach Rechenleistung bereits verändert hat. Insbesondere im on-demand-Markt werden die Preise häufig relativ auf einem festen Niveau festgelegt, während die tatsächlichen Angebots- und Nachfragerituale eher durch Auslastung oder Ressourcenbelegung zum Ausdruck kommen. Anpassungen erfolgen nur bei Bedarf unregelmäßig. Über diese Mechanik im Markt wird der Artikel später noch weiter ausführen.

Drittens, obwohl es auf dem Markt auch viele Indizes gibt, die große Mengen an Angebots-, Preis- und Transaktionsdaten verarbeiten und im Trend-Analysebereich Vorteile bieten können, legt unser Ansatz mehr Gewicht auf die direkte Interaktion mit Marktteilnehmern. Hinter jedem Angebot und jeder Transaktion steckt ein konkreter Kontext und eine Entscheidungslogik. Wir wollen beim Präsentieren quantitativer Daten gleichzeitig diese qualitativen Informationen und Beobachtungen aus der Praxis ergänzen, um so die tatsächliche Struktur des GPU-Mietmarktes umfassender zu rekonstruieren.

Für institutionelle Abonnenten bieten wir außerdem vollständige Daten zur Struktur der Laufzeiten, die nahezu alle gängigen GPU-Mietmärkte abdecken.

Parallel zur Veröffentlichung des H100-1-Jahres-Vertrags-Preisindex haben wir für Nutzer, die unsere institutionellen Tokenomics-Modelle abonnieren, zudem das SemiAnalysis Tokenomics Dashboard eingeführt, um die vorderste Struktur der KI-Modelle zu verfolgen und zu verstehen. Dieses Dashboard unterstützt Nutzer bei kundenspezifischen Vergleichen über mehrere Dimensionen wie Code, Inferenz, Mathematik und agentenbasierte Evaluierungen; es ermöglicht den Vergleich unterschiedlicher Modelle und Anbieter hinsichtlich ihrer API-Preisgestaltung und zeigt wichtige, von führenden KI-Laboren offengelegte Daten, darunter Token-Nutzungsmengen, Umsätze, Bewertungen und die Größe von Kunden.

Die aktuelle Struktur des GPU-Mietmarktes

Vor der zweiten Hälfte des Jahres 2025 war das Preisumfeld im GPU-Mietmarkt relativ wettbewerbsfähiger. Damals hatten Betreiber mehr GPU-Bestände zur Verfügung, während die Nachfrage am Ende des Wertschöpfungsprozesses erst gerade begann, zu beschleunigen. Deshalb war der Wettbewerb zwischen Neocloud-Dienstanbietern sehr intensiv, und man versuchte allgemein, Kunden über attraktivere Preise zu gewinnen. Das Kernziel war, die Auslastung zu erhöhen und den Wert bestehender Rechenleistungs-Assets so „auszuschöpfen“, wie es möglich ist, bevor die nächste Iterationsrunde der GPUs ankommt.

Doch danach hat sich die Marktlage um 180 Grad gedreht. Heute haben Neoclouds und hyperskalige Cloud-Anbieter die Initiative vollständig übernommen – sie können höhere Vorauszahlungen verlangen, bessere Preisgestaltungen anbieten, längere Vertragslaufzeiten anbieten und sogar selbst die Start- und Endzeitpunkte der Verträge wählen, um sie an die eigenen Lager- und Kapazitätspläne anzupassen. Gleichzeitig steht auch die Zeit auf Seiten des Angebots: Sie können ihre Deployments nach eigenem Rhythmus vorantreiben und in einem Umfeld kontinuierlich steigender Preise nach und nach die hochwertigsten Kundenkombinationen auswählen.

Strukturell kann der GPU-Mietmarkt grob in drei große Bereiche eingeteilt werden, die jeweils unterschiedliche Typen von Kundenbedarfen abdecken:

Kurzfristige Vermietung: on-demand, Spot sowie Verträge mit einer Laufzeit von weniger als 3 Monaten

Mittelfristige Verträge: Verträge von 3 Monaten bis über 3 Jahre

Langfristige Abnahmeverträge (offtake): 4–5-Jahres-Verträge, wobei 5 Jahre am häufigsten ist

Kurzfristige Vermietung: on-demand, Spot und Verträge von weniger als 3 Monaten

Kurzfristige Vermietungen befinden sich an der vordersten Front der gesamten Laufzeitstruktur und entsprechen in vielen Fällen „übrig gebliebener Kapazität“. Allerdings gibt es auch einen Teil von Dienstanbietern (wie Runpod, Lambda), die sich darauf konzentrieren, skalierbare und flexible on-demand- oder Spot-Rechenleistung bereitzustellen.

Zu beachten ist, dass das Pricing-Mechanismus im on-demand-Markt sich deutlich von anderen Vertragsmärkten unterscheidet. Üblicherweise legt der Anbieter für on-demand-Ressourcen einen relativ festen Preis fest und nimmt ihn nur in sehr seltenen Fällen vor. Mit anderen Worten: Die Preise im kurzfristigen Markt werden nicht vollständig direkt durch das aktuelle Angebot und die aktuelle Nachfrage getrieben, sondern spiegeln zu einem großen Teil die Änderungen der Ressourcen-Auslastung wider, wodurch der Grad der Marktausspannung sichtbar wird.

Anbieter nehmen gewöhnlich eine einmalige Preisanpassung basierend auf der Ressourcen-Auslastung vor: Wenn die Auslastung eher niedrig ist, senken sie den Preis, um die Nachfrage anzuregen; wenn die Auslastung nahe an der Vollauslastung liegt, erhöhen sie den Preis, weil die Nachfrage auch bei einem höheren Preisniveau oben bleibt.

Das erklärt auch, warum sich die von Neocloud veröffentlichten on-demand-Preise aus einer Zeitreihenperspektive oft für längere Zeit nicht ändern und dann plötzlich „sprunghaft“ nach oben oder unten wechseln. Für den on-demand-Markt ist es nicht der Preis, der Nachfrageänderungen hochfrequent abbildet – sondern die Ressourcen-Auslastung.

Quelle: Lambda Labs, SemiAnalysis

Mittelfristige Verträge (Mid-Term Contracts)

Ökonomisch betrachtet ist vor allem der „Vertragsmarkt“ entscheidend, denn der weitaus größte Teil des Transaktionswerts für GPU-Mieten entsteht in diesem Segment. Besonders wichtig ist dabei ein 1-Jahres-Vertrag – er spiegelt sowohl die marginale Nachfrage von Nicht-KI-Labor-Kunden als auch den Überlaufbedarf von Großkunden wider; daher ist er der sensitivste Indikator, um zu beurteilen, wie eng der Markt sich zusammenzieht.

KI-native Unternehmen (AI Natives) und mittelgroße bis kleinere KI-Labore sind überwiegend im Bereich 1–3 Jahre aktiv. Doch ein klarer Trend in letzter Zeit ist, dass diese Einrichtungen beginnen, die Rechenleistung über noch länger laufende Verträge abzusichern – viele gehen bereits über 4 Jahre hinaus und sind sogar bereit, mehr als 20 % Vorauszahlung zu leisten; das ist bei Verträgen mit Laufzeiten über 4 Jahren in der Vergangenheit nicht so üblich gewesen.

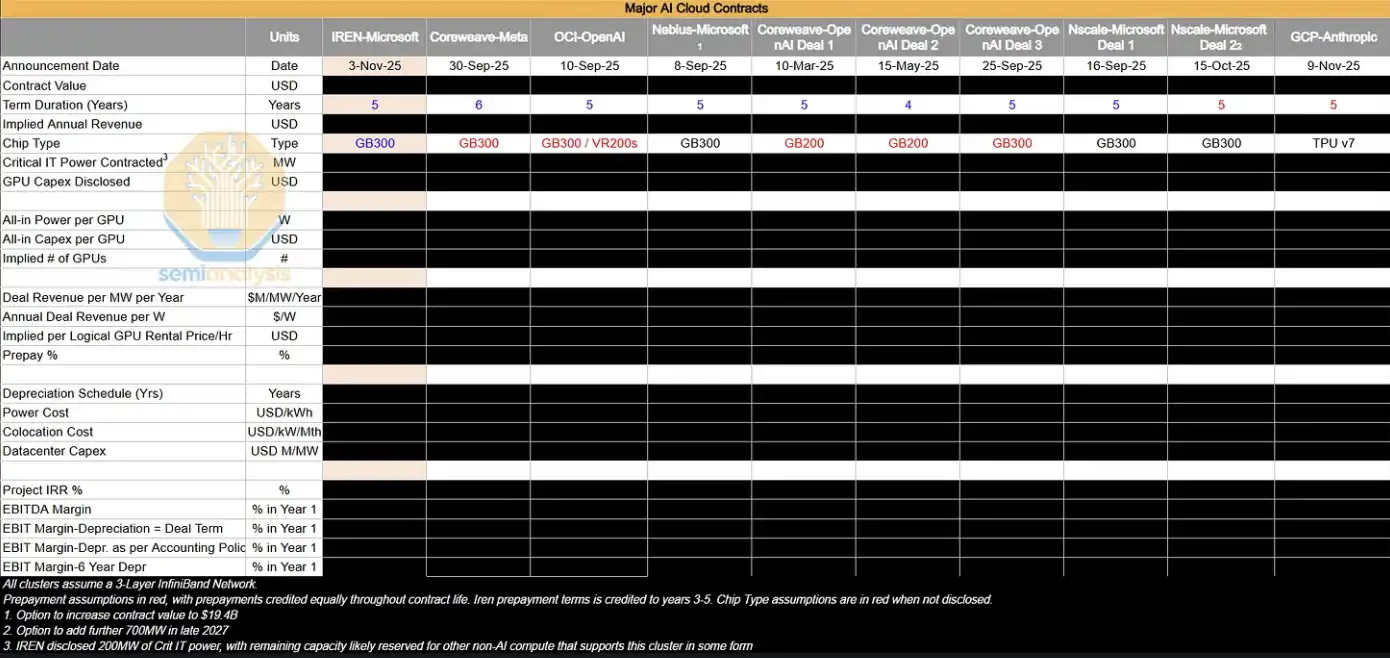

Langfristige Abnahmeverträge (Long-Term Offtakes)

In dem längerfristigen Markt mit 4–5 Jahren liegt die dominierende Kraft bei großen KI-Laboren. Diese sichern sich die Rechenleistungsressourcen in großem Umfang bereits in einer frühen Phase. Solche Transaktionen betreffen typischerweise Cluster im Umfang von 50MW, 100MW oder sogar mehr – grob entsprechend etwa 24.000 bis 48.000 GB300 NVL72 GPUs. Insgesamt betrachtet haben sich solche langfristigen Abnahmevereinbarungen bereits einen beträchtlichen Anteil am GPU-Mietmarkt von Neoclouds gesichert.

KI-Labore bevorzugen solche Verträge, weil sie auf einen Schlag große Mengen an Rechenleistung fest verankern können, um mit dem schnellen Wachstum der Nachfrage am Ende der Kette Schritt zu halten. Gleichzeitig sind diese Institutionen üblicherweise tief in das Cluster-Design involviert – einschließlich zentraler Punkte wie Storage, Netzwerk und CPU-Konfiguration. Solche Deals werden häufig als Bare Metal (bare metal) geliefert, weil KI-Labore über genügend Engineering-Fähigkeiten verfügen, um den Tech-Stack in einer tieferen Ebene zu individualisieren. Dadurch lassen sich der optimale TCO (Total Cost of Ownership) und die Performance realisieren.

Auch für Neocloud-Dienstleister sind solche Transaktionen attraktiv. Einerseits können sie ihre Vertriebsressourcen auf wenige große Aufträge konzentrieren, ohne sich mit einer Vielzahl kleinerer Kunden beschäftigen zu müssen, um trotzdem denselben Umsatz zu erzielen. Andererseits erleichtern langfristige Verträge deren Debt-Finanzierung unter besseren Konditionen – indem man Finanzierungsdauer und Vertragsdauer aufeinander abstimmt, können sie effektiv Risiken aus Frist-Fehlanpassung und Preisvolatilität reduzieren und in den meisten Fällen die internen Projekt-Renditen in zweistelliger Prozenthöhe (IRR) absichern.

Darüber hinaus spielen hyperskalige Cloud-Anbieter (Hyperscalers) häufig die Rolle des „Backstops“: Sie fungieren als direkter Käufer, beziehen Rechenleistung direkt von Neocloud und verkaufen sie dann an KI-Labore weiter. Diese Struktur ist für alle Seiten ein Win-Win: Neocloud kann basierend auf dem Bonitätsrating des Abnehmers (AAA) bessere Finanzierungskonditionen erhalten; während hyperskalige Cloud-Anbieter ihre eigene Bilanz nicht ausweiten müssen und über das Bereitstellen von Kredit-Backing einen Teil der Projekt-Erträge vereinnahmen können.

Die folgende Tabelle listet einige der großen Abnahmevereinbarungen auf, die wir verfolgen. Wir führen eine eingehende Analyse dieser Transaktionen durch, um daraus die implizierten GPU-Stundenpreise ($/hr/GPU) sowie zentrale Rentabilitätskennzahlen wie Projekt-IRR und EBIT-Margen abzuleiten.

Im aktuellen Marktumfeld werden die allermeisten expandierenden großen KI-Cluster in der Praxis von KI-Laboren „intern aufgefressen“. Dennoch werden diese Institutionen in den Vertragsmarkt innerhalb von 4 Jahren ergänzend Rechenleistung hinzubuchen und verhindern zugleich indirekt, dass die Versorgung wieder in diesen Markt zurückfließt, indem sie bestehende H100- und H200-Cluster verlängern. Während GB200- und GB300-hyperskalige Cluster schrittweise online gehen, wird sich das Verhältnis von Angebot und Nachfrage im 1–3-Jahres-Vertragsmarkt weiterentwickeln – und genau diese Entwicklung wird im nächsten Schritt eine wichtige Variable sein, die man besonders im Blick behalten sollte.

„Wohin rollt der Puck“ (Where The Puck is Going)

Am stärksten ins Auge fällt die deutliche Abweichung zwischen der zugrunde liegenden Realität und der Marktstimmung. Obwohl Signale wie Angebotsverknappung und steigende Preise – die eigentlich Neoclouds begünstigen sollten (Ausweitung der Margen, Verlängerung der Nutzungsdauer von Assets) – bereits sehr klar sind, zeigt der öffentliche Markt für Unternehmen wie CoreWeave, Nebius, Iris Energy und andere eine zunehmend pessimistische Haltung; ihre Aktienkurse befinden sich derzeit weiterhin auf dem Tiefstand innerhalb des 6–12-Monats-Zeitraums der Vergangenheit.

Der Markt wird weiterhin von der Erzählung „endgültige Überversorgung, Kommodifizierung der Rechenleistung“ dominiert, und die oben genannten Veränderungen haben die Sorgen der Investoren um den langfristigen Wert von GPUs bisher nicht wirklich gelöst. Doch aus Sicht der Lage vor Ort bedeutet die anhaltend knappe Versorgung bei gleichzeitig wachsender Preissetzungsmacht: Fast die gesamte Rechenleistung befindet sich in einem Zustand, in dem sie von der Nachfrage „aufgesogen“ wird. Selbst wenn es Leistungsunterschiede gibt, herrscht in dieser extremen Knappheitssituation aktuell weiterhin ein Nachfrageüberhang.

Drei zentrale Beobachtungspunkte in der Zukunft

Um zu beurteilen, ob die GPU-Mietpreise weiter auf hohem Niveau bleiben, sollten drei Variablen besonders beachtet werden:

1, Ausbau-Tempo der GB300-Cluster (2026)

Entscheidend ist die relative Geschwindigkeit zwischen neu hinzugekommener Rechenleistung und dem Token-Bedarf: Entspannt sich die Knappheit auf der Angebotsseite, oder übersteigt die Nachfrage weiterhin das Angebot? Das wird direkt beeinflussen, ob KI-Labore weiterhin im Markt innerhalb von 4 Jahren mitspielen, und wie sich die Preise in diesem Bereich entwickeln.

2, Verschlechtert sich die Chip-Knappheit weiter

Einschließlich TSMC N3-Prozesskapazitäten, HBM, DRAM, NAND und anderer Schlüsselabschnitte: Jede Schwankung auf Ausführungsebene der Fertigung kann das Angebot weiter verknappen.

3, Wachstumsgeschwindigkeit der KI-Laboreinnahmen (ARR) und des Token-Verbrauchs

Die Expansion der KI-Kommerzialisierung und der Nutzungsskala bestimmt die Stärke der Endnachfrage – und das ist die Kernvariable, die die Rechenleistungsnachfrage antreibt.

Preise steigen einseitig nach oben, Renditen nehmen entsprechend zu

Zusammenfassend lässt sich eine relativ klare Schlussfolgerung ziehen: Die Wahrscheinlichkeit, dass die GPU-Mietpreise weiter steigen, ist höher als die Wahrscheinlichkeit eines Rückgangs.

Dieser Prozess zeigt eine deutlich selbstverstärkende Eigenschaft: Wenn Neocloud erkennt, dass sich die Versorgung verengt und die Preise steigen, sichert man im Voraus mehr Hardware ab, wodurch das Angebot am Markt weiter komprimiert wird und die Preise folglich weiter nach oben getrieben werden. Das ähnelt dem GPU-Knappheitszyklus von 2023–2024: Damals führte die Angebotsknappheit dazu, dass OEMs eine erhebliche Margenausweitung erreichten, was wiederum die Serverpreise deutlich nach oben trieb (auch wenn die Markt-Reife in dieser Runde höher ist und sich der Prozess nicht zwingend vollständig wiederholt).

Gleichzeitig verbessert ein erneuter Anstieg der GPU-Mietpreise auch die Kapitalrendite (ROIC) von Neoclouds:

Einerseits: Erhöhte Profitabilität der bereits eingesetzten Assets

Andererseits: Verlängerte wirtschaftliche Nutzungsdauer der GPUs, sodass das Kapital länger Cashflows generieren kann

Wer sind die größten Gewinner von heute?

Der unmittelbarste Profiteur ist derjenige, der über folgende Merkmale verfügt:

· Schwerpunkt auf kurzfristigen Verträgen (kann schnell neu bepreisen)

· Haufen an vorhandenen H100-Beständen

· In der nahen Zukunft zusätzliches Kapazitätswachstum geht online

Neoclouds mit Short-Rental-Struktur können alte Verträge schneller freigeben und dann zu höheren Preisen neu unterschreiben, wodurch sie die Margen schnell ausweiten können. Gleichzeitig werden auch hyperskalige Cloud-Anbieter und Neoclouds, die die nächste Generation an Rechenleistung frühzeitig gesichert haben (mit mehrjährigen Verträgen), von den kommenden Zyklen profitieren.

Dann stellt sich die Frage: Wird es diesmal wirklich „anders“ sein?

[Original-Link]

Klicken Sie, um zu erfahren, wie BlockBeats Stellenangebote bewirbt

Willkommen, treten Sie dem offiziellen BlockBeats-Community bei:

Telegram-Abonnementgruppe: https://t.me/theblockbeats

Telegram-Chatgruppe: https://t.me/BlockBeats_App

Twitter Offizieller Account: https://twitter.com/BlockBeatsAsia