Google steigt wieder in den Open-Source-KI-Wettlauf mit Gemma 4 ein

Kurzüberblick

- Google hat Gemma 4 fallen lassen, eine Familie offener Modelle unter der Apache-2.0-Lizenz.

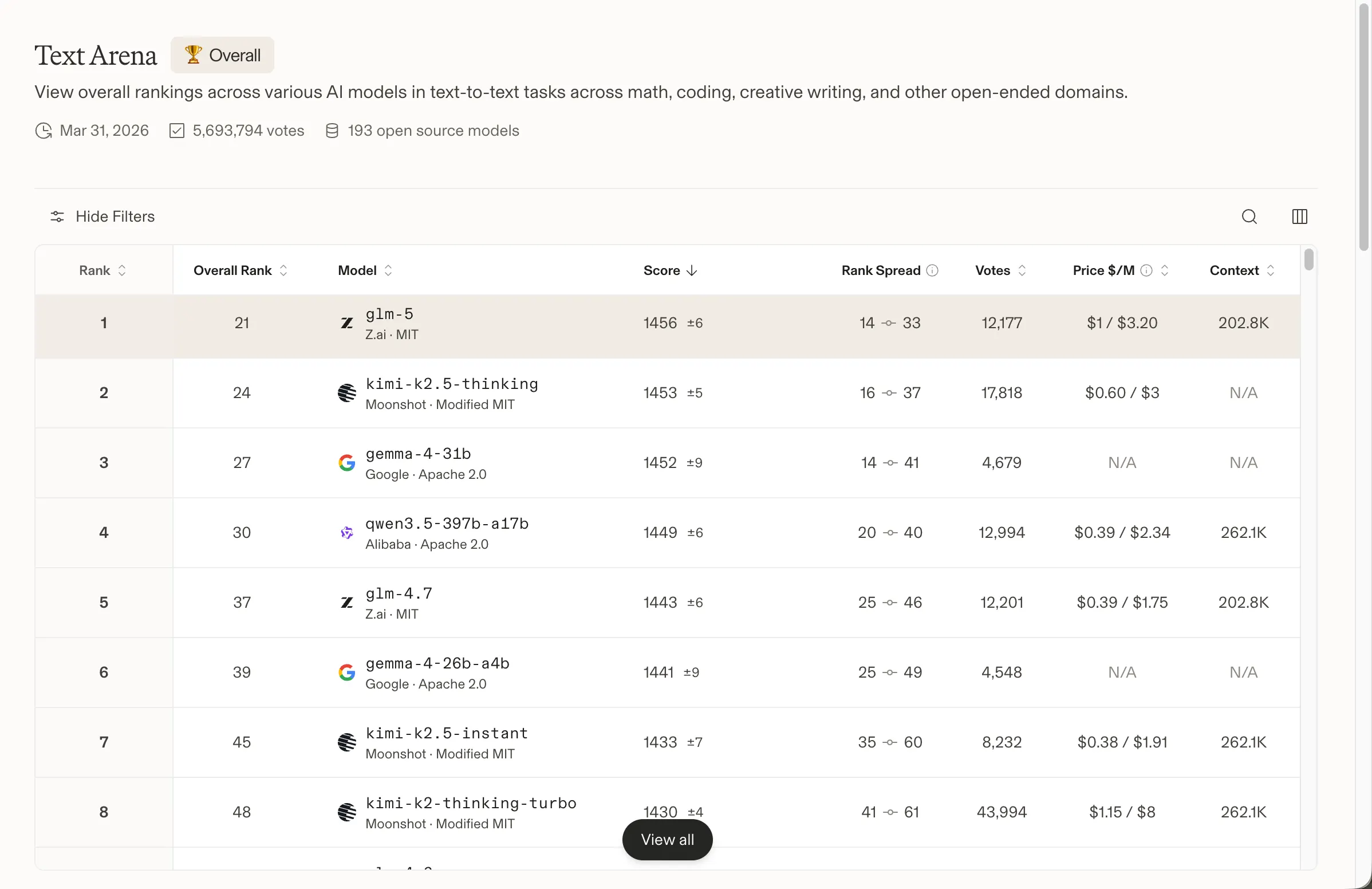

- Die Vier-Modell-Linie reicht von Phones bis zu Rechenzentren, wobei das 31B-Modell global bereits auf Platz #3 rangiert.

- Open-Source-KI in den USA erhält einen dringend benötigten Schub, da Gemma 4 – unterstützt von DeepMind – sich als der stärkste US-Wettbewerber gegen DeepSeek, Qwen und andere chinesische Spitzenreiter positioniert.

Googles Ambitionen für offene KI sind heute deutlich ernster geworden. Das Unternehmen hat Gemma 4 veröffentlicht, eine Familie aus vier Open-Weight-Modellen, die auf derselben Forschung wie Gemini 3 basiert, und die unter Apache 2.0 lizenziert ist – ein bedeutender Bruch mit den restriktiveren Bedingungen früherer Gemma-Versionen. Entwickler haben frühere Gemma-Generationen über 400 Millionen Mal heruntergeladen und mehr als 100.000 Community-Varianten hervorgebracht. Diese Veröffentlichung ist bisher die ambitionierteste.

Wir haben gerade Gemma 4 veröffentlicht – unsere intelligentesten offenen Modelle bis heute.

Basierend auf derselben erstklassigen Forschung wie Gemini 3 bringt Gemma 4 bahnbrechende Intelligenz direkt auf Ihre eigene Hardware für fortgeschrittenes Reasoning und agentenartige Workflows.

Veröffentlicht unter einer kommerziellen… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2. April 2026

Im vergangenen Jahr war die Open-Source-KI-Weltrangliste weitgehend eine chinesische Angelegenheit. DeepSeek, Minimax, GLM und Qwen haben die Spitzenplätze dominiert und amerikanische Alternativen gezwungen, nach Relevanz zu suchen. Wie Decrypt letztes Jahr berichtete, stieg der Anteil chinesischer Open-Modelle von Anfang 2024, der global kaum 1,2% der Nutzung von Open-Models ausmachte, bis Ende 2025 auf ungefähr 30% an – wobei Alibabas Qwen sogar Metas Llama als meistgenutztes Self-Hosted-Modell weltweit überholte. Metas Llama war früher die Standardwahl für Entwickler, die ein fähiges, lokal lauffähiges Modell wollten. Dieses Image hat gelitten – die von Meta kontrollierte Lizenz von Llama warf Fragen nach seinem echten Open-Source-Status auf, und seine Performance fiel hinter den chinesischen Wettbewerb zurück. Die OLMo-Familie des Allen Institute versuchte die Lücke zu füllen, scheiterte jedoch daran, nennenswerten Zuspruch zu gewinnen. OpenAI veröffentlichte im August 2025 seine gpt-oss-Modelle, was dem Ökosystem frische Luft brachte, aber sie waren nie als Vorreiter-Wettbewerber gedacht. Und gestern veröffentlichte ein 30-köpfiges US-Startup namens Arcee AI Trinity: ein offenes Modell mit 400 Milliarden Parametern, das überzeugend zeigte, dass die US-Szene nicht komplett tot ist. Gemma 4 greift diesen Schwung auf, diesmal mit dem vollen Gewicht von Google DeepMind dahinter – und macht es dadurch wohl zum besten amerikanischen Modell in der Open-Source-KI-Szene. Das Modell sei „aus derselben erstklassigen Forschung und Technologie wie Gemini 3 gebaut“, sagte Google in seiner Ankündigung. Gemma 4 kommt in vier Größen heraus: Effective 2B und 4B für Phones und Edge-Geräte, ein 26B Mixture of Experts-Modell mit Fokus auf Geschwindigkeit, und ein 31B Dense-Modell, das für reine Qualität optimiert ist.

Das 31B Dense rangiert derzeit auf Platz drei unter allen Open Models in der Text-Rangliste von Arena AI. Das 26B MoE liegt auf Platz sechs. Google behauptet, dass beide Modelle jeweils 20-mal besser sind als Modelle, die nur so groß sind – eine Behauptung, die sich zumindest anhand der Arena-AI-Zahlen bestätigt, bei denen chinesische Modelle weiterhin die Top-2-Plätze belegen.

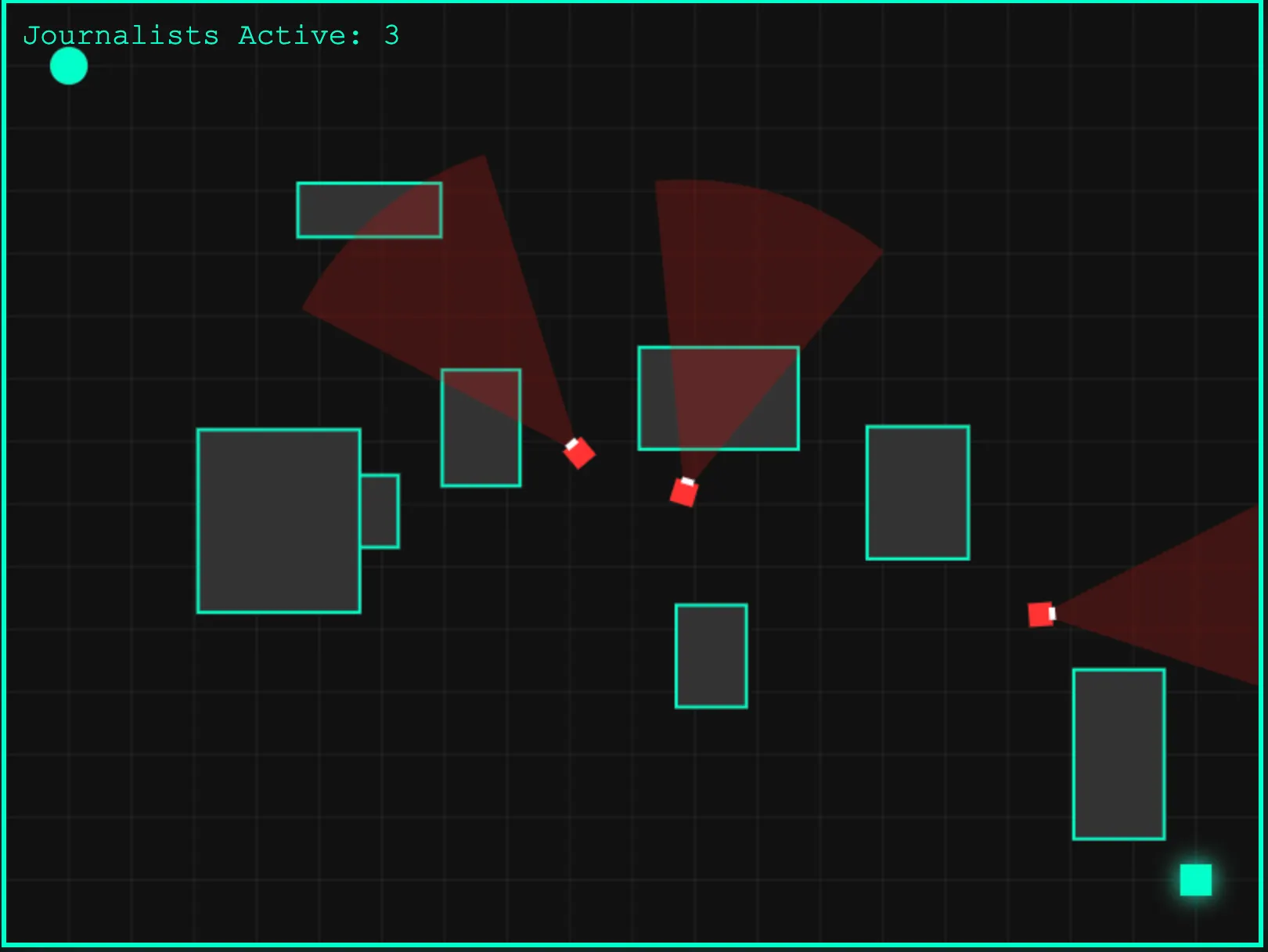

Wir haben Gemma 4 getestet. Es kann etwas – mit ein paar Einschränkungen. Das Modell wendet Reasoning auch auf Aufgaben an, die es nicht erfordern, was Antworten bei einfachen Prompts so wirken lassen kann, als wären sie zu stark überkonstruiert. Kreatives Schreiben ist solide – brauchbar, nicht inspiriert – und dürfte mit konkreterer Anleitung und Prompt-Engineering weiter besser werden. Am klarsten zeigte es sich bei Code. Als man gebeten wurde, ein Spiel zu generieren, war die Ausgabe nicht besonders auffällig oder ausgearbeitet, aber sie lief ohne Fehler beim ersten Versuch. Nicht schlecht für ein Modell mit 41 Milliarden Parametern. Diese Zero-Shot-Zuverlässigkeit ist vermutlich wertvoller als ein hübscheres Ergebnis, das erst einmal Debugging braucht. Du kannst das Spiel hier ausprobieren (basic, aber funktionsfähig).

Die vier Varianten decken das gesamte Hardware-Spektrum ab. Die E2B- und E4B-Modelle sind für Android-Phones, Raspberry Pi und Edge-Geräte gebaut und laufen komplett offline mit nahezu keiner Latenz, nativer Audioeingabe und einem 128K-Context-Window. Die 26B- und 31B-Modelle zielen auf Workstations und Cloud-Deployments ab, erweitern den Context auf 256K und fügen native Function-Calling- und strukturierte JSON-Ausgaben hinzu, um autonome Agenten zu bauen. Alle vier Modelle verarbeiten Bilder und Video nativ. Die Gewichte in voller Präzision der größeren Modelle passen auf eine einzelne 80GB NVIDIA H100 GPU; quantisierte Versionen laufen auf Consumer-Hardware. Die Apache-2.0-Lizenz ist die zweite große Schlagzeile. Googles frühere Gemma-Veröffentlichungen nutzten eine benutzerdefinierte Lizenz, die juristische Unklarheit für kommerzielle Produkte erzeugte. Apache 2.0 nimmt diese Reibung vollständig aus dem Weg – Entwickler können modifizieren, redistribuieren und kommerzialisieren, ohne sich Sorgen machen zu müssen, dass Google später die Bedingungen ändert. Hugging-Face-Mitbegründer Clement Delangue lobte das und sagte, dass „Local AI gerade seinen Moment hat“, und es die Zukunft der KI-Industrie sei. DeepMind-CEO Demis Hassabis ging noch weiter und nannte Gemma 4 „die besten offenen Modelle der Welt für ihre jeweiligen Größen“.

Wir freuen uns, Gemma 4 zu starten: die besten offenen Modelle der Welt für ihre jeweiligen Größen. Verfügbar in 4 Größen, die für deine spezifische Aufgabe feinjustiert werden können: 31B dense für starke Rohleistung, 26B MoE für geringe Latenz und effective 2B & 4B für den Einsatz auf Edge-Geräten – viel Spaß beim Bauen! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) 2. April 2026

Das ist eine starke Behauptung. Proprietäre Systeme von Anthropic, OpenAI und der eigenen Gemini von Google führen weiterhin bei den schwierigsten Benchmarks. Aber für Open-Weight-Modelle, die man lokal ausführen, frei modifizieren und auf die eigene Infrastruktur deployen kann? Der Wettbewerb ist gerade deutlich dünner geworden. Du kannst Gemma 4 jetzt in Google AI Studio (31B und 26B) oder in Google AI Edge Gallery (E2B und E4B) ausprobieren. Modellgewichte sind außerdem auf Hugging Face, Kaggle und Ollama verfügbar.